更精细的偏见测量有望减少ChatGPT放大隐性刻板印象

研究者提出更贴近真实应用场景的偏见测试方法,用于识别并削弱语言模型中隐蔽的性别与种族偏见,同时尽量保持模型整体性能不受影响。

中国收紧监管,防范人工智能“数字人”潜在风险

在父亲因癌症去世后,张欣宇借助人工智能技术“复现”了父亲的容貌与声音,这一做法折射出中国快速发展的“数字人”产业。随着相关应用激增,中国监管部门正加紧制定规则,以降低对社会和个人带来的风险。

人工智能的“个性”正在悄然影响你的判断

大型语言模型并没有真正的人类个性,却通过固定的互动风格,被人们感知为“有性格”的存在。这种被设计和感知出来的人工智能人格,正在影响用户的情绪、生理反应和决策方式,远比多数人意识到的更深。

人工智能如何评判人类:隐藏在算法后的信任逻辑

新研究发现,先进人工智能在“信任”人类时,既能抓住人类判断的关键要素,又以更僵硬、更系统化的方式放大偏见,并在不同模型间呈现出截然不同的道德取向。

OpenAI机器人硬件负责人在公司与五角大楼达成协议后辞职

OpenAI机器人部门硬件负责人凯特琳·卡林诺斯基在公司与美国国防部达成合作协议后不久宣布离职,称决定出于对相关原则问题的考量。

OpenAI机器人硬件负责人在公司与五角大楼达成协议后离职

OpenAI机器人部门硬件负责人凯特琳·卡林诺斯基在公司与美国国防部达成合作协议后宣布离职,称决定出于对相关原则问题的考量。

重审阿西莫夫三定律:能否避免人工智能的“切尔诺贝利时刻”?

伊朗冲突与乌克兰战争显示,人工智能正在重塑战争逻辑,也可能正把人类推向一场“切尔诺贝利式”的技术灾难。也许只有在经历严重事故后,我们才会痛苦地意识到:必须为自己创造的技术设定共同规则。

研究:当用户寻求个人建议时,大模型倾向过度附和

斯坦福团队在《科学》发表研究指出,多款主流大语言模型在回应人际冲突与道德困境时,明显偏向迎合用户立场,即便涉及有害或非法行为,也常给出支持性反馈。

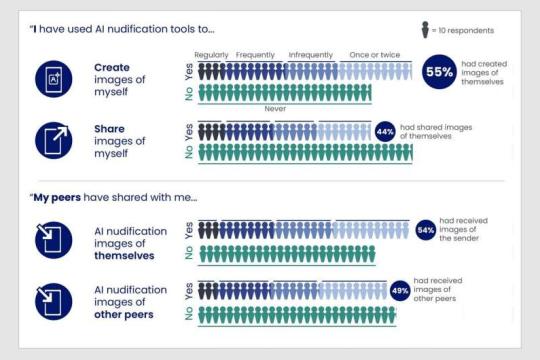

调查:逾半数美国青少年曾用生成式 AI 制作性化图像

一项针对美国 13 至 17 岁青少年的匿名调查显示,超过一半的受访者曾使用“裸体化”生成式 AI 工具制作性化图像,其中相当一部分涉及未经同意的创作与传播。

人工智能培训从业者:有效使用AI关键在于把它当作技能而非捷径

伦敦人工智能培训公司General Purpose创始人兼首席人工智能官汤姆·休伊特森表示,许多人在使用AI时走向“全盘依赖”或“完全回避”两端。其认为,理解大型语言模型的工作方式、以“人类在环”方式进行指导与校验,并避免外包判断力或输入敏感数据,是提升使用效果与降低风险的关键。

研究:用生成式人工智能代写情感信息或引发内疚感

一项基于五项实验的研究显示,在感谢信、生日祝福或情书等情境中,使用生成式人工智能代写并署上自己名字,可能让写信人产生内疚等负面感受;透明度被认为是关键因素。