NTT、NTT 数据集团与 NTT Docomo Business 三家公司于 2026 年 4 月 27 日联合宣布,将面向 AI 时代推出全新的 AI 原生基础设施「AIOWN(エーアイオン)」。

这一基础设施旨在顺应生成式 AI 普及带来的应用扩张趋势,通过在 GPU、网络、电力以及边缘(Edge)之间进行整体最优化配置,为企业和社会提供高效、稳定且安全的 AI 运行环境。

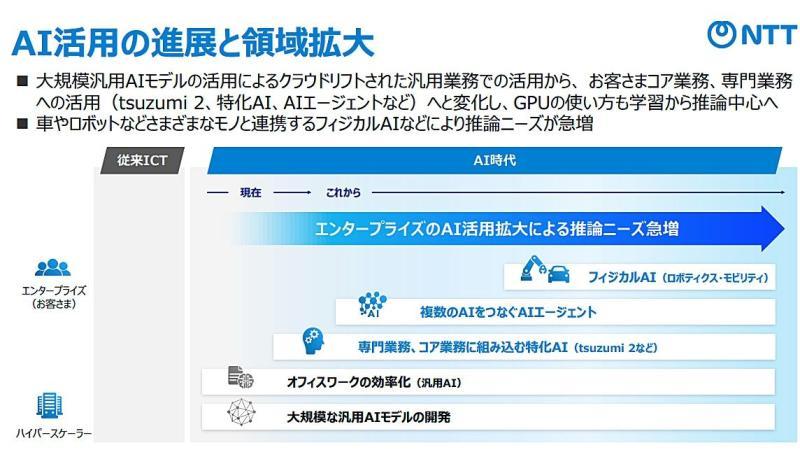

AI 应用从“训练中心”转向“推理中心”

随着生成式 AI 的快速发展,AI 的应用场景已经从传统的办公与业务效率提升,进一步延伸到企业核心业务、专业性极强的领域,以及与汽车、机器人等实体设备联动的“物理世界”场景。

NTT 在发布中指出,在这一趋势下,AI 工作负载正从以模型训练为主,逐步转向以推理为中心。未来,AI 将更加深度地嵌入企业活动和社会基础设施之中,推理请求的数量和频度都将大幅增加。

与此同时,AI 基础设施也面临更高要求:

- 高密度 GPU 带来的巨大热量与能耗管理

- 数据中心之间需要更低时延、更高可靠性的网络

- 对涉及隐私与机密信息的数据进行严格保护

- 覆盖云、数据中心与边缘节点的分布式架构

NTT 认为,只有在这些要素上实现整体优化,才能真正支撑未来 AI 推理需求的爆发式增长。

「AIOWN」:整合 GPU、网络、电力与边缘的 AI 原生基础设施

「AIOWN」被定位为面向 AI 时代的新一代基础设施平台,其核心理念是:

将 GPU、网络、电力等关键资源统一纳入一个可统筹调度的体系,并延伸到边缘节点,实现端到端的一体化运营。

在这一平台上,NTT 集团将根据不同 AI 应用的特性与需求,灵活组合:

- 所需的计算资源(如 GPU 集群)

- 网络带宽与拓扑结构

- 电力供给与冷却方式

同时,平台将提供统一的安全防护与运维管理能力,使企业能够在一个整体优化的环境中部署和运行 AI 应用,而无需分别处理计算、网络、电力和边缘节点之间的复杂协调问题。

利用全国 160 处数据中心构建 AI 基础

目前,NTT 集团在日本 47 个都道府县共运营超过 160 处数据中心,为客户提供稳定的电力供应以及低时延、高可靠的网络环境。

在「AIOWN」的推进过程中,NTT 将充分利用这一既有基础设施网络,加速构建覆盖全国的 AI 原生基础设施。

针对 AI 专用 GPU 性能不断提升、单机功耗持续攀升的问题,NTT 也在积极导入液冷技术:

- 通过液冷方式替代传统风冷

- 在相同散热能力下,冷却用电力最多可减少约 60%

这不仅有助于控制数据中心整体能耗,也为高密度 GPU 部署提供了更可持续的技术路径。

日本国内数据中心 IT 电力容量将扩至约 1GW

面向未来十年的规划,NTT 提出了大幅扩充国内数据中心容量的目标:

- 当前日本国内数据中心的 IT 电力容量约为 300MW

- 计划到 2033 财年 将其提升至约 1GW,即扩容超过 3 倍

在具体建设方面,NTT 将:

- 在东京都中心区域建设以液冷为标准配置、面向 AI 的新型数据中心,计划于 2029 财年下半年 开始对外提供服务

- 在栃木县以及千叶县印西、白井一带新建或扩建大规模数据中心集群,以承接不断增长的 AI 计算需求

通过这些举措,NTT 期望构建起一套覆盖:

- AI 模型训练

- 大规模推理服务

- 企业核心系统与社会基础设施中的 AI 应用

在内的全栈基础平台,加速日本国内 AI 利用的普及与深化。