从智能手机的人脸识别到自动驾驶系统,人工智能(AI)模型长期被视为难以窥探的“黑箱”。但近期,KAIST联合多家国际研究机构发现,一种全新的安全威胁正在出现:攻击者可以通过墙壁,远程窃取AI模型的内部蓝图。研究团队同时提出了相应的防御技术,有望强化自动驾驶、医疗、金融等关键领域的AI安全防护。

KAIST计算机学院韩俊教授团队与新加坡国立大学(NUS)、浙江大学合作,研发出名为 ModelSpy 的攻击系统。该系统只需一个小型天线,就能在远距离对AI模型的结构进行“劫持”与还原。相关研究论文已在 2026 年 2 月 23 日至 27 日于圣地亚哥举行的网络与分布式系统安全研讨会(NDSS 2026)上发表,并荣获杰出论文奖。

像“窃听”一样监听AI

这项技术的工作方式类似窃听装置:通过捕获并分析AI运行时泄露出的微弱信号,推断其内部结构。研究团队将重点放在负责AI计算的图形处理单元(GPU)上,利用GPU在执行运算时产生的电磁波作为信息来源。

当AI模型进行复杂计算时,GPU会发出极其细微的电磁辐射。ModelSpy通过天线采集这些电磁信号,并对其模式进行分析,从而重建AI模型的层级配置以及各层的详细参数设定。

远距离、隔墙也能“读出”模型

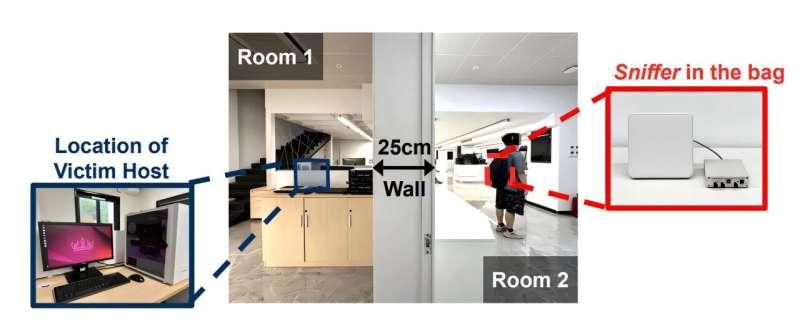

实验结果表明,在五种最新型号的GPU上,研究人员能够在最远约 6 米的距离,甚至隔着墙壁,对AI模型结构进行高精度识别。尤其是深度学习模型的核心结构——网络层级信息,重建准确率高达 97.6%。

与传统网络攻击不同,这种方法不需要入侵服务器、窃取账号密码,也不必在目标系统中植入恶意软件。攻击者只需携带一个可以放进包里的便携式小天线,就有可能在物理空间中对AI系统实施窃密。

重大威胁与防御思路

由于AI模型结构往往是企业最核心的技术资产之一,这种无需接触设备、可穿墙窃取模型蓝图的能力,被视为一项严重的安全威胁。为此,研究团队在提出攻击方法的同时,也给出了防御方向,包括:

- 电磁干扰:通过在环境中引入噪声信号,干扰攻击者对GPU电磁波的精确测量。

- 计算混淆:在计算过程中引入扰动或伪装,使得外泄的电磁信号难以直接映射到真实模型结构。

这项工作被评价为一次典型的“负责任安全研究”:不仅揭示了新型攻击面,也同步提出了可行的防护策略,为后续产业界与学术界的安全加固提供了参考。

韩俊教授指出:“我们的研究显示,即便在物理层面,AI系统同样可能遭遇前所未有的攻击方式。为了保护自动驾驶、国家关键基础设施等重要AI应用,必须构建同时覆盖硬件与软件的‘网络物理安全’体系。”