研究人员发现,在AI神经网络中,引发数据隐私泄露的部分元素,恰恰也是支撑模型性能的关键组件。基于这一认识,团队提出了一种新技术,用于在模型性能与隐私保护之间实现更优的权衡。

这一工作聚焦于如何防御“成员推断攻击”(Membership Inference Attack,MIA)。这类攻击可以让对手判断某条特定数据是否被用于训练某个AI模型,从而带来潜在的隐私风险。

相关成果收录于论文《可学习性与隐私漏洞纠缠于少数关键权重》("Learnability and Privacy Leakage Entangled in a Few Critical Weights"),将于2026年4月23日至27日在巴西里约热内卢举行的第十四届国际学习表征会议(ICLR 2026)上发表。目前,该论文已在arXiv预印本平台公开。

论文第一作者、北卡罗来纳州立大学博士生方兴立指出:“成员推断攻击可能威胁那些数据被用于训练集的个人隐私。例如,如果攻击者掌握某个人的一部分信息,就可以利用成员推断攻击判断该AI模型是否在训练中使用过这名个人的数据。”

论文通讯作者、北卡罗来纳州立大学计算机科学系助理教授金正恩补充说:“一旦确认某人的数据参与了训练,攻击者就有可能进一步推断出该用户的其他敏感信息。从本质上讲,成员推断攻击就是一种隐私漏洞。”

要理解这项研究的核心,需要先了解“权重参数”的概念。权重参数是AI神经网络(包括大型语言模型)中的关键组成部分,可以理解为连接各个神经元的“突触”。数据输入在网络中传播时,会经过这些权重参数的加权处理,最终生成模型输出。

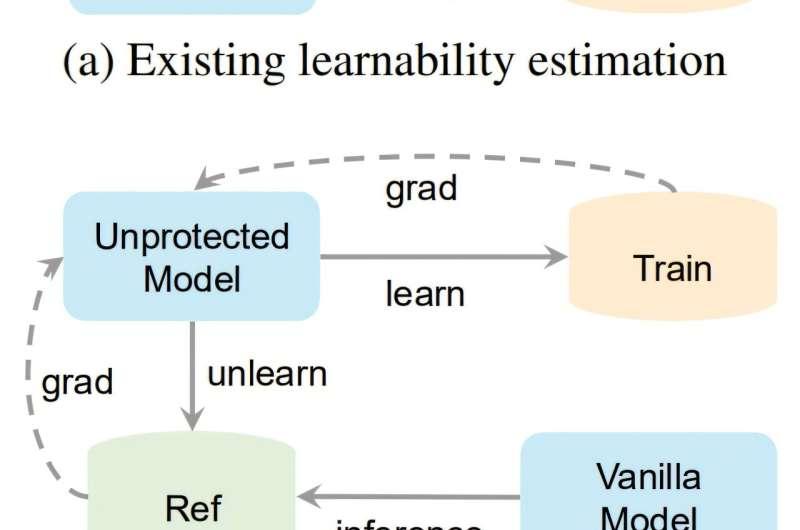

金正恩表示:“在项目开始时,我们想弄清楚:模型中哪些权重参数对隐私保护最为关键,哪些权重参数对模型性能最重要。这是非常基础的人工智能研究问题。”

方兴立介绍:“我们的结果显示,只有极少数权重参数会造成显著的隐私泄露。但出乎意料的是,这些最容易导致隐私问题的权重,同时也是对模型性能最为重要的一批权重。这意味着,如果不牺牲性能,要降低这部分权重带来的隐私风险非常困难。”

“不过,基于这一新发现,我们设计了一种新方法,通过对权重参数进行有针对性的修改,并结合微调过程来调整模型,从而在一定程度上提升数据隐私保护能力。”

为验证新方法的效果,研究团队将其提出的隐私保护技术与另外四种现有方法进行了对比测试,评估它们在抵御两种当前最先进成员推断攻击时的表现差异。

“实验结果表明,与已有技术相比,我们的方法在隐私保护和模型性能之间取得了更好的平衡。”金正恩表示,“我们也非常愿意与相关领域的研究者和从业者交流,探讨如何将这套方法整合进他们的模型训练流程中。”