在当今的医院和诊所中,皮肤科医生可能会使用人工智能模型来分类皮肤病变,以评估病变是否有发展成癌症的风险,或是否为良性。然而,如果模型对某些肤色存在偏见,就可能无法识别高风险患者。

偏见是人工智能研究中最为人熟知且持续存在的挑战之一。偏见通常与训练数据相关,但模型架构本身也可能包含并放大偏见,从而在实际应用中影响模型表现。在高风险的医疗场景中,偏见带来的性能下降可能导致严重后果,因此偏见问题成为了关键的安全隐患。

麻省理工学院(MIT)、伍斯特理工学院和谷歌的研究人员在2026年国际学习表征会议(ICLR)上发表了一篇新论文,提出了一种名为“加权旋转去偏”(Weighted Rotational DebiasING,简称WRING)的新型去偏方法,适用于视觉语言模型(VLM),如OpenAI的OpenCLIP。

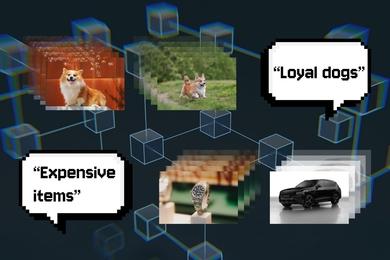

视觉语言模型是一种多模态模型,能够同时理解和处理视频、图像和文本等多种数据形式。虽然已有针对VLM的去偏方法,但最常用的是“投影去偏”,该方法导致了被称为“打地鼠困境”的问题——这是2023年正式引入AI研究的一个经验观察。

投影去偏是一种后处理方法,通过将偏见信息所在的子空间从表示空间中“投影”出去,从而剔除偏见信息。但这种方法存在缺陷。

论文第一作者Walter Gerych表示:“当你这么做时,会无意中压缩周围的所有信息,模型学习到的其他关系都会发生变化。”

Gerych现为伍斯特理工学院计算机科学助理教授,论文合作者包括MIT研究生Cassandra Parent和Quinn Perian,谷歌的Rafiya Javed,以及MIT电气工程副教授Justin Solomon和Marzyeh Ghassemi。Ghassemi同时是Abdul Latif Jameel机器学习与健康诊所及信息与决策系统实验室的成员。

投影去偏虽然能阻止模型利用被投影出去的偏见信息,但可能会放大或产生其他偏见,这就是“打地鼠困境”。Ghassemi指出,偏见的无意放大既是技术难题也是实际挑战。例如,在去除视觉语言模型中针对临床工作人员图像的种族偏见时,可能会无意中加剧性别偏见。

WRING通过调整模型高维空间中与偏见相关的坐标角度,使模型无法区分某一概念下的不同群体,从而改变特定空间内的表示,同时保持模型其他关系不变。与投影去偏一样,WRING也是一种后处理方法,可以“即时”应用于预训练的视觉语言模型。

Gerych解释道:“训练这些大型模型已经投入了大量资源和资金,我们不希望在训练过程中修改模型,因为那样就得重新开始。WRING非常高效,不需要重新训练模型,且对模型的侵入性极小。”

研究结果显示,WRING显著降低了目标概念的偏见,同时未增加其他方面的偏见。但目前该方法主要适用于对比语言-图像预训练(CLIP)模型,这是一种将图像与语言连接用于搜索或分类的视觉语言模型。

Gerych表示:“下一步合理的方向是将此方法扩展到类似ChatGPT的生成式语言模型。”

该研究部分得到了美国国家科学基金会CAREER奖、AI2050早期职业奖学金、斯隆研究员奖、戈登与贝蒂·摩尔基金会奖以及MIT-谷歌计算创新奖的支持。