Arm 于 2026 年 3 月 24 日(当地时间)正式发布面向 AI 数据中心的新一代处理器「Arm AGI CPU」。这款产品专为应对代理型 AI(Agent-based AI)普及所带来的复杂、多阶段工作负载而设计,标志着 Arm 在 AI 基础设施领域的布局进入新阶段。

在过去 35 年里,Arm 一直以提供 CPU 架构与 IP 授权为主,而这一次的 Arm AGI CPU,则是公司首次以自有品牌推出面向量产的数据中心级硅芯片产品。

基于 Neoverse 平台打造的 AI 专用 CPU

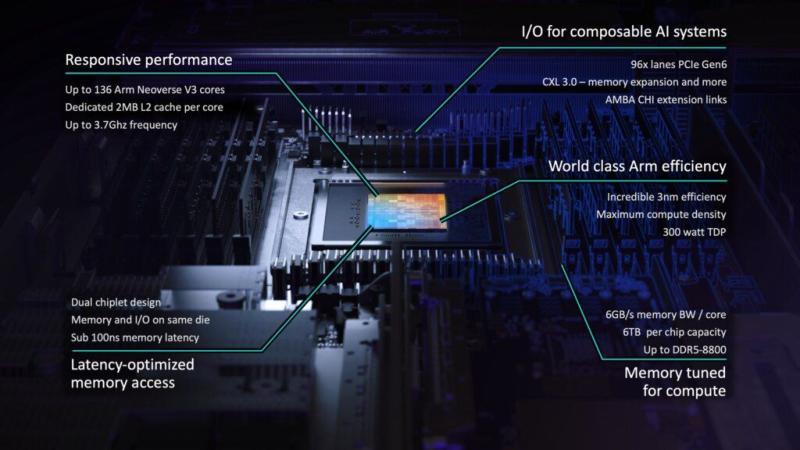

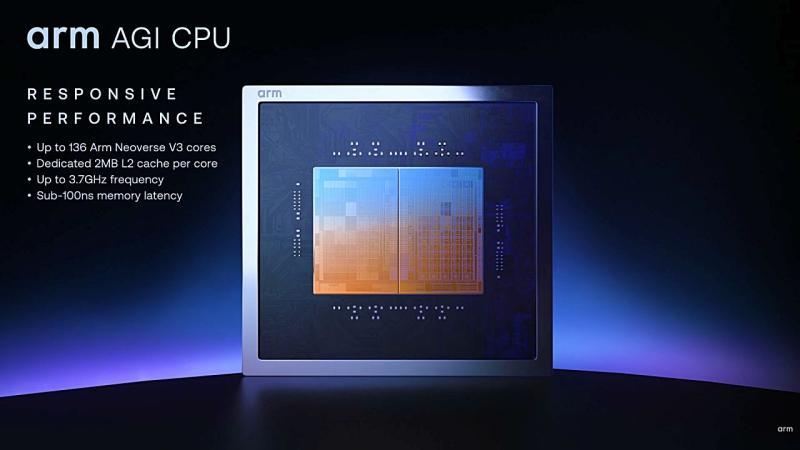

Arm AGI CPU 构建在 Arm 面向数据中心的 Neoverse 平台之上,采用最多 136 个 Neoverse V3 内核,面向高并行度、高密度计算场景进行优化。

其主要应用包括 AI 推理、大规模数据处理以及分布式系统控制等。在传统云端工作负载的基础上,Arm 还特别将代理型 AI 的运行环境作为重要目标场景:当 AI 代理需要连续执行多个任务、频繁调用工具和服务时,CPU 侧的算力、调度能力与可扩展性就变得尤为关键,Arm AGI CPU 正是围绕这一需求进行设计。

面向整柜级扩展的架构设计

与其说 Arm AGI CPU 只是一颗高性能处理器,不如说它是以数据中心整机架、整机房部署为单位来规划的基础组件。

Arm 提供的参考方案是 1OU(单机架高度单位)双节点服务器配置。在这一方案下,单个机柜最多可扩展至 8,160 个 CPU 核心,适合大规模 AI 集群与云服务环境。

在内存子系统方面,Arm 为每个核心提供最高 6GB/s 的内存带宽,以减轻大规模数据处理和 AI 推理过程中的内存瓶颈。这种高密度、高带宽的设计,有助于构建能效更高、资源利用率更好的 AI 基础设施。

与 Meta 等合作伙伴共建 AI 基础设施

Arm AGI CPU 的研发并非单独推进,而是与多家超大规模云服务商(Hyperscaler)协同进行。其中,Meta 是最重要的合作伙伴之一。

Meta 已公开表示,将与 Arm 共同开发多代面向数据中心的 CPU 产品,而 Arm AGI CPU 就是这一长期合作路线中的关键一环。

除 Meta 外,OpenAI、Cloudflare 等也被列为生态合作伙伴。可以预期,Arm 将以这些 AI 服务提供商为核心,推动 Arm AGI CPU 在云端 AI 推理、代理型 AI 服务以及边缘到云一体化架构中的落地应用。

从 IP 授权走向自有量产芯片

此次发布对 Arm 的商业模式而言具有转折意义。过去,Arm 主要向合作伙伴提供 CPU 架构与设计 IP,由对方完成芯片设计、流片与产品化。

而在 Arm AGI CPU 项目中,Arm 明确提出要以自研设计为主导,面向「量产级硅芯片」(Production Silicon)市场进行布局。这意味着 Arm 不再只停留在上游 IP 提供者的角色,而是更直接地参与到 AI 基础设施硬件市场的竞争之中。

在 AI 计算需求急剧增长的背景下,这一转变有助于 Arm 更快地将自身架构优势转化为可直接部署的产品形态,也为生态伙伴提供更标准化、可复制的基础设施方案。

为代理型 AI 时代重新定义 CPU 角色

随着生成式 AI 的发展,AI 应用正从单次推理调用,演进为能够串联多种工具、服务和流程的「代理型 AI」。在这种模式下,GPU 等加速器负责大规模矩阵运算,而 CPU 则在任务编排、状态管理、数据预处理与系统控制等方面承担更重要的角色。

Arm AGI CPU 正是针对这一趋势进行重新定义:

- 不仅要支撑传统云工作负载,还要适配长链路、多步骤的 AI 代理任务;

- 在保证高能效的同时,提供足够的核心数量与内存带宽,以支撑大规模并发代理;

- 作为 AI 数据中心架构中的关键组成部分,与 GPU、专用加速器等协同工作,构成完整的 AI 基础设施栈。

在代理型 AI 逐步成为主流交互与服务形态的未来,Arm AGI CPU 有望成为新一代 AI 数据中心中的核心算力与控制枢纽。

@YouTube