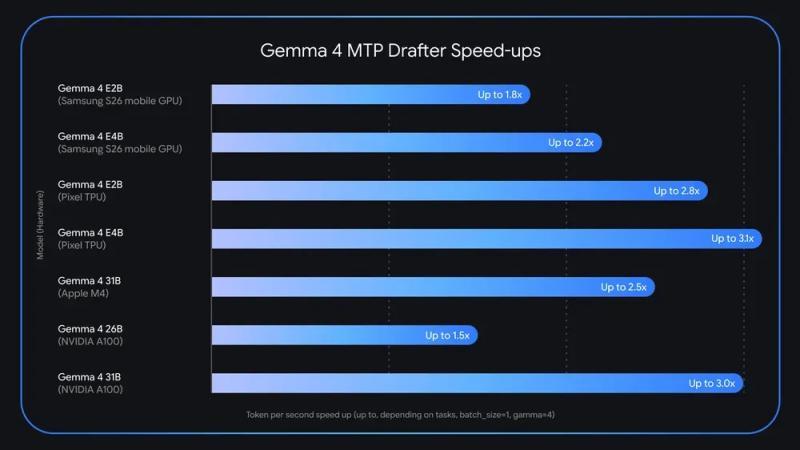

Google 于 2026 年 5 月 5 日(当地时间)宣布,面向开源模型家族「Gemma 4」推出用于加速推理的「Multi-Token Prediction(MTP)drafters」。这一机制通过让轻量级草稿模型(drafter)提前预测多个后续 Token,再由大型目标模型并行验证这些候选,从而在不牺牲输出质量和推理逻辑的前提下,将推理速度最高提升至约 3 倍。

■ Google 称已在 Gemma 4 各型号与多种运行环境中验证了 MTP drafter 的加速效果

面向 Gemma 4 全系列:E2B、E4B、31B、26B A4B

MTP drafters 专为 2026 年 3 月发布的 Gemma 4 模型家族设计。Gemma 4 目前提供 E2B、E4B、31B、26B A4B 四种规模。根据 Google AI for Developers 的更新记录,4 月 16 日已正式向这些模型提供 MTP 支持。

轻量模型“先写草稿”,大模型并行“审稿”

Google 指出,在传统的大型语言模型(LLM)推理过程中,每生成一个 Token,都需要将大量参数从内存搬运到计算单元,内存带宽往往成为整体延迟的主要瓶颈。

在 MTP drafters 架构下,除了类似 Gemma 4 本体这样的大型目标模型外,还会配套一个轻量级草稿模型。其工作流程大致如下:

- 草稿模型一次性预测多个后续候选 Token;

- 目标模型对这些候选 Token 进行并行验证;

- 若候选通过验证,就可以在原本只够生成 1 个 Token 的时间窗口内,一次性输出多个 Token。

这种方法在技术上也被称为「Speculative Decoding(投机式解码)」。Google AI for Developers 的技术文档将 Gemma 4 中的 MTP 描述为:为实现高效 Speculative Decoding 而设计的一套具体架构。

共享信息与上下文,兼顾速度与输出质量

Gemma 4 的 MTP drafter 并不是完全独立的另一套模型。根据 Google 的技术说明:

- 草稿模型与目标模型共享输入嵌入(input embeddings);

- 草稿模型会利用目标模型最后一层的激活(activations)。

借助这些共享信息,草稿模型可以充分利用目标模型已经处理过的上下文,在此基础上预测后续候选 Token,从而在保持与标准自回归生成相当的输出质量的同时,显著提升解码速度。

在 Hugging Face Transformers 的官方文档中,Google 给出了使用示例:加载目标模型的同时,再加载一个仅 4 层的轻量 MTP drafter,并将该 drafter 指定为 assistant model,即可启用这一加速机制。

面向低延迟聊天、语音应用与智能代理

Google 强调,在真实生产环境中,推理速度往往是部署大模型的关键瓶颈。通过 MTP drafters,可以显著改善以下场景的响应延迟:

- 低延迟聊天机器人与对话系统;

- 语音助手、语音交互类应用;

- 多步骤的智能代理(agent)工作流;

- 在手机、PC 等终端设备本地运行的 AI 应用。

将 Gemma 4 本体与对应的 drafter 组合使用,可以:

- 提升 E2B、E4B 等小型模型在端侧设备上的实时性能;

- 让 26B MoE 与 31B Dense 等较大模型在 PC 或消费级 GPU 上以更高速度运行。

在 Google AI Edge 的介绍中,MTP 被视为一项面向 CPU 与 GPU 后端的关键性能优化手段,可大幅加速解码过程。

开源发布:Hugging Face 与 Kaggle 提供权重

面向 Gemma 4 家族的 MTP drafters 与 Gemma 4 本体采用相同的 Apache 2.0 开源许可证。Google 表示,相关模型权重已在 Hugging Face 与 Kaggle 上公开,开发者可以在以下框架中进行测试与集成:

- Hugging Face Transformers

- MLX

- vLLM

- SGLang

- Ollama 等

在 Hugging Face 上的 Google 官方模型卡中,MTP drafter 被明确定位为 Gemma 4 的配套组件:通过扩展一个小而快的草稿模型,实现 Speculative Decoding 流水线。在该流水线中,草稿模型负责预测未来数个 Token,而目标模型则对这些候选进行并行验证。

加速效果依模型与硬件环境而异

需要注意的是,MTP 带来的加速幅度会因模型类型与运行环境不同而有所差异。Google 在官方博客中以 Gemma 4 26B A4B 这类 Mixture of Experts(MoE)模型为例说明:

- 在 Apple Silicon 上、批大小(batch size)为 1 时,由于 MoE 特有的路由机制,会存在一些额外挑战;

- 当批大小提升至 4~8、同时处理多路请求时,本地推理速度最高可获得约 2.2 倍的加速。

总体而言,Google 认为,借助 MTP drafters,可以在保持 Gemma 4 等开源大模型能力的前提下,大幅降低推理延迟,使其更易集成到各类实际应用中。通过让轻量级辅助模型“先行预判”、再由大型模型并行“把关”的方式,为端侧 AI、智能代理以及实时交互式应用提供了一条行之有效的推理加速路径。