Google の研究者チームは、AI の進化は「単一の超知能が突然現れるシンギュラリティ」ではなく、人間と AI、さらに AI 同士が複雑に関わり合う社会的な知能システムとして発展していく可能性が高いと主張している。彼らはこの見解をまとめた論文「Agentic AI and the next intelligence explosion」を科学誌『Science』に発表した。

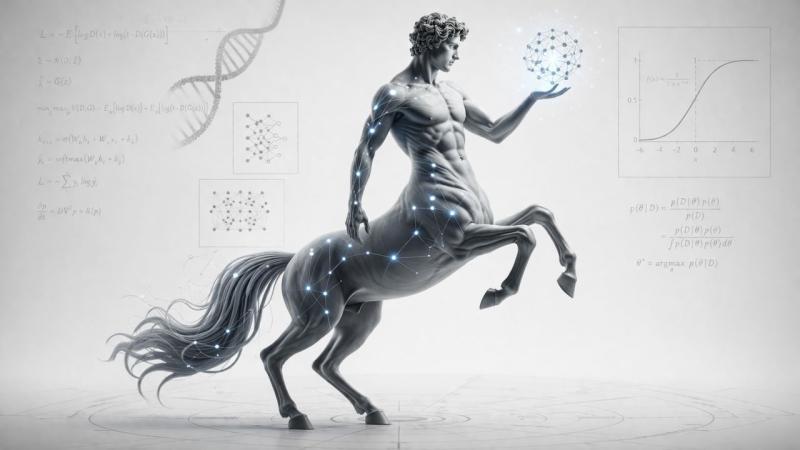

論文では、推論モデルの内部で複数の視点が議論し合う「society of thought(思考の社会)」や、人間と AI が一体となって問題解決にあたる「ケンタウロス型知能(human-AI centaurs)」といった概念を取り上げ、知能の爆発的な進化は、単独の存在ではなく社会的な相互作用から生まれると論じている。

シンギュラリティ像の見直し:知能は「一つの点」ではない

従来の AI 議論では、AI が自己改良を繰り返し、人間の知能をはるかに超える単一の超知能が出現する「シンギュラリティ」シナリオが広く語られてきた。

しかし論文の著者らは、この前提そのものが誤っている可能性が高いと指摘する。

- 知能は一つの物差しで測れる単純な量ではなく、多次元的で関係性に依存する性質を持つ。

- 人間の知能も、個人の脳だけで完結しているわけではなく、社会全体の知識・制度・文化が結びついた集合的な知能として成り立っている。

この観点から見ると、「ある瞬間に一つの超知能が誕生する」というイメージよりも、多様な主体がつながるネットワークとして知能が拡張していく姿のほうが現実に近いと考えられる。

推論モデル内部で進化する「思考の社会」

論文では、最新の推論特化型モデルで観測されている興味深い現象が紹介されている。

DeepSeek-R1 や QwQ-32B などの推論モデルでは、単に「長く考えさせれば性能が上がる」というわけではなく、モデル内部に複数の視点が現れ、互いに議論しながら結論に至るような構造が生まれていることが確認されたという。

この内部プロセスでは、

- 異なる仮説やアプローチが並行して提示される

- それぞれが互いに質問・反論・検証を行う

- そのやり取りを通じて、より妥当な結論へと収束していく

といったダイナミクスが見られる。

研究チームは、このような構造を**「society of thought(思考の社会)」**と呼び、推論能力の向上に大きく貢献していると説明する。つまり、一つのモデルの中に“小さな社会”のような知的プロセスが形成されているという見方だ。

知能の進化は本質的に「社会的プロセス」

論文はさらに、歴史を振り返ると、知能の飛躍は常に社会的な仕組みの変化として起きてきたと指摘する。

代表的な例として、次のようなものが挙げられる。

- 言語の発明:知識や経験を他者と共有し、世代を超えて伝えることを可能にした。

- 文字・記録技術:人間の記憶容量の限界を超えて、膨大な情報を蓄積・参照できるようにした。

- 法律・官僚制度・市場などの社会制度:大規模な集団が協調して意思決定・分業・統治を行うための「認知インフラ」として機能してきた。

こうした制度や文化は、単に人間を束ねるルールではなく、社会全体を一つの巨大な認知システムとして働かせる仕組みでもある。

その意味で、過去に起きた「知能の飛躍」は、

- 個々人の脳の性能が突然向上したのではなく、

- 社会的に共有される知識・制度・技術によって、「知能の単位」そのものが拡張された結果

として理解できる、と論文は述べている。

人間と AI が融合する「ケンタウロス型知能」

研究チームは、今後の知能のあり方として**「human-AI centaurs(ケンタウロス型知能)」**という概念を提示する。

ここでいうケンタウロス型知能とは、

- 人間と AI が一体となってタスクを遂行する

- それぞれの得意分野を組み合わせて、単独では到達できない成果を生み出す

といった複合的な知能システムを指す。

具体的には、次のような構成が考えられる。

- 一人の人間が、複数の AI エージェントを指揮しながらプロジェクトを進める

- 多数の人間を、AI が情報整理・意思決定支援・調整などの形で支える

- 人間と AI が混成チームを組み、役割分担しながら研究・開発・運営を行う

論文では、将来的には数十億人の人間と、数百億、あるいはそれ以上の AI エージェントが相互作用する、巨大な知能ネットワークが形成される可能性があると指摘している。これは、単一の超知能ではなく、**人間と AI が織りなす「知能のエコシステム」**に近い姿だ。

AI 社会を支える鍵は「制度設計」

こうした AI を含む社会的知能システムを安全かつ有効に運用するには、**制度設計(インスティテューション・デザイン)**が不可欠になると論文は強調する。

現在広く用いられている AI の整合手法である **RLHF(Reinforcement Learning from Human Feedback:人間のフィードバックによる強化学習)**は、

- 「一人の人間」と「一つの AI モデル」が向き合う

という 1 対 1 の関係を前提としている。しかし、

- 数十億規模の AI エージェントが存在し、

- それらが人間や他の AI と複雑に関わり合う社会

を前提にすると、RLHF だけでは十分に対応できない可能性が高い。

そのため論文は、

- 役割分担

- 規範・ルール

- 監視・ガバナンス構造

などを備えた**社会制度として AI を位置づける「institutional alignment(制度的整合)」**の重要性を提案している。つまり、個々の AI を「良い振る舞い」に調整するだけでなく、AI を含む社会システム全体の設計そのものが問われる段階に入っているという見立てだ。

「次の知能爆発」はすでに始まっているのか

論文の結論部では、「知能の爆発的進化」は遠い未来の出来事ではなく、すでに始まりつつある可能性があると述べられている。

その初期的な兆候として、次のような動きが挙げられる。

- 推論モデル内部で観測される「思考の社会」の形成

- 人間と AI が協働することで進む、知識労働の高度な分業・自動化

- AI エージェント同士が連携し、タスクを分担・協調して遂行する仕組みの登場

こうした現象は、単一の超知能が突然現れる前兆というより、人間と AI が織りなす社会的知能が急速に拡大しているサインと捉えられる。

研究者らは、今後本当に重要になるのは、

- 「一つの超知能をどう制御するか」ではなく、

- 人間と AI が共存・協働する社会システムをどう設計し、運営していくか

だと結論づけている。知能の中心が「個」から「社会」へと移る中で、AI 技術だけでなく、制度・倫理・ガバナンスを含めた総合的な設計力が問われていると言えるだろう。