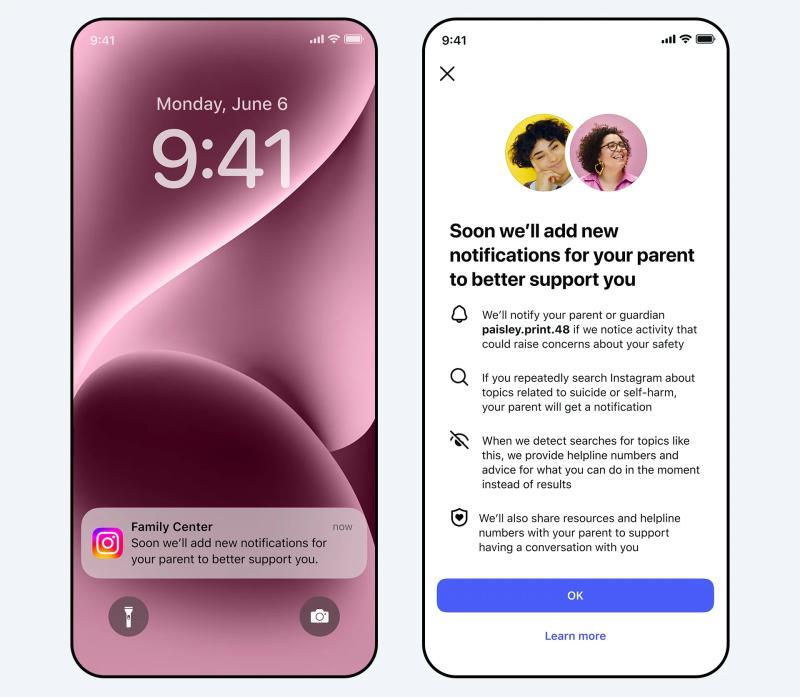

Meta Platforms 于美国时间 2026 年 2 月 26 日宣布,将在其运营的 Instagram 上推出一项面向青少年的安全新功能:当青少年账号在短时间内反复搜索与自杀或自残相关的词汇时,系统会向其监护人发送通知。该功能将于下周起率先在美国、英国、澳大利亚和加拿大上线。

## 以“短时间内的反复搜索”为触发条件

此次新增的通知机制,并不会因为一次性搜索就触发,而是以“在一定时间内多次搜索相关词汇”为前提条件。适用对象为已通过 Instagram 的「Supervision(监护/监督)」功能,与家长账号建立关联的青少年账号。

当系统判断满足条件时,会向家长发出提醒。通知渠道包括电子邮件、短信(SMS)、WhatsApp 以及应用内通知等多种方式。

在此之前,Meta 已经在 Instagram 中提供了相关安全措施:当用户搜索自杀或自残相关内容时,平台会优先展示支援机构的信息和咨询渠道。本次更新是在此基础上的进一步扩展,将潜在风险信号同步给家长,让监护人能够更早介入、提供支持。

## 考虑到青少年使用 AI 的增加而扩展

Meta 在发布中指出,此次先从 Instagram 搜索功能的家长通知做起,但公司也注意到,越来越多青少年会把 AI 视作倾诉对象或心理健康相关问题的咨询渠道。

据 Meta 介绍,目前在 Instagram 内可使用的 AI 功能,已经过专门设计,能够以相对安全的方式回应青少年用户,并在必要时引导其获取合适的资源和帮助。

在此基础上,Meta 正在为特定的 AI 交互体验构建类似的家长通知机制。当青少年在与 AI 的对话中出现与自杀、自残等相关的反复表达时,未来也有可能触发对监护人的提醒。

面向 AI 对话场景的通知功能计划在 2026 年内(later this year)上线,目前尚未正式提供。

## 先在 4 个国家试点,后续将扩展

关于搜索行为的家长通知功能,将首先在美国、英国、澳大利亚和加拿大四国推出。Meta 表示,未来还计划逐步扩展到其他地区。

近年来,Meta 持续强化针对青少年用户的安全保护措施,包括内容推荐限制、隐私设置优化以及家长监护工具等。本次新增的通知功能,被视为其青少年安全策略中的又一环节,旨在帮助家长更早察觉孩子可能面临的心理健康风险,并提供及时支持。