NTT于2026年4月22日宣布,成功开发出一项面向大规模语言模型(LLM)的新型推理技术。该技术可以在几乎不损失精度的前提下,缩小LLM输入输出单元——“token(标记)”的词汇集合,并在不同LLM之间实现词汇表的共通化。

NTT表示,这一技术首次在理论和算法层面证明:在LLM推理过程中,可以在不引起精度劣化的情况下,灵活缩小用于推理的token词汇集合。

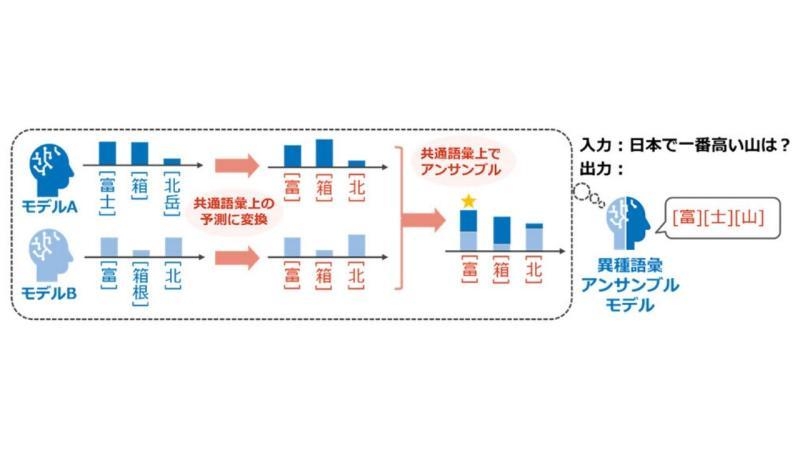

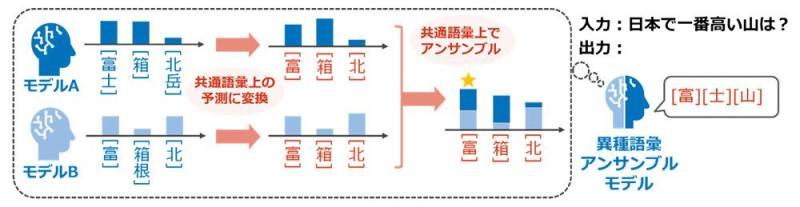

通过这项技术,任意不同架构、不同开发来源的LLM之间,都可以通过一个“共通词汇集合”进行协同工作。NTT计划将其应用于多个LLM组合使用的“集成(ensemble)”方法,以及该公司提出的“可移植调优(ポータブルチューニング)”等技术,从而在不同LLM之间实现知识的整合与迁移。

阻碍LLM协同的“词汇壁垒”

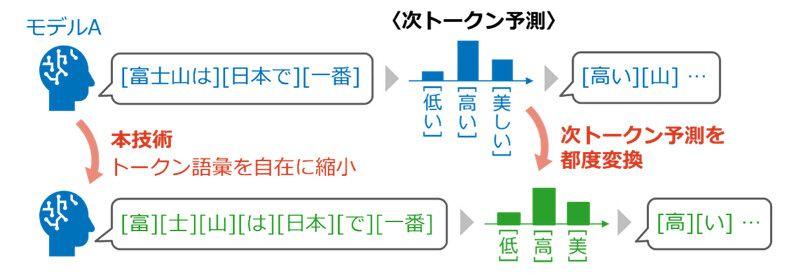

LLM在生成文本时,并不是逐字输出,而是以“token(标记)”为单位进行推理。token通常是子词或字符片段,模型通过不断执行“下一token预测”,即对下一个可能输出的token给出概率分布,从而逐步生成完整文本。

所有候选token的集合被称为“token词汇表(token vocabulary)”。据NTT介绍,主流LLM的token词汇表通常包含数万到数十万个token,而且不同机构、不同时间开发的模型,其词汇表往往并不一致。

一旦词汇表不同,各LLM在推理过程中产生的“下一token预测结果”就无法直接对齐和比较。这种不兼容被称为LLM之间的“词汇壁垒”。

正因为存在这道壁垒,要在不同LLM之间实现基于token层面的协同变得非常困难。例如:

- 将多个LLM的预测结果进行集成,以提升整体推理精度的“集成(ensemble)”方法

- 将某一模型中学到的专业知识迁移到另一模型上的“可移植调优”等技术

在以往,这类方法通常只能在“同一词汇表”的模型之间使用,很难跨模型、跨体系进行通用化。

推理过程中动态缩小词汇表,以最大共通词汇实现协同

NTT此次提出的核心技术,是在LLM推理时,对模型内部计算得到的“全词汇下一token预测结果”进行再转换,将其映射为“仅针对指定部分token”的预测结果。

换言之,模型原本会对全部token给出概率分布,而新技术可以在推理过程中,将这一分布重新压缩到一个更小的“子词汇表”上,只保留指定的部分token作为候选。

NTT基于自研理论设计了相应的转换算法,确保在进行词汇压缩时,不会改变最终生成文本的整体倾向和内容。借助这一算法,可以在几乎不损害原始LLM推理性能的前提下,使用任意“部分词汇表”进行推理。

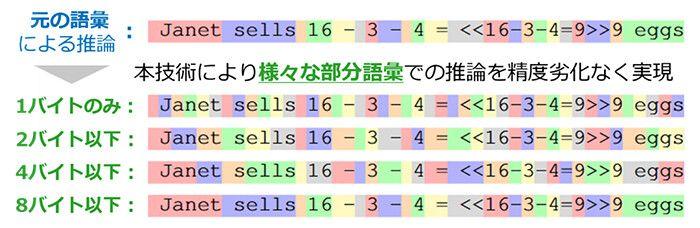

应用该技术,仅使用限定字节数以下的token进行推理的示例:

在实验中,研究团队分别使用“仅1字节token”“2字节以下token”“4字节以下token”“8字节以下token”等不同规模的部分词汇表进行推理,结果表明:在这些受限词汇条件下,模型仍能生成与原始完整词汇推理结果在内容上高度一致的文本。

通过在不同LLM上同时应用这一“词汇缩小与共通化”机制,可以将各自的预测结果统一到一个“最大共通词汇集合”上,从而实现跨模型的协同推理。

集成推理中验证了性能保持与精度提升

NTT针对词汇表不同的多种LLM,进行了集成(ensemble)推理的验证实验。实验中,各模型先通过新技术将预测结果映射到共通token集合上,再进行结果整合。

结果显示:

- 各LLM在应用该技术后,仍能保持原有的单模型性能

- 在共通token基础上的协同推理,整体推理精度出现了提升

这表明,新技术不仅能够在不同LLM之间建立“词汇层面的共通接口”,还可以在实际任务中带来可观的性能收益。

相关研究成果将于2026年4月23日至27日在巴西里约热内卢举行的深度学习国际会议“International Conference on Learning Representations(ICLR)2026”上正式发表。

面向可移植调优等多种应用场景

展望未来,NTT计划将这项token共通化技术应用于:

- 多LLM集成推理

- 可移植调优(ポータブルチューニング)

- 其他需要跨模型协同的推理与学习技术

目标是在更多样化的异构LLM之间,实现知识的高效整合与迁移。

所谓“可移植调优”,是NTT提出的一项独创技术:

- 先预先训练一个“奖励模型(reward model)”

- 再将该奖励模型与不同的基础模型(foundation model)进行联动

- 从而在无需对新基础模型重新进行完整再训练的情况下,为其赋予特定任务上的“特化学习效果”

NTT早在2025年7月就曾发布相关成果,提出可移植调优有望显著降低生成式AI的定制化成本,并能在tsuzumi等多种基础模型之间复用已有的学习成果。

此次提出的token词汇共通化技术,则从“词汇表层面”缓解了不同LLM之间的约束,为各类AI模型之间的协同工作提供了基础设施。NTT表示,将以此为支点,进一步推动异构LLM之间的知识整合与迁移。