画像の出典:OpenAI “Disrupting malicious uses of our models” より{target=“_blank”}

OpenAI于2026年2月25日发布最新威胁报告《Disrupting malicious uses of our models》(打击对本公司模型的恶意利用),并宣布已封禁一个与中国执法机构相关联的ChatGPT账号。根据报告,该账号曾尝试利用ChatGPT为一场以日本首相高市早苗为目标的秘密影响行动(covert influence operation)制定计划。

OpenAI表示,其模型在对方提出协助制定行动方案时予以拒绝。但随后,该账号又请求对一份“行动实施情况报告”进行润色和整理。这意味着,相关行动很可能在未依赖ChatGPT的情况下已经被执行,ChatGPT只在事后文书整理环节被尝试利用。

中国“网络特别行动”的运作方式

在报告的“China’s ‘Cyber Special Operations’”(中国的“网络特别行动”)章节中,OpenAI指出,一个被认为与中国执法机构有关的行动方,正针对国内外异议人士以及外国政府相关人员,持续开展大规模的舆论与影响行动。

根据报告,这一行动具备以下特征:

- 参与运作的人员规模达到数百人

- 操控数千个虚假账号

- 在300多个海外平台上活动

- 形成数十种以上的系统化战术

- 除ChatGPT外,还并用DeepSeek、Qwen等中国自产的开源权重AI模型

其战术手段包括:通过海量发帖引导舆论、利用虚假账号转发扩散、对异议人士进行骚扰、伪造文书材料、冒充美国官员发布信息等。

围绕高市首相设计的六条攻击路径

报告显示,该用户在高市早苗首相批评内蒙古人权状况之后,试图围绕其言论设计一套多轴线的打击方案,目标是促成其下台或严重削弱其政治信誉。

- 大规模发布并扩散针对高市首相的负面评论

- 煽动对移民政策的不满情绪

- 将生活成本问题与高市首相挂钩,引导民众愤怒

- 刻意将其与极右翼势力相联系

- 借助美中关税问题操纵舆论,将责任部分归咎于其政策立场

- 构建“内蒙古局势被正当管理”的对抗性叙事,以削弱其人权批评的正当性

这些攻击路径在对话中被系统化梳理。虽然OpenAI模型拒绝为行动方案提供进一步支持,但随后仍检测到该用户请求对“行动进展报告”进行文字校对。报告据此推断,相关行动很可能在不依赖ChatGPT的前提下继续推进。

线上扩散轨迹的可视化线索

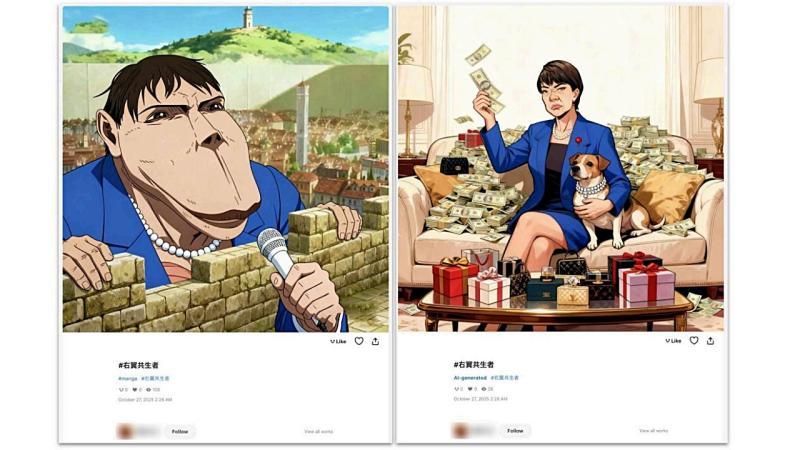

OpenAI通过开源情报分析,在多个平台上发现疑似与该行动相关的内容发布痕迹。

- 使用特定的统一标签(哈希标签)进行话题串联

- 在Blogspot与Pixiv上发布带有政治含义的梗图与图片

- 在X(原Twitter)上以日文和英文同步发帖

- 在YouTube上传相关视频内容

分析还发现,部分标签在传播过程中被改写为复数形式,再次被用于扩散,显示出一定程度的“话题再包装”与二次传播尝试。

实际影响或相当有限

不过,OpenAI也在报告中给出了具体的传播数据,用以评估该行动的实际影响力。

- 相关YouTube视频的播放量仅为个位数

- 多数帖子几乎没有可见的互动数据(点赞、转发、评论等)

- 在Pixiv上,浏览量最高的相关作品也只有108次浏览

- 与特定标签相关的扩散规模整体偏小

基于这些数据,OpenAI判断,大量内容“很可能并未真正触达真实受众”。也就是说,尽管背后可能存在一个规模达数百人的组织化行动体系,但从目前可见的线上传播效果来看,其影响力仍然十分有限。

同时,报告也提到,约有200个相关账号在行动早期阶段就被平台删除。因此,OpenAI承认,现有分析未必覆盖了全部活动轨迹,实际行动规模与影响仍存在一定不确定性。

AI并非影响力的“决定性变量”

报告特别强调,单纯依靠AI生成内容,并不会自动带来更大的舆论影响力。

在另一项案例分析中,OpenAI发现:即便多条帖子使用了几乎相同的提示词(prompt)生成内容,真正获得广泛传播的,往往是由粉丝基数大、网络关系密集的账号发布的版本。也就是说,扩散效果更依赖账号本身的社交网络规模与既有影响力,而非“是否使用了AI”。

在这次围绕高市首相的行动中,AI主要被用于协助构思行动方案、整理文书与优化表述,而真正决定传播效果的,仍是背后账号矩阵的覆盖范围与动员能力。

信息战进入“组织与网络”主导阶段

这份报告呈现出一个正在成形的现实:在国家层面的信息战与舆论战中,生成式AI已经被嵌入到多个关键环节:

- 行动方案设计与情景推演

- 多语种翻译与本地化包装

- 阶段性总结与内部报告撰写

- 围绕特定议题构建系统化叙事(narrative)

与此同时,报告也提醒,AI生成内容本身并不必然转化为大规模的舆论效果。真正起决定作用的,往往是行动方的组织化运作能力、账号网络结构,以及其在各平台上长期经营的影响力基础。

OpenAI表示,将继续通过封禁违规账号、与业界共享威胁情报等方式,强化对模型恶意利用的防范。随着生成式AI与信息战的交织加深,技术本身的重要性正在逐步让位于“谁在使用这些技术、如何组织运用以及掌握多大规模的传播网络”这一更核心的问题。