中国收紧监管,防范人工智能“数字人”潜在风险

在父亲因癌症去世后,张欣宇借助人工智能技术“复现”了父亲的容貌与声音,这一做法折射出中国快速发展的“数字人”产业。随着相关应用激增,中国监管部门正加紧制定规则,以降低对社会和个人带来的风险。

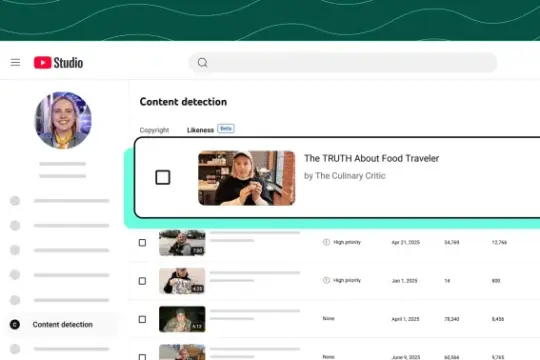

YouTube将AI深度伪造检测试点扩展至政界与媒体人士

YouTube宣布,将其AI生成深度伪造肖像检测技术从创作者扩展至部分政府官员、政治候选人和记者试点使用,相关人员可标记并申请删除涉嫌违规的AI伪造内容。

为相机数据添加加密签名:新型传感器芯片助力识别深度伪造

苏黎世联邦理工学院团队开发出一款可在采集瞬间为图像、视频等传感器数据添加加密签名的芯片,用于验证数据来源与完整性,有望成为对抗深度伪造的重要技术手段。

“看起来像真的”:政治深度伪造数量攀升,研究称即便明知虚假仍具影响力

研究人员指出,生成式AI降低了制作门槛,社交平台上围绕政治人物与社会议题的深度伪造内容快速增加。部分虚构人物被包装进军事场景以吸引流量并导向变现,同时也可能被用于宣传。

OpenAI关闭走红AI短视频应用Sora,引发深度伪造隐忧

OpenAI宣布停止运营其因AI短视频而爆红的社交应用Sora,此举与外界对深度伪造和未经同意影像泛滥的担忧密切相关。

巴尔的摩起诉马斯克旗下xAI,指控Grok生成未经同意的性化图像

马里兰州巴尔的摩市长及市议会在当地法院提起诉讼,称xAI未充分披露使用Grok及X平台的风险与限制,导致非自愿亲密影像及相关内容在用户信息流中传播。

生成式技术普及加速 内容可信度面临“零信任”考验

生成式人工智能正快速渗透视频、音乐、办公流程和招聘等多个场景,内容来源与真实性边界日益模糊,多方预计“除非证明否则为AI”的零信任时代正在逼近。

共和党参议员公布涵盖版权保护与深度伪造限制的全面人工智能立法草案

田纳西州共和党参议员玛莎·布莱克本提出了一项立法框架草案,聚焦好莱坞与人工智能领域的热点问题,包括训练模型中版权作品的使用及未经授权的名人深度伪造现象。

研究称“免疫接种”可提升公众识别政治深度伪造能力

一项由爱荷华大学研究人员参与的实验发现,无论是基于文本的提示信息还是互动游戏式训练,都能降低受试者对政治深度伪造视频的信任度,并提高其警觉性与求证意愿。

印度收紧深度伪造监管 社交平台最短两小时内须下架违规内容

印度修订信息技术规则,将深度伪造等合成音视频纳入监管,显著压缩社交媒体平台执行下架命令的时限,最短至两小时。

受害者呼吁加大对深度伪造滥用的打击力度 相关新罪名正式生效

活动人士欢迎将非自愿生成的AI色情图像制作纳入刑事犯罪,但呼吁引入更有力的民事救济、完善教育并加大对受害者服务的资金支持。

研究称深度伪造诈骗呈“工业化”扩散:低成本工具助推个性化冒充

人工智能事件数据库的分析指出,用于制作定制化诈骗内容的深度伪造工具已变得廉价且易于规模化部署,相关“为盈利而冒充”案例近期明显增多。