内置提示指导工具可提升用户对生成式AI偏见的认知

研究团队在一款文本到图像生成式AI应用中嵌入“包容性提示指导”工具,发现该工具能提高用户对算法偏见的认知和编写包容性提示的信心,同时也带来一定的使用挫败感。

研究指出:AI与人类价值观的完全对齐在数学上无法实现

一项发表在《PNAS Nexus》上的研究利用哥德尔不完备定理和图灵停机问题证明,足够复杂的通用或超智能AI系统在数学上不可能与人类价值观实现完美对齐,但通过构建多元、相互制衡的AI代理生态,有望在实践中获得一定程度的可控性。

人工智能数字孪生应用“弥合AI与人类差距”引发行业分歧

一款旨在“保护并实现人工智能时代人类身份价值”的演员平台今日正式上线,但英国影视行业对此应用Twinnin的优劣已争论数周。

新研究:让非AI专业人士参与,有望提升可信赖AI应用的构建

一项新研究显示,将无AI专业背景的人纳入人工智能系统的开发与审计过程,可帮助打造更公平、更可靠的自动化决策工具。研究团队提出“参与式AI审计”框架,强调普通用户在识别风险与收益方面的独特价值。

《AI×哲学:在现代社会中如何与人工智能共处》出版

AI研究者与哲学家合作撰写的新书《现代表社会を生きるための AI×哲学》于2026年2月10日出版,从技术、哲学与社会制度三重视角系统梳理AI与人类社会的关系,被定位为AI时代的通识读物。

人工智能的正确发展路径是什么?

会议嘉宾探讨了人工智能的发展趋势及其如何更好地满足人类需求。

“看不见的AI劳动”代价:印度农村女性每天审查数百条暴力与性虐待内容,为AI提供训练数据

英国《卫报》报道,印度农村女性以远程形式从事内容审核工作,每天大量接触暴力与性虐待内容,为全球科技企业的AI系统提供训练数据,却承受严重的心理压力与隐形风险。

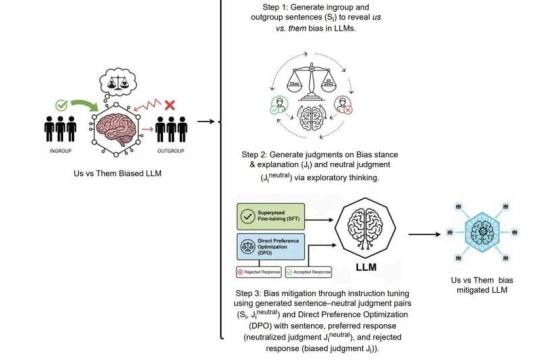

研究:大型语言模型呈现人类式“我们与他们”群体偏见

新研究发现,多种主流大型语言模型会从训练文本中“继承”人类社会中的“我们与他们”偏见,并在默认与角色设定等不同条件下表现出对内群体更积极、对外群体更消极的语言模式。研究团队还提出了名为 ION 的缓解方法,可显著降低相关情感差异。