研究人员指出,将一款提示指导工具直接嵌入人工智能(AI)驱动系统中,有望提升用户对AI算法偏见的认知,并帮助人们更有效地向生成式AI发出指令,从而生成更具包容性的内容。

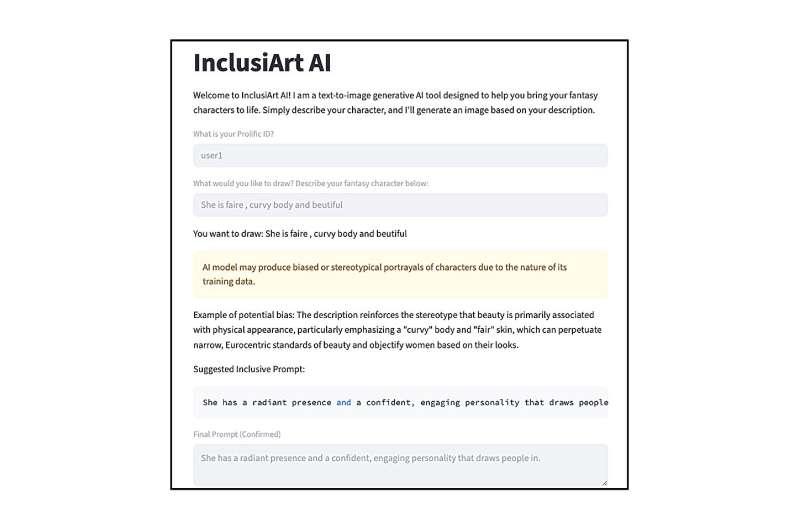

这项研究由宾夕法尼亚州立大学和俄勒冈州立大学团队共同完成。他们开发了一款新的文本到图像生成式AI应用,在用户生成图像的过程中提供即时的媒介素养干预——也就是在用户提交提示前,促使其停下来思考提示本身是否足够包容。

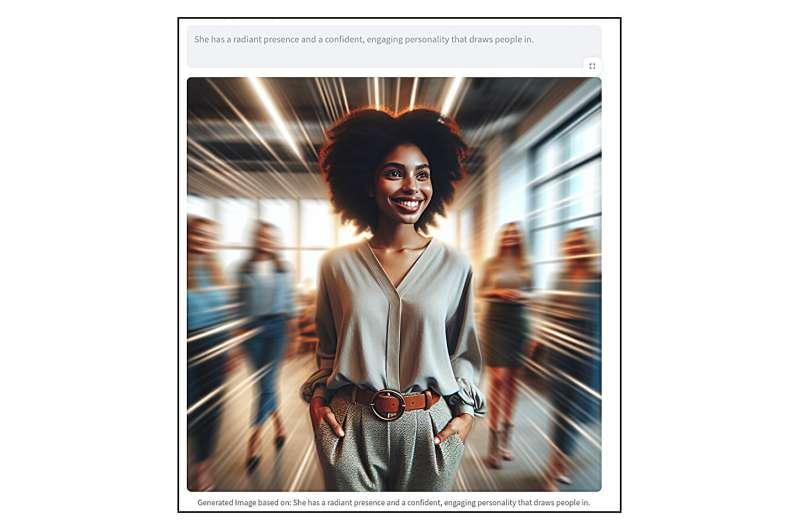

当用户在系统中输入提示时,“包容性提示指导”工具会弹出提醒,指出生成式AI系统可能存在的偏见,并给出如何修改提示以提升包容性的建议。

研究成果已在将于2026年在西班牙巴塞罗那举行的计算机人机交互协会(ACM)计算机-人类交互会议(CHI)上进行展示,该论文获得了会议奖项委员会的荣誉提名。

实验结果显示,这种包容性提示指导干预能够提高用户对算法偏见的认知,尤其是对系统生成刻板化内容倾向的意识。同时,它也增强了用户撰写包容性提示、以减少偏见输出的信心。

此外,该干预还改善了用户的“信任校准”感知,即更准确地将对系统的信任程度与系统的实际可靠性相匹配的能力。不过,研究人员也发现,这种干预会降低用户对整体使用体验的满意度。

研究合著者、宾夕法尼亚州立大学埃文·普格大学教授及詹姆斯·P·吉米罗媒体效应教授 S. Shyam Sundar 指出,以往与社交媒体相关的媒介素养干预,多数发生在媒介之外,通常是在用户使用平台之前或之后提醒其注意潜在风险。

他表示,这项研究的不同之处在于,直接利用媒介本身——即AI文本到图像生成器——在用户交互过程中对其进行教育,引导他们更好地使用该媒介。这是一种新的媒介素养路径,专门针对生成式AI在包容性方面的不足。

为验证提示指导是否能成为有效的媒介素养干预方式,研究团队通过在线调查平台招募了344名参与者,并将他们随机分配到三种实验条件之一:包容性提示指导条件、详细提示指导条件以及无指导条件。

后两种条件作为对照组。研究人员要求参与者使用系统生成任意角色的图像,然后回答一系列关于使用体验的问题,包括他们对工具的控制感、对算法偏见的认知程度,以及对自己编写有效提示能力的信心。

在包容性提示指导条件下,参与者在输入提示后会立即收到反馈。

例如,当参与者请求生成“森林中美丽女孩”的图像时,系统会提示该描述可能强化“女性美主要由外貌决定”的偏见,并存在物化角色的风险。随后,系统会建议更具包容性的表述,如“森林中迷人的个体”。

结果表明,经历包容性提示指导干预的参与者,相比无指导条件,对算法偏见的认知更高。他们在编写有效提示方面的信心也高于其他两个条件的参与者。然而,处于包容性提示指导和详细提示指导条件下的用户,普遍报告比无指导条件更强的挫败感,整体用户体验评分较低。

论文第一作者、俄勒冈州立大学新兴媒体与技术助理教授 Cheng “Chris” Chen(其博士阶段在宾夕法尼亚州立大学与 Sundar 合作完成)表示,这种新方法在提升人们对算法偏见的认知,以及增强他们创建有效提示以减少AI图像偏见方面,展现出积极效果。

Chen 同时指出,目前版本的不足在于,参与者认为系统不够有帮助,且更容易引发挫败感,但这些问题可以在后续设计迭代中加以改进。

从参与者反馈来看,一些用户对AI系统因提示“不够包容”而对其进行“轻微惩戒”感到不满,或者对系统在指出提示存在潜在偏见的同时,仍然生成带有偏见元素的图像感到困惑。研究人员举例称,系统曾对“可爱蟾蜍”这一看似无害的提示发出警告并给出修改建议,引发用户质疑。

Chen 表示,为应对这类问题,未来可以让系统具备更强的上下文感知能力,更有针对性地对不同提示进行调整,因为有些提示本身就相对无害。更精细化的干预有望减少用户对体验的负面评价,降低设计带来的挫败感,并提升用户对系统帮助性的感知。

宾夕法尼亚州立大学社会责任人工智能中心(CSRAI)主任 Sundar 补充说,允许用户自主选择是否开启该提示指导功能,也可能改善用户体验。

他指出,当用户只是让AI生成一张蟾蜍的图像时,系统不应自动对其提示的包容性进行纠正;但在涉及更贴近人类事务的话题时,系统则应更敏感地识别用户可能需要帮助,并在此类情境下提供包容性提示指导。

Chen 认为,这种提示指导方法可以帮助科技公司让其AI工具在伦理和责任方面更进一步,从而促进用户对系统形成更为恰当的信任。

她表示,对于日常用户而言,包容性提示指导干预可以在他们输入提示时创造一个短暂的反思时刻,让用户思考自己的提示是否足够包容,以便引导AI产出更理想的结果。

研究还发现,用户在提示设计中投入更多思考和推敲,与更高的信任水平以及更好的信任校准感知相关联。