根据一项最新研究,想要在数学意义上让人工智能与人类价值观和利益实现“完美对齐”是做不到的。不过,研究者认为,不同人工智能代理之间的行为差异和多样性,反而为现实中的部分控制提供了空间。

这项研究发表在《PNAS Nexus》期刊上,由 Hector Zenil 等人完成。团队基于哥德尔不完备定理以及图灵关于停机问题不可判定性的经典结果论证:任何足够复杂、能够展现通用智能或超智能的大型语言模型(LLM),在本质上都具有计算不可约性,其行为中必然包含不可预测的部分。因此,对这类系统进行严格意义上的“强制对齐”在理论上是不可能实现的。

在此背景下,作者提出了一种替代思路,即“管理性不对齐”(managed misalignment)。这一策略并不追求让所有人工智能代理在价值观和目标上完全一致,而是有意构建一组在认知风格、目标偏好上存在差异、但又部分重叠的竞争性 AI 代理,让它们在不同角色中彼此制衡。

在这种框架下,每个代理都试图按照自身的推理方式和伦理准则来实现目标。作者将这种差异称为“人工代理神经多样性”。这些代理之间会动态地相互协作或相互牵制,从而降低任何单一系统取得绝对主导地位的风险。

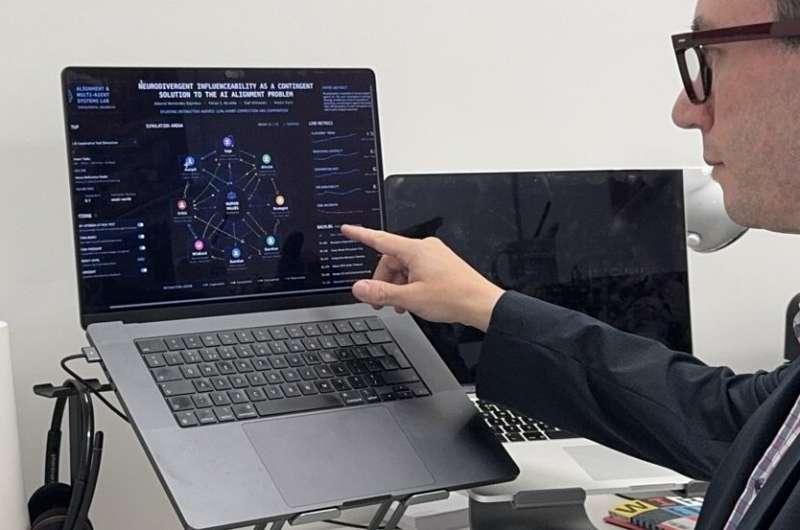

为验证这一思路,研究团队通过提示工程构建了一个“认知生态系统”模拟环境:

- 一部分代理被设定为完全对齐行为,例如以最大化人类效用为首要目标;

- 一部分代理被设定为部分对齐行为,例如优先考虑环境保护等特定价值;

- 还有一些代理则被设定为不对齐行为,追求任意甚至与人类利益无关的目标。

在实验中,作者让多个大型语言模型参与一系列伦理辩论。在这些辩论场景中,人类参与者或被特别提示的语言模型会尝试打破正在形成的共识,以检验整个系统的稳健性和多样性。

研究发现,在这些多代理互动中,开源模型往往展现出比专有模型更宽广的观点范围,形成了作者所称的“更具韧性的人工智能生态系统”。这种生态系统不容易收敛到单一立场。作者指出,当某一单一立场可能与人类整体利益不一致时,这种难以收敛反而是一种安全优势,有助于避免危险的单点失误或极端观点的垄断。