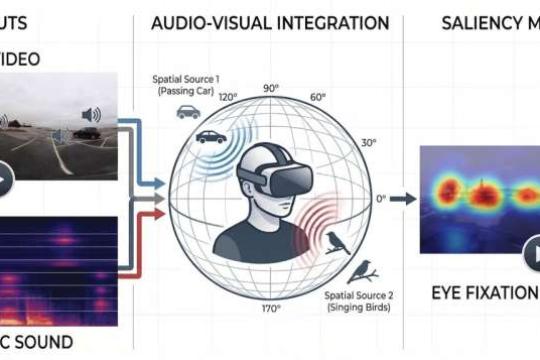

AI模型结合声音与视觉预测360度视频中的人类注意力

研究团队构建多模态数据集与专用AI模型,利用视觉与音频线索联合预测VR和360度视频中的人类注意力分布,并证明空间声音显著提升预测效果。

OpenAI 大幅升级编码代理「Codex」:迈向“几乎包办所有开发工作”的一体化 AI 搭档

OpenAI 宣布对编码代理 Codex 进行大规模升级,从单一代码生成工具进化为覆盖需求分析、设计、实现、测试与文档编写在内的全流程开发 AI 合作伙伴。

Anthropic 发布顶级模型 Claude Opus 4.7:大幅强化高难度软件开发与长时任务能力

Anthropic 推出最新旗舰模型 Claude Opus 4.7,在高难度编码、长时间复杂任务处理、多模态理解以及金融等实务场景中全面超越前代 Opus 4.6,同时在安全性与开发者工具方面继续强化。

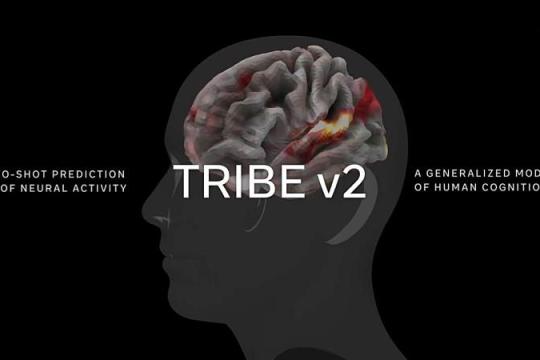

Meta 发布 AI 基础模型「TRIBE v2」:可预测人脑对多模态刺激的反应,推动“虚拟神经科学实验”

Meta 推出多模态脑活动预测模型 TRIBE v2,可在计算机上模拟人脑对视频、音频和语言等刺激的反应,被视为迈向 in-silico(计算机上)神经科学的重要一步。

借鉴犬类取物能力:机器人以89%成功率锁定目标物体

布朗大学团队提出一套融合语言与手势的新方法,让机器人在复杂环境中以约89%的成功率找到用户真正想要的物体,表现优于现有物体检索技术。