无论是在厨房还是在车间,能够替人取物的机器人助手都极具应用前景。布朗大学的一支研究团队提出了一种新方法,让机器人在理解人类意图、锁定具体目标物体方面更加精准。

这套方法让机器人可以同时利用人类的语言指令和手势信息,推理如何在环境中搜索、定位并取回目标物体。研究人员将在3月17日(周二)于苏格兰爱丁堡举行的国际人机交互会议上展示这一成果。实验表明,在复杂、杂乱的环境中,该方法能以约89%的成功率找到正确物体,优于其他主流物体检索方案。

布朗大学研究生、论文第一作者 Ivy He 表示:“寻找物品意味着机器人要在较大范围内导航。现有技术在识别单个物体时表现不错,但一旦环境变得杂乱、物品被移动或被遮挡,问题就变得困难得多。因此,我们希望通过结合语言和手势来辅助搜索过程。”

在不确定环境中规划:POMDP 框架

这项研究采用了一种称为部分可观测马尔可夫决策过程(POMDP)的机器人规划方法。POMDP 是一个数学框架,允许机器人在信息不完全、存在不确定性的条件下进行推理和决策。

在现实世界中,机器人几乎不可能对环境有完整、准确的认知:

- 不同类别的物体外观可能相似;

- 同一房间里可能存在多个同类物品;

- 物体可能被部分或完全遮挡。

在这种情况下,机器人必须在“看不清、看不全”的前提下采取行动。如果不能合理处理这种不确定性,机器人要么会陷入犹豫不前,要么会在信息不足时做出过于自信、但错误的最终选择。

POMDP 将这些模糊性转化为概率问题,帮助机器人维护一套关于环境状态的“信念分布”,并随着新信息的到来不断更新这些信念。这些新信息包括来自大型视觉和语言模型的输出。借助这一框架,机器人可以主动选择那些有助于获取更多信息的动作,例如移动到新的位置以获得更好的视角,然后再做出最终决策。

将语言与手势融合进 POMDP

本研究的关键创新在于构建了一个能够同时整合语言输入和人类手势(例如指向目标物体的动作)的 POMDP 模型。

为将手势纳入模型,He 借鉴了布朗大学认知与心理科学副教授 Daphna Buchsbaum 领导的实验室关于犬类如何理解人类指点的研究成果。犬类在“取物”任务中表现突出,被视为这类合作行为的“冠军”。

在此基础上,He 与博士生 Madeline Pelgrim 进一步分析了人类指点动作的细节,以及犬类是如何解读这些手势的。相关研究帮助 He 将“指向目标”的含义建模为一个概率锥形区域。

He 解释道:“我们发现,人们在指向目标时,视线通常会与指向方向对齐。因此,我们自然地利用眼睛、肘部和手腕三点连线构建了一个锥形区域,结果证明,这个锥形区域可以较好地近似人们真正指向的位置。”

Buchsbaum 补充说:“布朗犬实验室的工作表明,犬类在人与动物沟通中的能力非常复杂,它们解决了许多我们也希望机器人能够解决的协作问题,因此是直观人机协作的天然参考模型。这项研究把犬类对人类视线和指点的直觉理解转化为概率模型,让机器人能够处理人类交流中固有的模糊性,从而推动我们更接近真正直观的机器人助手。”

在完成手势建模后,He 又将这一模型与视觉语言模型(VLM)结合。VLM 是一类能够同时理解视觉场景和自然语言描述的人工智能系统。最终,研究团队构建出一个可以融合语言与手势输入、并用于机器人规划的 POMDP 模型。

实验:四足机器人在杂乱环境中找物

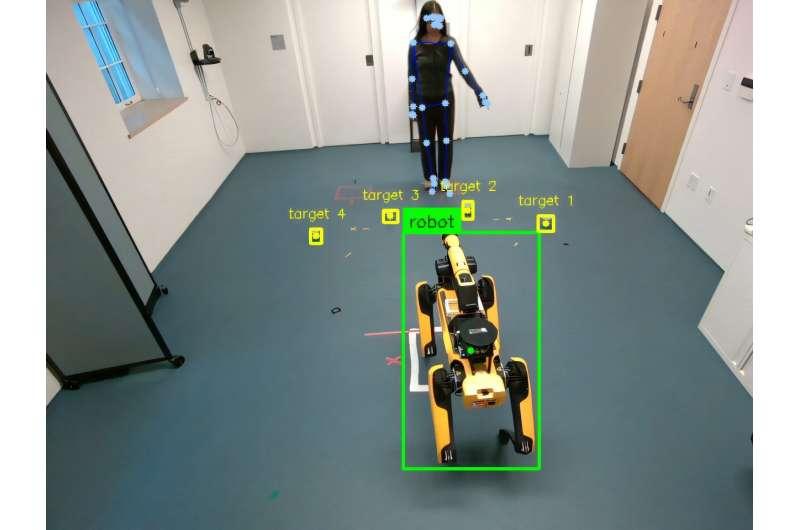

在实验室测试中,研究人员让一台四足机器人在实验室空间内搜索散落在各处的多种物体。实验结果显示,当机器人同时利用语言指令和手势信息时,能够以接近 90% 的准确率找到正确物体,这一表现明显优于只使用语言或只使用手势的情况。

对 He 及其合作者而言,这项工作是向能够在家庭和工作场景中与人类并肩协作的机器人迈出的重要一步。

该项目合作者、现为麻省理工学院博士后研究员的 Jason Liu(在布朗大学攻读博士期间参与了该项目)表示:“我们提出的框架为无缝的多模态人机交互打下了基础。未来,人们可以通过语言、手势、视线、示范等多种方式与助理机器人交流,就像人与人之间的互动一样自然。”

布朗大学计算机科学副教授、ARIA 实验室负责人 Ellie Pavlick 也指出:“这很好地展示了,通过加强计算机科学与认知科学之间的合作,我们可以实现更自然、更高效的人机交互。利用我们对人类自然交流方式的理解,去构建符合人类行为习惯和直觉的系统,是未来发展的正确方向。”

据介绍,这项研究成果已发布在 arXiv 预印本服务器上。