中国 AI 企业 Moonshot AI 于 2026 年 4 月 20 日正式发布最新大模型「Kimi K2.6」。这一版本以开源形式提供,在长时间编码能力、自主 Agent 任务执行以及多模态输入支持等方面进行了重点强化。官方已通过博客与 API 文档公开了详细技术说明。

长时间编码能力重点升级

Kimi K2.6 专门针对长时间代码生成与持续修改等场景进行了优化,提升了在复杂开发任务中的稳定性与可靠性。与以往版本相比,新模型在以下方面有明显改进:

- 更强的指令跟随能力,能更准确理解并执行多轮、复杂的开发指令;

- 更好的自我修正能力,能够在长流程开发中持续调整代码,实现迭代优化;

- 在长时间会话和大规模代码库处理时,保持较高的一致性与上下文连贯性。

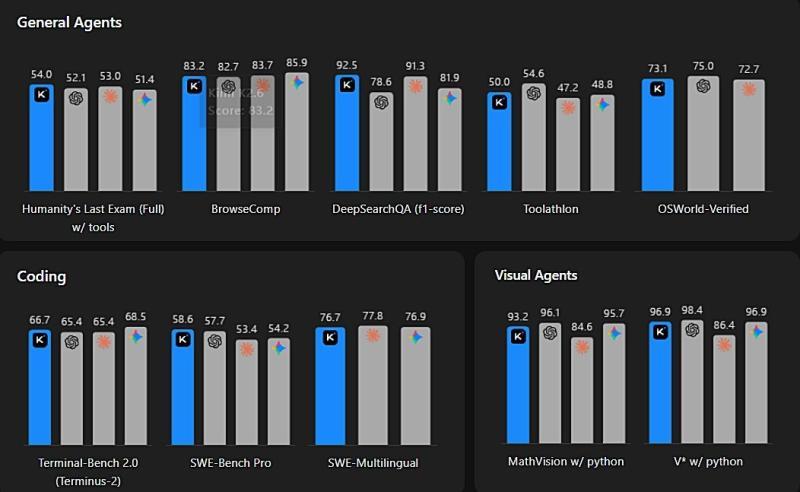

在编码相关的基准测试中,Kimi K2.6 在 SWE 系和 Terminal 系等指标上取得了更高分数,显示出其在代码生成与工具调用方面的综合实力。

Kimi K2.6 的基准测试结果。与 Claude 等主流模型在相同指标下进行对比

从公开的对比结果来看,Kimi K2.6 已被放入与 Anthropic Claude 系列等主流模型同一性能区间进行评估,表明其在编码能力方面已进入头部竞争行列。

面向 Agent 的任务分解与自律执行

Kimi K2.6 并非只面向传统的问答与文本生成,而是从设计之初就考虑了 Agent 场景的需求。模型能够将复杂任务拆解为多个步骤,循环执行「规划—执行—校正」的过程,以支持更长链路的自动化工作流。

在官方模型规格中,Kimi K2.6 明确支持:

- proactive autonomous execution(主动自律执行):在获得总体目标后,模型可以主动推进任务,而不必依赖用户在每一步都给出详细指令;

- task orchestration(任务编排):能够并行或有序地处理多个子任务,对多步骤流程进行协调与管理。

这些能力使其更适合作为应用中的核心 Agent 引擎,用于自动化运维、复杂数据处理、持续集成与部署辅助等场景。

原生多模态:支持文本、图像与视频

在输入形式上,Kimi K2.6 不再局限于文本,而是作为一个 natively multimodal(原生多模态) 模型进行设计,可直接处理图像与视频等视觉信息。

这意味着,除了代码生成之外,Kimi K2.6 还可以用于:

- 文档与图表理解:从截图、PDF 页面或演示文稿中提取并解释关键信息;

- 视觉+代码混合任务:例如根据界面截图生成前端代码,或根据系统架构图生成配置脚本;

- 复杂信息融合:同时结合文字说明与图像内容进行综合分析与推理。

多模态能力的加入,为其在企业知识管理、产品设计、数据分析等领域的应用打开了更大空间。

thinking 模式:在推理深度与响应速度间切换

Kimi K2.6 提供了两种推理模式:thinking 模式与 non-thinking 模式,允许开发者根据场景在推理深度与响应速度之间做权衡。

- thinking 模式:更注重推理过程与决策质量,适合复杂逻辑、长链路推理以及高风险任务;

- non-thinking 模式:优先保证响应速度,适合对时延敏感、逻辑相对简单的交互场景。

在 Agent 任务中,尤其是涉及多步骤决策、错误代价较高的流程时,官方建议优先使用 thinking 模式,以获得更稳健的执行效果。

API 提供与应用落地

目前,Kimi K2.6 已在 Kimi API Platform 上线,面向开发者开放调用接口,便于集成到各类应用与服务中。同时,面向开发者的编码辅助服务 「Kimi Code」 也已接入该模型,使其长时间编码与自我修正能力可以直接用于实际开发工作流。

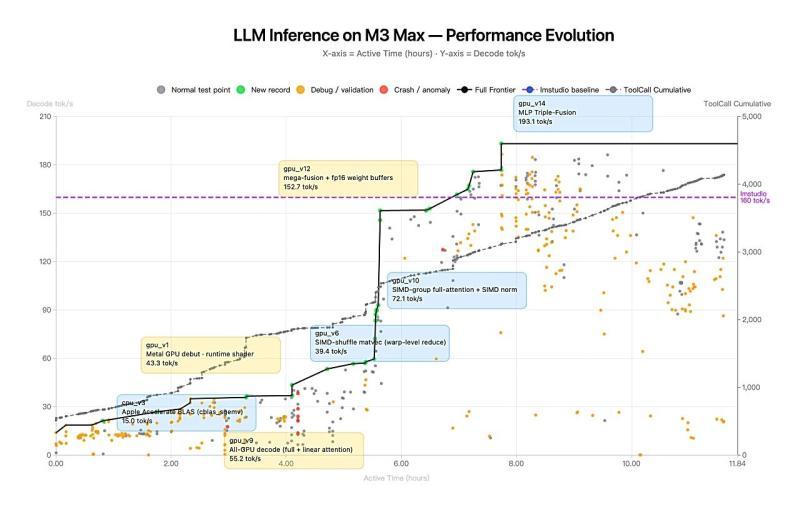

本地环境(M3 Max)上的推理性能变化趋势

从官方给出的本地推理性能数据来看,在 M3 Max 等本地硬件环境中,Kimi K2.6 的推理效率也在持续优化,这为本地部署、隐私敏感场景下的应用提供了更多可能性。