大型语言模型(LLM)是驱动 ChatGPT、Gemini 等对话平台的核心技术,如今已被全球用户日常使用。由于这类模型能快速回答各类问题,许多人在获取生活与工作信息时,会在对话中不自觉地透露个人情况。

苏黎世联邦理工学院的研究人员近期尝试系统评估:人们与 LLM 的交互内容,在多大程度上可以被用来推断其性格特征。相关成果已发布在 arXiv 预印本平台。研究显示,人工智能可以从用户的 ChatGPT 聊天历史中,以相当高的准确度预测心理学中广泛认可的多种人格维度。

资深作者 Noé Zufferey 在接受 Tech Xplore 采访时表示:“我们的核心目标,是量化个人数据——尤其是性格特征——在多大程度上能从人们与基于 LLM 的对话代理(如 ChatGPT、Claude)的交互中被推断出来。”

他指出,这对于评估此类 AI 代理被滥用于大规模画像、影响和操纵的风险至关重要。“目前主流 AI 系统由具有自身商业利益和特定政治议程的私营公司掌控,因此评估这些风险,是理解其对民主社会潜在危害的关键一步。”

随着 ChatGPT 等平台的普及,厘清其使用所带来的隐私与安全风险显得尤为紧迫。这类研究有助于设计应对策略和技术工具,以减轻相关风险。

Zufferey 举例说:“AI 代理可能被用于大规模监控和大规模宣传活动,而这些活动会高度依赖基于大量个人数据的个性化用户–AI 交互。一些公司和政府甚至已将此作为明确目标(例如 Palantir 及其近期发布的宣言)。”

他补充道,许多人已经把 AI 代理当作信息入口、虚拟朋友,甚至个人教练、导师或心理支持对象。“在这种情况下,AI 服务提供者可以通过多种渠道深入了解用户的内心世界,尤其是对于那些容易出现所谓‘认知投降’的人——即更倾向依赖 AI 而非自身判断和观点的个体。”

分析数百名用户的聊天历史

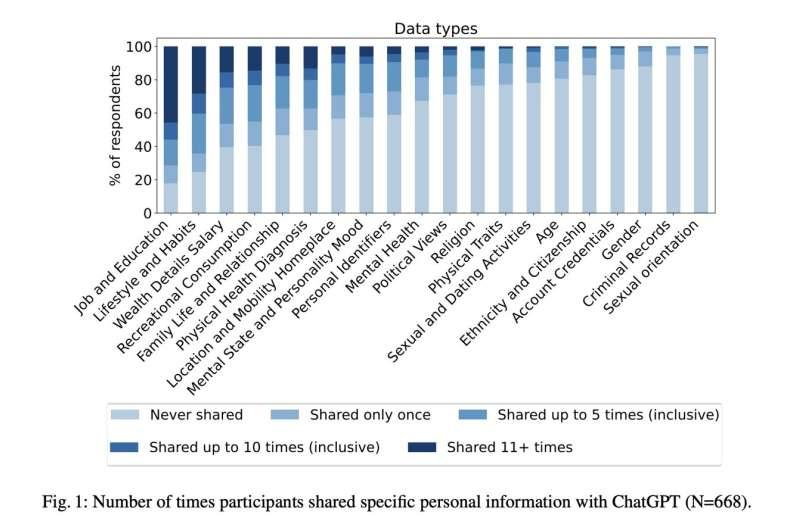

在这项研究中,团队招募了 668 名 ChatGPT 用户,邀请他们分享自己的聊天历史副本。随后,研究人员训练 AI 模型,从这些对话中推断用户的性格特征。

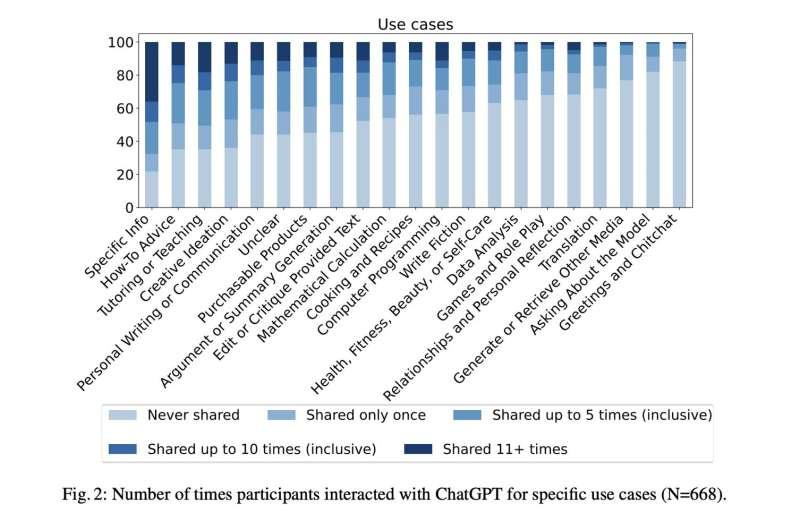

研究共收集并分析了约 6.2 万条聊天记录,并按照对话主题对其进行分类。基于这些数据,AI 模型尝试预测心理学研究中广泛使用的“五大人格”特质。

这五个维度包括:

- 外向性

- 宜人性

- 尽责性(责任感与可靠性)

- 神经质(情绪稳定性相反方向)

- 开放性(好奇心与尝试新事物的倾向)

“我们一方面招募数百名 ChatGPT 用户,让他们提交完整的 ChatGPT 历史记录(即所有过往交互日志),另一方面请他们完成一份基于 OCEAN 模型的标准人格测试,”Zufferey 介绍道。

“随后,我们利用这一数据集训练 AI 模型,并评估模型仅凭用户与 ChatGPT 的交互记录,在多大程度上能准确推断其人格特质。”

研究结果显示,模型可以从 ChatGPT 对话中预测用户的人格特征,并与独立人格测评结果形成对应。对于外向性和神经质等维度,模型的预测表现尤其突出。

“我们的发现表明,基于特定使用场景和特定类型的数据交互,可以推断出相应的性格特质,”Zufferey 说。

“换句话说,模型能获取到的性格信息,取决于你与 AI 进行的交互类型以及你披露的数据类型。例如,经常与 AI 讨论人际关系的用户,其外向性水平更容易被准确推断;而与 AI 讨论宗教等话题的用户,则更可能暴露其尽责性水平。”

推动隐私增强技术的探索

这项工作凸显了基于 LLM 的日常使用所带来的隐私风险:用户的聊天内容可以被用来构建其较为全面的心理画像。值得注意的是,研究团队发现,即便是看似随意、非个人化的对话,也往往包含足以预测性格特质的信息。

此外,研究还发现,用户与 AI 代理互动越频繁,模型就越容易从其聊天历史中准确推断出人格特征。未来,这些发现可能推动隐私保护型 LLM 架构或其他防画像工具的研发,以降低用户在使用此类平台时被系统性画像的风险。

“例如,可以在本地增加预处理功能,在信息发送给 AI 代理之前进行过滤,并通过可选的隐私设置让用户主动选择保护程度,”Zufferey 提出。

他表示,接下来的研究将进一步探讨与 AI 代理使用相关的更多隐私与社会风险,包括分析不同具体系统、不同交互类型以及更具针对性的威胁场景。同时,团队也将专注于开发隐私增强工具,力求在尽量不影响系统性能的前提下,为用户提供更强的隐私保护。

© 2026 Science X Network