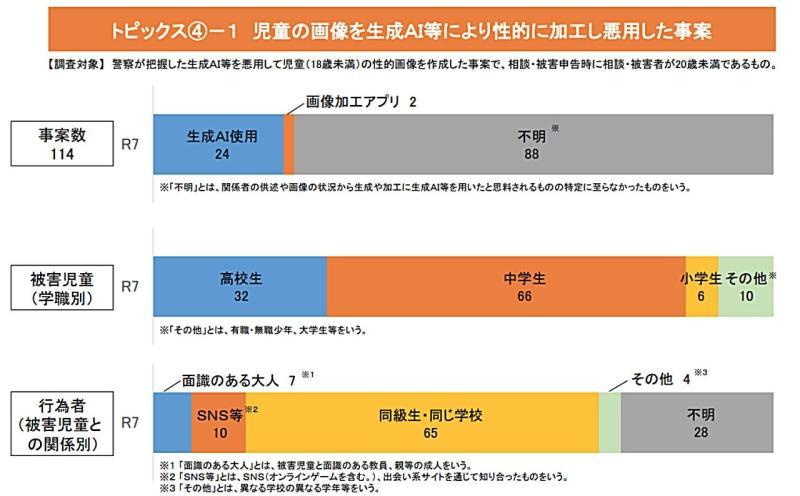

日本警察厅于2026年2月26日发布《令和7年少年非行及儿童性被害情况》报告,首次系统披露利用生成式AI等技术对未成年人照片进行性化加工并恶用的统计数据。报告显示,2025年一年内共掌握相关案件114起,受害者几乎全部为中学生和高中生。

在这些案件中,被害对象均为18岁以下儿童。统计显示,约九成受害者是中学生或高中生,而实施行为的一方中,约六成与受害者属于“同班同学或同一学校”的关系,凸显校园人际关系已成为此类问题的主要背景。

根据公开资料,2025年警方处理的相关案件共114起,比前一年(110起)略有增加。从技术手段来看:

- 明确使用生成式AI的案件:24起

- 使用图片编辑类应用的案件:2起

- 手段不明:88起

在“手段不明”的案件中,多数是根据相关人员供述或图像特征,推定使用了生成式AI等工具进行生成或加工,但无法具体锁定所用服务或工具。

从受害儿童的学龄和身份来看:

- 中学生:66人

- 高中生:32人

- 小学生:6人

- 其他(辍学、无业等):10人

中学生和高中生合计98人,占全部受害者的约九成,同时也已确认存在小学生受害案例。

从加害者与受害儿童的关系来看:

- 同班同学・同一学校:65起(约六成)

- 通过社交媒体等结识的人:10起

- 有现实接触的大人:7起

- 关系不明:28起

- 其他:4起

可以看出,多数案件发生在学校这一封闭的人际网络之中,往往与同学关系、校园内的矛盾或好奇心驱动等因素交织在一起。

警察厅在资料中列举了多起具有代表性的案例,用以说明问题的具体表现形式:

- 一名以“收费代做生成式AI色情图片”为业的成年男性,接受一名男高中生的委托,将其提供的女同学照片加工成性化图像,并在社交媒体上公开发布、扩散。

- 一名男初中生将女同学在社交媒体上发布的照片通过生成式AI处理成裸体图像,并将这些图片出售给其他男生。

- 某高中一名男性实习助手,将毕业纪念册中女学生的照片提供给第三方,之后被加工的性化图片在社交媒体上广泛传播。

- 有人在保育机构内拍摄女童照片,再与成年女性裸体图片进行合成,并将合成图像据为私藏。

- 有人将通过社交媒体结识的男初中生照片进行性化加工,并以“要把图片扩散出去”相威胁,向对方索要电子货币。

从这些案例可以看出,问题并不仅仅停留在“恶搞”或单纯的图像篡改层面,部分案件已经发展为有偿制作、贩卖传播,甚至演变为以图像为筹码的恐吓和勒索。

警察厅表示,在处理此类案件时,会在充分顾及咨询者和受害者心理状态的前提下,根据具体情节,适用《刑法》中关于名誉毁损、散布淫秽物品等相关罪名进行立案侦查,同时也会视情况实施指导、警告等措施。警方强调,目前仍存在大量未被发现或未被举报的“潜在案件”,今后有必要持续高度关注这一领域的动向。

随着生成式AI的快速普及,利用未成年人照片进行性化加工、伪造和扩散等新型侵害形式正在浮出水面。此次统计结果,再次凸显了技术发展与儿童保护之间的矛盾,也对学校、家庭和平台运营方的防范与教育提出了更高要求。