《机器学习》期刊近日发表的一项研究指出,仅依靠模式学习来训练游戏人工智能存在明显不足,引入抽象表示或与其他方法结合,可能更有助于系统掌握游戏的深层规律。

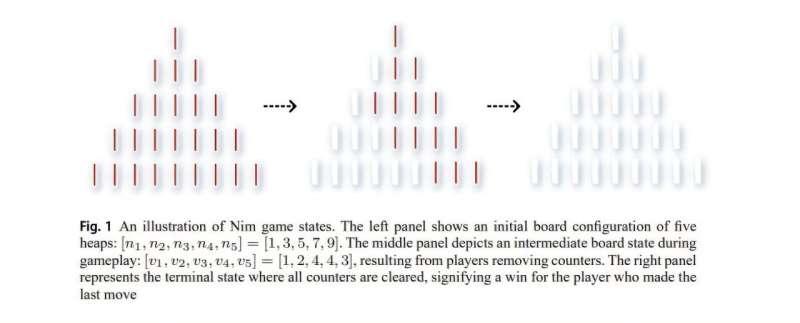

许多人工智能研究者常把游戏视作人工智能的“一级方程式”:规则清晰、胜负标准明确,是检验算法能力的理想试验场。研究团队正是借助这一视角,选取了一个极其简单、面向儿童的火柴游戏——尼姆。尼姆的最优策略早已被数学完全求解,因此非常适合作为诊断工具,用来评估自我对弈系统是否真正学会了游戏的底层结构。

在尼姆游戏中,每一种局面下的最优走法都是已知的。借助这一点,研究人员可以精确衡量智能体在整个状态空间中是否能做出最优决策。实验结果显示:

- 在较小棋盘上,经过大量训练和搜索的智能体整体表现尚可,往往能给出具有竞争力的走法;

- 但即便在这些小规模局面中,系统仍会出现盲点,时常错失数学上已知的最优解;

- 随着棋盘规模扩大,智能体的表现明显退化,其预测结果逐渐接近随机选择。

研究由此推断,对于像尼姆这样拥有清晰数学结构的公平游戏,仅依赖从原始局面中提取模式的学习方式并不足够,更需要某种解析性或抽象性的内部表示,才能在整个状态空间内保持稳定的最优表现。

对机器游戏研究的启示

研究团队强调,自我对弈的人工智能在国际象棋、围棋等复杂棋类游戏中已展现出惊人的实力,这项工作并非否定这些成果,而是试图更精细地划定现有方法的适用边界。

在尼姆这类双方共享“棋子”、且制胜策略可以用抽象算术规则精确刻画的游戏中,仅凭对局面图像或棋子分布的模式识别,往往难以完全捕捉到关键的数学结构。结果表明:

- 自我对弈方法在许多常见局面中仍能保持较强竞争力;

- 但在某些关键、却相对罕见的局面上,系统容易出现严重偏差,错失唯一的最优走法;

- 这类盲点在状态空间扩展后会更加突出,使整体表现趋向随机。

因此,研究者认为,未来的游戏人工智能可能需要引入能够表达抽象结构的机制,或采用将模式学习与符号推理、解析方法相结合的混合框架,以减少这类系统性盲点。

更广泛地看,这项研究提醒我们:

- 在常见情形下表现优异的系统,未必真正掌握了任务背后的原理;

- 在罕见但关键的情境中,模型仍可能表现得非常脆弱;

- 仅凭表面上的高水平成绩,难以判断系统是否学会了可解释、可推广的抽象规则。

伦敦玛丽女王大学的索伦·里斯(Søren Riis)博士指出:“尼姆是一个拥有完整数学解的儿童游戏,但采用AlphaZero风格的自我对弈时,系统仍会产生盲点——在许多局面中看似能保持竞争力,却依然错过真正的最优走法。”

他进一步表示:“这说明,在未来的人工智能研究中,令人印象深刻的表面表现并不能证明系统已经掌握了底层原理。我们可能需要能够捕捉抽象结构的方法,来系统性地减少这些盲点。”