由弗吉尼亚理工大学网络安全专家比马尔·维斯瓦纳斯(Bimal Viswanath)领衔的研究团队,发现了当前图像保护技术中的一个关键盲点。这些技术原本旨在阻止不法分子窃取在线图像,用于未经授权的人工智能训练、艺术风格模仿以及深度伪造。相关论文已发布在 arXiv 预印本平台上。

研究表明,攻击者无需复杂工具,只要利用现成的生成式人工智能(AI)模型,并配合简单的文本指令,就能有效破解多种现有图像安全机制。维斯瓦纳斯指出,目前还不存在一种“万无一失、具有数学保证”的方法,可以确保用户在公开发布图像后,仍能抵御基于现成生成式AI模型的攻击。

这项研究成果已在德国慕尼黑举行的第四届 IEEE 安全可信机器学习(Safe and Trustworthy Machine Learning)会议上进行展示。论文作者包括:维斯瓦纳斯、博士生泽维尔·普莱姆林(Xavier Premlinne)和西法特·穆罕默德·阿卜杜拉(Sifat Muhammad Abdullah)、助理教授高鹏,以及德克萨斯大学圣安东尼奥分校的穆尔图扎·贾德利瓦拉(Murtuza Jadliwala),和印度理工学院卡拉格普尔分校的贡詹·巴尔德(Gunjan Balde)与迈纳克·蒙达尔(Mainak Mondal)。

随着生成式AI工具的能力和可获得性不断提升,这项工作凸显出在网络安全、可信AI、隐私保护和数字取证等领域,迫切需要更强有力的技术防线。

生成式AI让图像欺诈门槛大幅降低

在生成式AI普及之前,想要绕过图像保护技术,攻击者往往需要设计专门的、定制化的攻击方法,才能利用真实图像进行深度伪造、面部身份盗用或艺术风格模仿。这在一定程度上提高了作恶门槛。

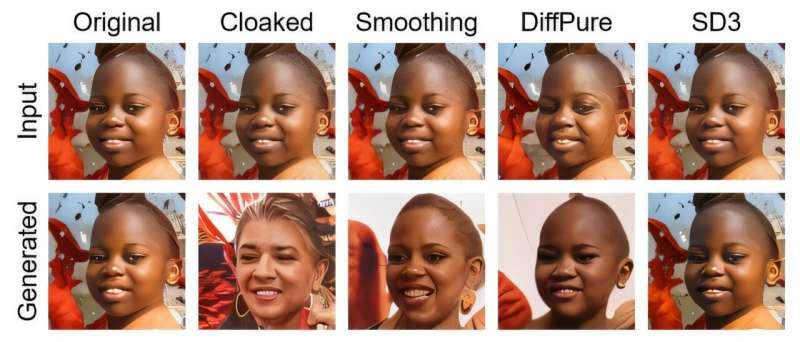

维斯瓦纳斯表示,如今情况已经发生根本变化:借助现成的图像到图像(image-to-image)生成式AI模型,再配合简单的文本提示,研究人员就能“轻松且高效地移除多种保护措施”。

团队通过八个案例研究,覆盖六种不同的图像保护方案,系统展示了这一安全缺口。这些被攻破的防御措施范围很广,包括:

- 旨在保护特定语义属性(例如个人面部身份)的扰动方案;

- 通过在模型潜在空间中注入隐形“保护噪声”的方法;

- 以及专门设计用来抵御后续微调任务的“强健”保护机制。

维斯瓦纳斯指出,他们提出的通用攻击不仅成功绕过了这些防御,而且在效果上还优于许多现有的专门攻击方法,同时仍然保留了图像对攻击者而言的实用价值。

竞速应对愈演愈烈的安全挑战

研究结果表明,当前图像保护技术存在一个关键且广泛的系统性漏洞:仅在图像中加入人眼难以察觉的保护噪声,已经不足以阻止数据抓取者和伪造者利用生成式AI进行攻击。

维斯瓦纳斯强调,这一发现尤其令人担忧,因为现有防护方案可能会给用户和平台带来一种“虚假的安全感”。他呼吁,必须尽快研发更为强健的防御技术,并确保未来任何新的保护机制,都能在面对基于现成生成式AI模型的攻击时依然有效。

这意味着,网络安全和AI安全社区需要从根本上重新审视保护视觉内容的技术路线和评估标准。

维斯瓦纳斯提出,未来的图像保护方案在评估时,必须以“来自广泛可用的现成生成式AI模型、由简单文本提示驱动的攻击”为基准,而不能只针对少数定制化攻击进行测试。同时,研究人员还应意识到,图像到图像的生成式AI模型本身会持续迭代升级,这将进一步加大防御工作的难度。