トランプ大統領は2026年2月28日、連邦政府機関に対し、米AI企業Anthropicの技術利用を停止するよう指示した。同日、OpenAIは米国防総省(Department of Defense, DoD)との合意を発表し、安全条項を明示したうえで機密環境へのAI展開を進めると明らかにした。

短期間のうちに、交渉停滞、供給網リスク指定の示唆、大統領による利用停止指示、そして別企業との契約合意が相次いだ。背景には、国防分野でのAI活用を巡る契約条件の解釈をめぐる対立があった。

交渉の焦点:「合法用途」の線引き

米国防総省はここ数年、生成AIの導入を急速に進めている。情報分析、作戦立案、データ統合など、国家安全保障に関わる幅広い領域でAI活用が拡大しており、Anthropicも機密ネットワーク環境向けにモデルを提供してきた企業の一つだった。

しかし、交渉で最大の争点となったのが契約に盛り込まれる「any lawful use(あらゆる合法用途)」という文言だった。

国防総省側は、法律に反しない限り、用途を包括的に制限しない形での利用を求めた。一方でAnthropicは、次の2点については例外として禁止を維持する姿勢を崩さなかった。

- 米国民を対象とした大規模な国内監視

- 完全自律型兵器の運用・開発

Anthropic CEOが立場を明確化

AnthropicのCEOダリオ・アモデイ氏は2月26日、声明を公表した。

“today’s frontier AI systems are simply not reliable enough to power fully autonomous weapons.”

(現在の最先端AIシステムは、完全自律型兵器を動かすには信頼性が不十分である。)

“we cannot in good conscience accede to their request.”

(倫理的・道義的責任を踏まえると、彼らの要求には応じられない。)

アモデイ氏は、国家安全保障目的での協力そのものを否定するわけではないとしつつも、「大規模国内監視」と「完全自律型兵器」については、契約上の例外として残す必要があると強調した。

国防長官、供給網リスク指定を示唆

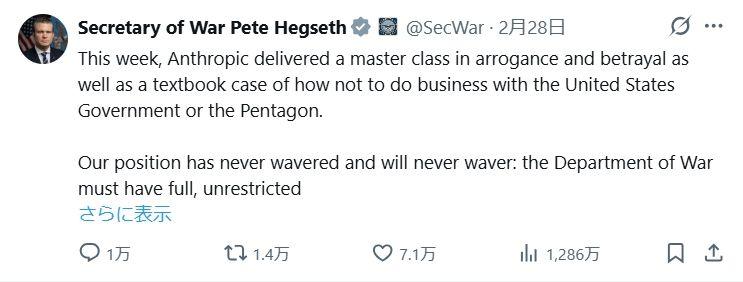

2月28日、ヘグセス国防長官はXに投稿し、Anthropicへの強い不満を表明した。

“the Department of War must have full, unrestricted access to Anthropic’s models for every LAWFUL purpose”

(国防総省は、あらゆる合法目的についてAnthropicのモデルに完全かつ無制限にアクセスできなければならない。)

“I am directing the Department of War to designate Anthropic a Supply-Chain Risk to National Security.”

(Anthropicを国家安全保障上のサプライチェーン・リスクに指定するよう指示する。)

と述べ、同社を安全保障上のリスクとして扱う方針を示唆した。

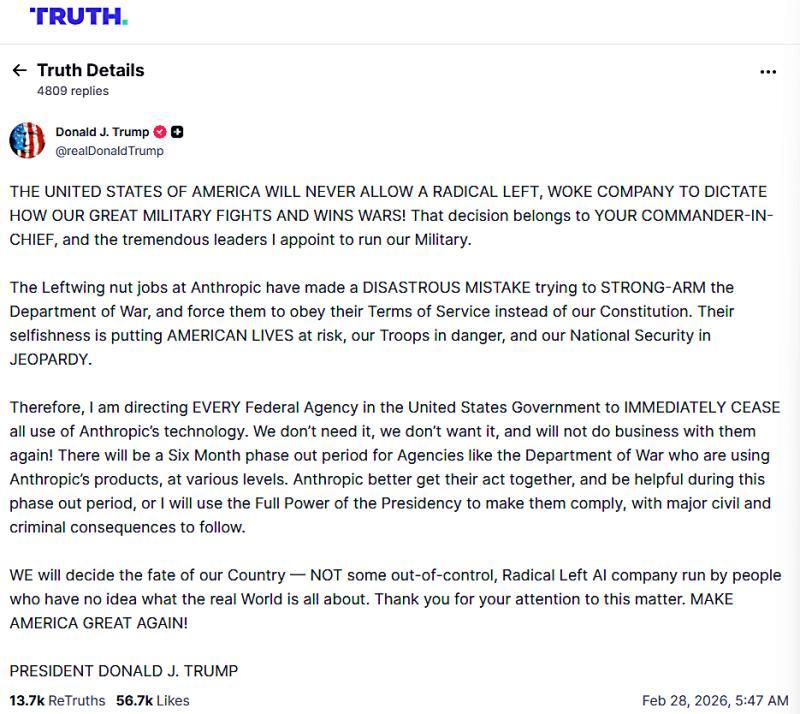

トランプ大統領、連邦機関に利用停止を命令

同じ2月28日、トランプ大統領は自身のSNS「Truth Social」で次のように投稿した。

“I am directing EVERY Federal Agency in the United States Government to IMMEDIATELY CEASE all use of Anthropic’s technology.”

(米国政府のすべての連邦機関に対し、Anthropicの技術の使用を直ちに停止するよう命じる。)

国防総省など一部機関については、既存システムからの切り替えを考慮し、6カ月間の移行期間を設けるとした。

Anthropicの反論と法的対抗姿勢

これを受けてAnthropicは公式声明を発表し、次のように反論した。

“No amount of intimidation or punishment from the Department of War will change our position.”

(国防総省からのいかなる威圧や処罰も、我々の立場を変えることはない。)

同社は、サプライチェーン・リスク指定の法的妥当性について争う構えを見せ、例外条項の撤廃には応じない方針を改めて示した。

OpenAIは「契約と技術設計で安全を担保」

一方、同じ2月28日、OpenAIは米国防総省との合意内容を公表した。

OpenAIもまた、「大規模な国内監視」や「自律兵器の指揮」には関与しない立場を明言している。ただし同社は、それらを単なる理念として掲げるのではなく、契約条文と技術アーキテクチャの両面から拘束力を持たせることで、国防総省との合意に至ったと説明した。

声明の中でOpenAIは、

- AIが自律的に軍事作戦を遂行するのではないか

- 兵器の設計・製造に利用されるのではないか

といった懸念に言及し、いずれも否定した。モデルが自律的に戦闘行為を行うことはなく、兵器そのものの設計・製造にも関与しないと明確に述べている。

また、国内監視への転用リスクについては、米国憲法修正第4条や関連法令を参照し、「無制約な監視(unconstrained monitoring)」を禁じる条項を契約に盛り込んだと説明した。

技術面では、モデルはクラウド環境に限定して運用し、エッジデバイスへの配備は行わない構成を採用したとした。さらに、安全スタックの運用権限をOpenAI側が保持し、監査ログや認証体制を通じて、契約上の制限が実際の運用で守られるようにするという。

OpenAIはあわせて、今回の合意条件を自社だけの特例とせず、他のAI企業との契約にも同様の基準を適用するよう国防総省に求めたことも明らかにした。例外条項そのものを守ることを優先したAnthropicとは対照的に、OpenAIは「レッドライン」を契約設計と運用構造の中に組み込むアプローチを取った形だ。

こうした交渉が続く中、ウォール・ストリート・ジャーナル(WSJ)は3月1日、米国によるイラン攻撃の過程でAnthropicのAIが使用された可能性があると報じている。