人工智能几乎已经渗透到生活的各个角落,其中就包括为盲人和低视力(BLV)人士提供支持的辅助技术。与其他应用场景类似,面向BLV人群的AI工具整体表现不错,却距离“可靠无误”还有明显差距。

康奈尔科技的研究团队在一项包含 20 名视力障碍参与者的研究中发现,他们基于多模态大型语言模型开发的应用,可以帮助BLV人士理解周围环境,对一般性的“这是什么?”类问题应对良好,但在处理更复杂的任务时——例如细致描述艺术作品——表现就不够理想。研究人员据此提出了九项可提升模型智能表现的“技能”。

康奈尔科技、雅各布斯理工-康奈尔学院以及康奈尔安·S·鲍尔斯计算与信息科学学院副教授 Shiri Azenkot 表示:“这项技术在解读视觉信息方面已经取得了很大进步,确实在帮助人们。但与此同时,我们希望它能持续变得更好,因此必须先弄清楚目前还存在哪些不足。”

人机交互方向博士生 Ricardo Gonzalez 是论文《多模态大型语言模型如何支持视力信息获取:盲人和低视力人士的日记研究》的第一作者。他在 2026 年 4 月 13 日至 17 日于西班牙巴塞罗那举行的计算机人因工程协会(ACM)人因计算系统会议 CHI 26 上报告了这项研究成果。

除资深作者 Azenkot 外,合著者还包括信息科学博士生、2025 届硕士生 Crescentia Jung;研究助理、2025 届硕士生 Sharon Lin;以及现任 Snap 软件工程师、2025 届硕士生 Ruiying Hu。相关论文收录于《2026 年 CHI 人因计算系统会议论文集》。

Azenkot 领导的 Enhancing Ability 实验室专注于让残障人士能够平等获取信息。对她而言,这项研究也带有个人意义:她本身是合法盲人,日常依靠导盲犬出行。

她指出,近年来人工智能对残障与无障碍技术领域的影响愈发明显。“作为一名视力障碍者,同时也是这些技术的使用者,我能非常直接地感受到它们在我日常生活中带来的变化。”

在这项研究中,Gonzalez 开发了一款视觉解读应用——一款智能手机 App,用户拍摄场景照片后,系统会给出反馈和说明。

“通过这款应用,你可以拍一页文字、你的电脑屏幕,甚至是一列正在行驶的火车,它都会尝试解读并告诉你画面里有什么。”Azenkot 介绍道。

团队采用的是多模态大型语言模型(MLLM),它在传统大型语言模型推理能力的基础上,加入了对图像、音频和视频等多种模态信息的接收、分析与输出能力。Gonzalez 强调,使用自己搭建的系统进行实验非常关键。

“通过完全掌控应用的内部机制,”他说,“我们可以在真实环境中部署研究,收集真正反映这些系统如何影响人们日常生活的数据。”

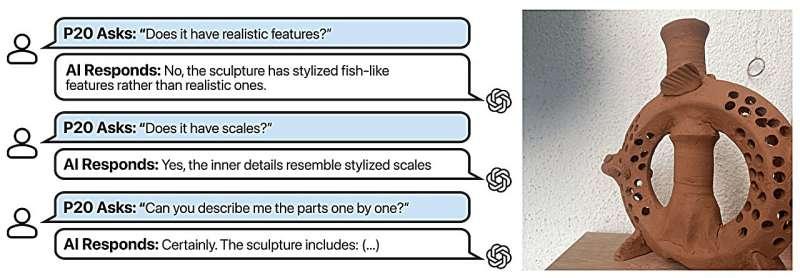

研究团队基于 GPT-4o 开发了一款名为 VisionPal 的 iPhone 应用,并招募了 20 名视力障碍程度各不相同的 BLV 参与者。研究在 2024 年 10 月至 12 月期间以日记研究的形式开展,每位参与者使用 VisionPal 两周,并记录使用体验。

每条日记记录都包括参与者拍摄的照片、照片的文字说明、参与者与 MLLM 的对话内容,以及参与者每天至少填写一次的简短问卷调查。

研究团队最终收集了数百次交互记录。结果显示,尽管参与者整体上对系统的满意度和信任度较高,但应用仍存在明显局限。尤其是在对初步视觉解读进行后续追问时——例如继续阅读烹饪步骤或药物剂量说明——VisionPal 仅有 56.6% 的回答是正确的,另有 22.2% 的回答包含错误信息。

“这些模型发展得非常快,”Gonzalez 说,“它们确实已经很有用,但我们仍需要持续审视它们,以了解这些系统在真实生活中可能带来的风险。”

为此,研究团队提出了“视觉助手”技能——即 MLLM 在提供视觉辅助时应具备的九类关键行为,以确保输出既与用户目标相关,又足够可靠。这些技能包括:

- 中立的事实沟通:保持客观,不加入不必要的主观判断;

- 适应性沟通协议:尽早确认并适应用户的沟通偏好;

- 目标导向协作:围绕用户当前目标,只传达与其环境和任务相关的信息;

- 透明的不确定性处理:在不确定或能力有限时主动说明,而不是“装懂”;

- 优雅的交接:在自身能力不足时,将问题转交给更合适的资源,或坦诚承认缺乏相关专业知识。

“我想强调的是,我确实认为这项技术已经取得了长足进步,”Azenkot 说,“但当我试图进一步改进这些技术时,首先遇到的总是与人相关的问题:人们真正需要什么?我们怎样才能更好地支持这些需求?”

“人应该始终处于中心位置,”Gonzalez 总结道,“因为这些工具存在的根本目的,就是满足人们的需求并改善他们的生活。”