当下,借助生成式工具进行“氛围编码”在软件开发团队中日益普及。此类工具可根据自然语言指令快速生成大量代码,在提升开发效率的同时,也被认为带来了更多潜在漏洞、安全隐患以及难以维护的代码片段。如何在不放慢交付节奏的前提下,对这类代码进行有效审查,正成为企业技术管理者面临的新问题。

在此背景下,Anthropic宣布在其开发者产品 Claude Code 中推出一项新的代码审查功能 Code Review,试图在问题代码进入主干代码库之前进行拦截。该功能于周一正式上线,并以“研究预览”(research preview)形式向 Claude for Teams 和 Claude for Enterprise 客户开放。

Anthropic产品负责人 Cat Wu 在接受 TechCrunch 采访时表示,Claude Code 在企业用户中的使用规模正在快速扩大,随之而来的是拉取请求(pull request)数量的明显上升。“企业领导者不断问我们一个问题:既然 Claude Code 产生了大量拉取请求,我如何确保这些请求能高效地被审查?”她说。

在常见的软件开发流程中,拉取请求是开发者在代码变更合入主分支前提交审查的机制。Wu 指出,Claude Code 显著提升了代码产出,导致审查环节成为交付流程中的新瓶颈。“Code Review 就是我们的解决方案。”她表示。

Anthropic在此时推出 Code Review,被视为与其业务布局相关。公司当天还就美国国防部将其列为供应链风险的决定提起两起诉讼。相关争议之下,Anthropic或将更加依赖其企业订阅业务。公司称,自今年年初以来,其订阅量已增长四倍;自 Claude Code 发布以来,该产品的年化收入已超过25亿美元。

据 Wu 介绍,Code Review 主要面向大型企业客户,包括 Uber、Salesforce、Accenture 等已在使用 Claude Code 的公司。“这些客户现在需要帮助来处理大量由 Claude Code 生成的拉取请求。”她说。

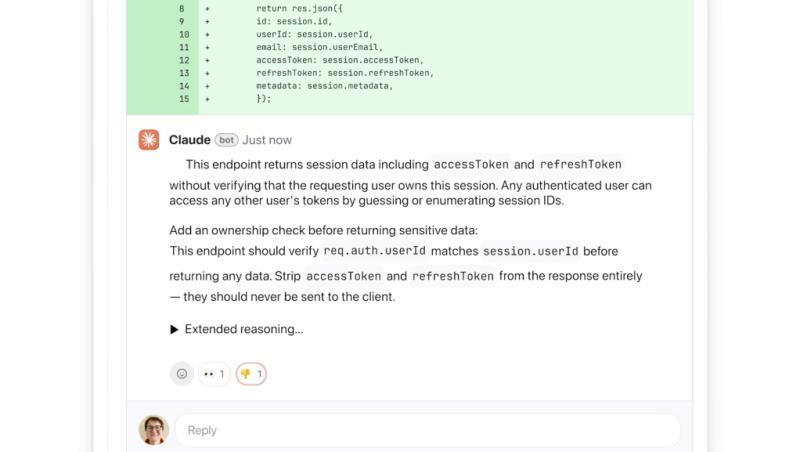

在具体使用方式上,开发负责人可以为团队工程师默认启用 Code Review。启用后,该功能会与 GitHub 集成,自动分析每个拉取请求,并在代码中直接留下评论,指出潜在问题并给出修复建议。Wu 强调,该工具的重点是识别和修复逻辑错误,而非调整代码风格。

“这非常重要,因为许多开发者此前已经见过自动化反馈,但当反馈无法立即采取行动时会感到烦躁。”Wu 表示,“我们决定专注于逻辑错误,这样能捕捉到最优先需要修复的问题。”

根据介绍,系统会逐步解释其推理过程,说明认为存在的问题是什么、为何可能带来风险以及如何修复。为便于开发者判断优先级,工具会通过颜色标记问题严重程度:红色代表最高严重性,黄色表示值得审查的潜在问题,紫色则对应与既有代码或历史漏洞相关的问题。

Wu 称,Code Review 采用多代理并行架构,不同代理从不同角度审查代码库,最后由一个代理汇总和排序发现结果,去重并突出最重要的问题。该工具还提供轻量级安全分析能力,工程负责人可以根据内部最佳实践配置额外检查。Anthropic 近期推出的 Claude Code Security 则面向更深入的安全分析场景。

多代理架构也带来了资源消耗方面的考量。Wu 表示,与其他类似服务一样,Code Review 的定价基于令牌使用量,费用与代码复杂度相关,她估计每次审查的平均成本在15至25美元之间。她将这一产品定位为“高端体验”,并认为在AI工具生成代码规模不断扩大的情况下,此类工具对企业而言正变得不可或缺。

“Code Review 是市场强烈需求的产物。”Wu 说,“随着工程师使用 Claude Code 开发,他们感受到创建新功能的摩擦减少,同时对代码审查的需求大幅增加。我们希望借助此工具,企业能够比以往更快地构建软件,同时减少更多漏洞。”