由人工智能研究员弗朗索瓦·肖莱(François Chollet)与Zapier联合创始人迈克·努普(Mike Knoop)共同创立的ARC奖基金会本周二发布新一代基准测试ARC-AGI-3。该测试被设计用于评估AI代理在陌生环境中的推理与学习能力,而非对既有数据的记忆与回忆。

重新定义“智能”测量方式

肖莱长期批评业界主流基准测试“奖励记忆而非智能”,认为现有评估更偏向考察模型对海量训练数据的记忆能力,而不是在新情境下学习新技能、解决新问题的能力。他表示,真正的智能在于“理解你从未见过的新事物、新任务的效率”,而不是通过“存储一张包含所有所需操作的查找表”来完成任务。

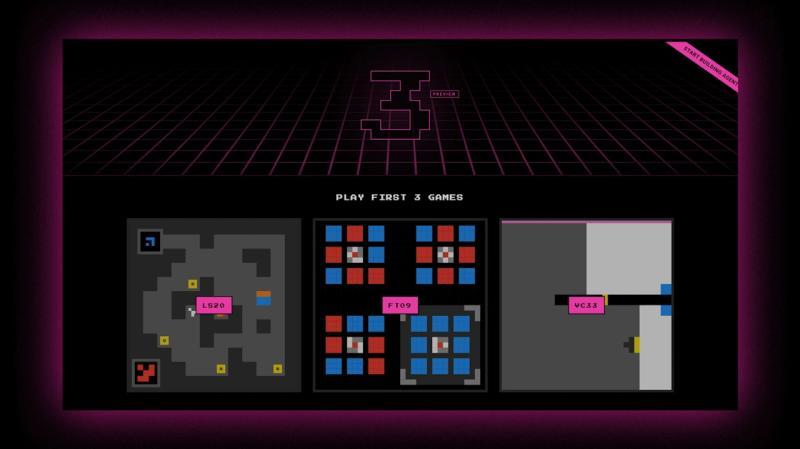

ARC-AGI-3延续这一思路,被基金会描述为目前最清晰衡量当今AI代理与人类智能差距的工具之一。该测试包含一千多个简单、类似电子游戏的场景,重点考察即时推理能力。测试中,AI代理在没有任何事先说明的情况下,需要自行理解游戏环境及其规则,并据此制定多步骤策略以达成目标。完成目标所用步骤越少、路径越高效,得分越高。

ARC奖基金会设立了最高100万美元的奖金池,用于奖励在该基准上取得突出成绩的团队。与此前的ARC测试一样,人类参与者通常可以相对轻松地完成这些任务,而许多现有AI系统在同类任务上的表现仍然有限。

与AGI讨论的关联

在业内流行的一种定义中,人工通用智能(AGI)被认为需要能够完成“人类执行的大多数具有经济价值的工作”。这类工作通常要求系统在陌生环境中处理未知情境,并能从以往经验中抽象出规律,推广到未被明确训练解决的新问题。

ARC-AGI-3的设计者认为,在这一基准上取得高分,可能构成AGI能力的某种证据。Laude研究所研究员安迪·康温斯基(Andy Konwinski)表示,他看重这一基准在当前评估体系中的差异性:一方面是测量AGI能力的尝试,另一方面是大型实验室普遍采用、每周追逐“0.5%性能提升”的标准基准套件。他所在的研究所通过Slingshots项目向ARC奖捐赠了2.5万美元。

ARC基准的起源与早期结果

首个ARC测试于2019年发布。当时,现今主流AI聊天机器人的基础——变换器(Transformer)架构问世仅两年,模型刚开始能够生成较为连贯的回答,但尚不具备实时推理能力,在ARC-1上的表现普遍不佳,这也限制了该基准在业界的早期影响力。

肖莱当时注意到,部分被描述为“博士水平”智能的系统,在ARC这类简单谜题上却频频失手。他认为,当最先进的AI系统在儿童可以轻松完成的任务上失败时,这是评估体系存在重大缺口的信号。

ARC-AGI-1的早期结果也触及当时主流技术路线的局限。努普表示,他认为ARC是“世界上最重要且尚未被攻克的基准”,因为它是“唯一明确反驳2023和2024年湾区极端推崇的规模化故事的证据”。当时,多家AI实验室坚信,通过持续扩大模型规模、训练数据和计算资源即可线性提升智能水平,最终实现AGI。然而,这些系统在推理时依然依赖静态的预训练权重,缺乏额外的推理机制。

从“规模化”到“推理层”

自2024年起,随着业界开始关注能够执行现实工作任务的自主AI代理,这一局面出现变化。肖莱表示,深度学习模型已经积累了足够多的知识,可以在此基础上“构建推理层”。

2024年9月,OpenAI发布研究预览版推理模型o1,该模型能够将复杂任务拆解为更小的子任务,并评估多条可能的解决路径。肖莱认为,这类模型“终于开始尝试解决深度学习范式中缺失的流动智能问题”。

随着研究重心转向推理能力,ARC基准的参考价值在部分实验室中上升。根据公开信息,o1模型在ARC-AGI-1上的得分为21%,而其前身GPT-4o得分为9%。

2025年1月,OpenAI发布新一代推理模型o3,其在ARC-AGI-1上的得分根据计算量不同在75%至87%之间,已接近人类水平。这一进展引发了关于ARC基准是否即将“被做满”的讨论。

ARC-AGI-2与“基准最大化”争议

随着更多模型在ARC-AGI-1上取得高分,部分研究人员开始质疑,这些成绩究竟反映了真实推理能力的提升,还是针对特定基准的工程优化。多家实验室开始采用专门的工程手段和系统架构来提升ARC表现。

为应对这一情况,ARC奖基金会于2025年5月推出ARC-AGI-2,试图提高基准对“针对性优化”策略的抵抗力。根据基金会披露的数据,o3模型在ARC-AGI-1上的得分约为87%,但在ARC-AGI-2上的初始得分仅为3%至4%。

此后,实验室继续探索提升ARC得分的方法,包括开发专门的软件“工具”,用于协调多次推理尝试、对结果进行评估并迭代改进。研究人员就这些工具是否真正体现了ARC希望测量的“流动推理能力”展开讨论。

肖莱认为,OpenAI在2025年为训练专门针对ARC-AGI-2的模型投入了“数千万”级别的计算资源,并利用公开的ARC谜题样本生成额外训练数据。他将这一做法形容为“预先的暴力破解……试图提前猜测所有可能的任务”。

努普表示,无论评价如何,这些策略在结果上是有效的:到2025年12月,ARC-AGI-2上的最高得分已提升至40%至50%。

ARC-AGI-3在代理竞赛中的角色

在上述背景下,ARC-AGI-3被设计得更难、更昂贵。肖莱预计,新一代基准同样会面临“被针对性优化”的问题,但他强调,ARC-AGI-3在任务设计和防御工程化策略方面的难度将进一步提高。

ARC-AGI-3发布之际,企业和投资者正押注规模可观的资金,希望AI代理能够承担大量知识密集型工作。尽管模型能力快速提升,但其在处理现实任务中的复杂性和不确定性方面是否具备足够“直觉”,仍存在疑问。若相关能力不足,可能影响代理系统实现真正自主性以及在企业中的广泛部署。

OpenAI方面也认可这一问题的重要性。该公司研究科学家诺姆·布朗(Noam Brown)在接受《Fast Company》采访时表示,AI进展速度“令人难以置信”,但在某些关键方面仍不及人类智能,其中最明显的一点是“在新环境中高效适应的能力”,而ARC-AGI-3正是为测试这一点而设计。他认为,这类基准有助于判断AI模型是在变得更通用,还是仅在既有优势领域进一步优化。

在实际应用中,AI代理可能会经历一个由人类工人进行训练和纠错的“宽限期”,随后才逐步建立信任并扩大职责范围。如果代理在关键任务上表现不佳,企业可能会对其大规模采用持谨慎态度。

ARC-AGI-3被部分业内人士视为回答两个问题的工具:当前代理是否足以赢得信任?如果尚未达标,如何判断它们何时具备所需能力?

实验室关注度上升

努普表示,相比ARC-AGI-1和ARC-AGI-2,他明显感受到来自前沿实验室对ARC-AGI-3“更高的关注和兴奋”。预计在2026年,多家实验室将围绕这一新基准展开系统优化与模型迭代。

他认为,这一趋势反映出部分前沿实验室的共识:在构建能够执行现实工作任务的AI代理时,“确实需要新思路”,“我们还没有全部弄明白”。

文章最后更新时已纳入OpenAI方面的评论。