Google 于 2026 年 4 月 2 日正式发布新一代开源模型家族 Gemma 4。这一系列模型基于公司旗舰大模型 Gemini 3 的最新研究成果打造,在复杂推理能力、工具调用以及 AI 智能体(Agent)场景上进行了重点强化。本次发布也是 Gemma 系列首次采用 Apache License 2.0,大幅放宽了商用、改造与再分发等使用限制。

基于 Gemini 研究成果的下一代开源模型

Gemma 是 Google 面向开发者社区开放的模型系列,用于将公司前沿的大模型研究成果以开源或开放形式对外提供。

在本次发布的 Gemma 4 中,Google 将 Gemini 3 系列 的研究成果下放到开源模型上,重点增强了:

- 复杂推理与逻辑能力

- 工具与 API 的调用能力

- 面向智能体(Agent)的工作流支持

据 Google 介绍,Gemma 系列模型迄今已被下载超过 4 亿次,衍生出的社区模型超过 10 万个。在这一庞大生态基础上,Gemma 4 被定位为面向下一阶段应用需求的「新一代开源模型家族」。

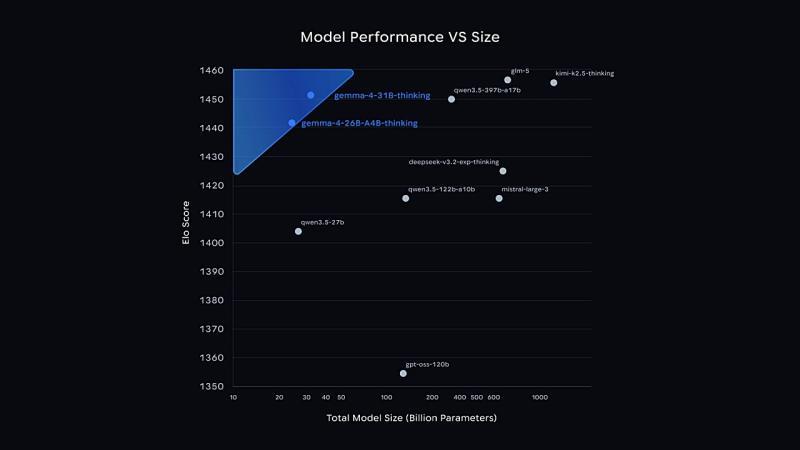

模型性能对比:Elo 评分表现

Google 公布的评测结果显示,Gemma 4 系列中的高端模型在参数规模与性能之间取得了较高的性价比。

在图中,诸如:

- gemma-4-31B-thinking

- gemma-4-26B-A4B-thinking

等模型,在相对较小的参数规模下取得了较高的 Elo 分数。

与图中列出的其他开源模型:

- Qwen

- Mistral

- DeepSeek

等相比,Gemma 4 的部分模型落在「更高性能 / 更高效率」的区域,显示出在模型体积与推理能力之间的良好平衡。

@YouTube

面向「智能体时代」的模型设计

Gemma 4 并非仅仅面向传统的文本生成任务,而是从一开始就以 AI 智能体(Agent) 的应用场景为核心进行设计。

其主要能力包括:

- 处理复杂的逻辑推理

- 生成多阶段、分步骤的任务计划

- 支持智能体式的工作流编排

- 原生支持工具与外部 API 调用

借助这些能力,开发者可以构建能够「规划 → 执行 → 调用外部工具」的一体化 AI 智能体,用于自动化业务流程、复杂信息检索、代码修改与执行等场景。

最多 25 万 Token 的上下文窗口

Gemma 4 高规格模型支持最长 250,000 Token 的上下文窗口。这一规模的上下文长度,使其适用于:

- 大型代码库的整体分析与重构

- 持续时间较长的多轮对话与协作

- 需要跨多文档、多步骤的复杂推理流程

对于需要处理长文档、长对话或复杂工作流的应用,这一能力可以显著减少「分段输入」「手动总结」等额外操作。

强调本地运行的「端侧 AI」设计

与许多仅面向云端的大模型不同,Gemma 4 在设计之初就强调 本地运行(On-device / Local AI) 的能力。

支持的设备包括:

- 智能手机

- 笔记本电脑

- 台式机等个人计算设备

在这些设备上,Gemma 4 可以直接在本地硬件上进行推理,无需将数据上传至云端。这种方式有助于:

- 提升隐私与数据安全

- 降低网络依赖与延迟

- 支持离线或弱网环境下的 AI 应用

模型家族构成

Gemma 4 根据不同的使用场景,提供了多种规模与结构的模型版本:

-

26B MoE

采用 Mixture of Experts(专家混合)结构,有效参数约 3.8B,在保证推理速度的同时提供较高性能,适合在 PC 等本地环境中运行高性能 AI 应用。 -

31B Dense

高密度(Dense)结构模型,重点优化输出质量,适合对回答精度、细节和一致性要求更高的任务,如专业问答、代码生成、复杂写作等。 -

Effective 4B

面向内存受限环境的高效模型,兼顾性能与资源占用,适合在移动设备、边缘设备或 IoT 场景中部署。 -

Effective 2B

体积最小的版本,面向实时响应、多语言交互等移动端场景,可在资源更有限的设备上实现基础推理与多语言任务处理。

多语言与多模态支持

Gemma 4 被设计为 多语言模型,支持 140+ 种语言,可用于全球化应用与跨语言场景。

在多模态方面:

- 2B 模型

- 4B 模型

支持将 语音与视觉输入 融合到同一模型中,实现多模态处理能力。开发者可以基于这些模型构建:

- 同时理解语音指令与屏幕内容的助手

- 结合图像理解与文本推理的应用

- 实时处理音频、图像与文本的交互式系统

采用 Apache 2.0 许可,放宽商用与再分发

在许可协议方面,Gemma 4 相比此前版本有重大变化:

- 早期 Gemma 系列采用的是 Google 自有许可

- Gemma 4 改为采用 Apache License 2.0

在 Apache 2.0 许可下,开发者可以:

- 自由用于 商用场景

- 对模型进行 修改与微调

- 将模型或衍生版本进行 再分发

- 将其集成到 开源项目 中

这一调整大幅降低了企业与个人开发者在法律与合规层面的顾虑,有望进一步扩大 Gemma 生态。

根据主导研发的 Google DeepMind 介绍,Gemma 4 在开发过程中沿用了与专有模型(Proprietary Models)同等级别的安全评估与安全协议,目标是满足 企业级(Enterprise) 使用场景对安全性与可靠性的要求。