OpenAI 于 2026 年 5 月 7 日(当地时间)宣布,将在 ChatGPT 中上线一项可选安全功能「Trusted Contact」。

「Trusted Contact」允许成年用户预先登记一位自己信任的联系人,例如朋友、家人或照护者。当 OpenAI 的自动系统与受过训练的人工审核人员综合判断,认为该用户在对话中可能表现出与自伤相关的严重安全风险时,系统有可能向这位联系人发出通知。

OpenAI 表示,这一功能是在 ChatGPT 已提供的各地区危机热线与求助信息基础上的补充,目的是在用户处于危机状态时,帮助他们在现实生活中与可信赖的人建立联系。该功能并不替代专业医疗照护或危机干预服务,而是作为多重安全措施中的一环。

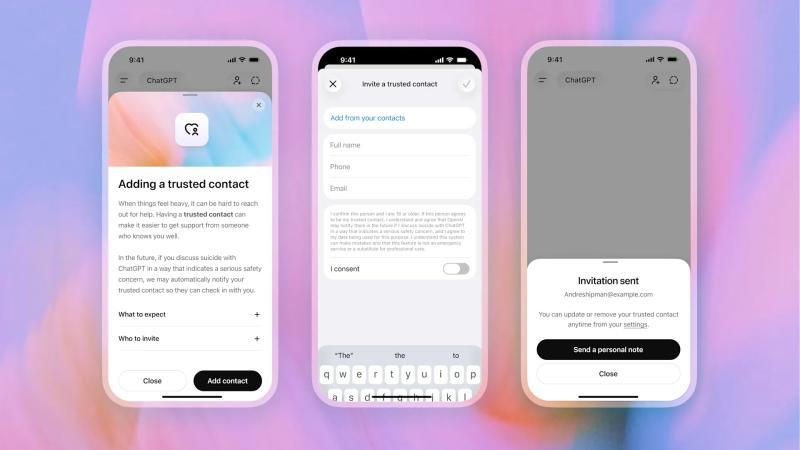

成年用户可登记 1 名可信联系人

在「Trusted Contact」功能中,用户可以通过 ChatGPT 的设置页面登记一名可信赖的成年人作为联系人。根据 OpenAI 的说明,该功能面向 18 岁及以上用户开放,在韩国则为 19 岁及以上。

根据 OpenAI 帮助中心的介绍,该功能目前仅适用于个人版 ChatGPT 账户,不适用于 ChatGPT Business、Enterprise 等共享工作空间。

当用户登记联系人后,对方会收到一封邀请,用于说明其在该功能中的角色。如果联系人在 1 周内接受邀请,「Trusted Contact」功能才会正式生效;若对方拒绝,用户可以改为邀请另一位成年人作为可信联系人。

每个符合条件的账户最多只能设置 1 名可信联系人。OpenAI 也提示,该功能正逐步向用户开放,如果在设置页面或 ChatGPT 对话中尚未看到相关选项,可能意味着当前地区或账户暂时还无法使用。

自动检测后再由人工审核决定是否通知

当 ChatGPT 的自动监测系统识别到用户的对话内容中,可能存在与自伤相关的严重安全风险时,系统首先会在对话中告知用户:有可能会向其预先登记的「Trusted Contact」发送通知。同时,ChatGPT 还会向用户提供一段可供参考的对话开场白,帮助用户主动与联系人沟通。

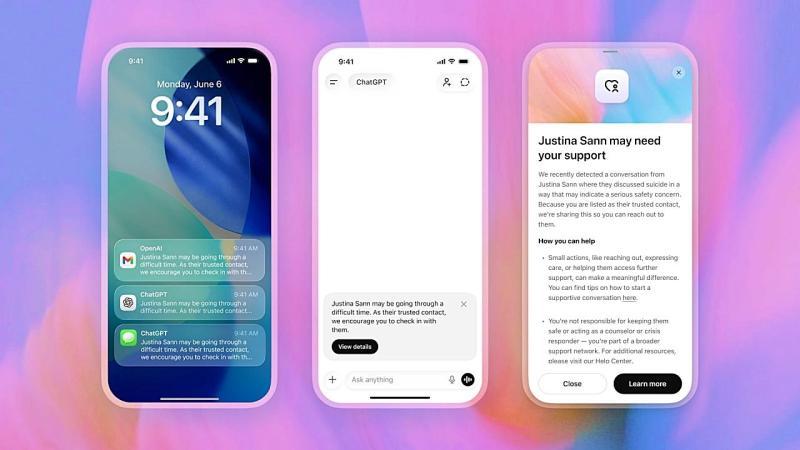

随后,少数经过专门培训的审核人员会对相关对话进行人工复核。如果他们认为对话确实可能反映出严重的安全隐患,ChatGPT 才会向可信联系人发出通知。

通知可能通过电子邮件、短信发送;如果该联系人本身也拥有 ChatGPT 账户,则还可能通过应用内通知的方式提醒。OpenAI 表示,将尽量在 1 小时内完成此类安全通知的审核流程。

不共享聊天全文与具体细节

OpenAI 强调,发给「Trusted Contact」的通知内容是经过刻意限制的。通知只会说明:该用户在与 ChatGPT 的对话中,可能出现了与自伤相关、并被视为具有严重安全隐患的内容,并建议联系人主动关心和确认用户的近况。

与此同时,通知不会包含聊天记录的全文或具体对话细节。OpenAI 表示,这样的设计是为了保护用户隐私。

公司也提醒,相关通知并不一定完全准确地反映用户的真实状态。所有通知在发出前,都会经过受过训练的人工审核人员的复核。

在临床与安全专家参与下开发

OpenAI 称,「Trusted Contact」功能是在多方专业意见基础上设计完成的,参与方包括专注于心理健康与自杀预防的临床医生、研究人员以及外部机构。

具体而言,OpenAI 参考了由 60 多个国家、260 余名持证医生组成的「Global Physicians Network」的意见,也吸收了「Expert Council on Well-Being and AI」的相关研究成果,并与美国心理学会(APA)等外部组织展开合作。

在 ChatGPT 的整体安全策略中,OpenAI 还在推进多项举措,例如:提供危机干预热线与紧急服务的指引、与心理健康专业人士合作改进回复质量、拒绝提供与自杀或自伤相关的有害指示等。

OpenAI 强调,「Trusted Contact」并不是让 AI 独自承担危机干预职责,而是帮助用户在关键时刻连接到他们事先选定的现实世界支持者。公司希望,AI 系统不是孤立运作,而是在必要时刻,能够把用户引导至现实世界中的照护体系、人际关系与支持资源。