研究:大型语言模型在内容审核中暗藏政治偏见

昆士兰大学团队发现,大型语言模型在扮演不同政治角色时,会在不显著影响整体准确率的前提下,引入稳定的一致性意识形态偏见,从而影响在线仇恨内容审核的公正性。

Reddit推行“人类验证”机制应对可疑机器人账户

Reddit宣布将对疑似自动化账户启动“人类验证”流程,并引入第三方工具核验账户背后是否为真人,以遏制平台上的垃圾信息和操纵行为。

Meta推出新一代内容执法系统 拟降低对第三方审核依赖

Meta宣布部署更先进的内容执法人工智能系统,用于打击恐怖主义、儿童剥削、毒品和诈骗等违规内容,并计划在系统表现优于现有方法后减少对第三方供应商的依赖。

模仿聊天机器人的人类互动网站走红:一周获约5000万次浏览

程序员Mihir Maroju推出的游戏化网站“Your AI slop bores me”以戏仿方式借用ChatGPT等聊天机器人的交互形式,但由真实用户彼此充当“AI”回答问题,在短时间内吸引大量访问。

微软在Copilot Discord频道屏蔽“Microslop”一词引发热议

微软在官方Copilot Discord服务器中短暂启用针对“Microslop”等词汇的过滤措施,称目的是应对垃圾信息攻击,但相关做法迅速在社交媒体上扩散,引发关于“斯特赖桑效应”的讨论。

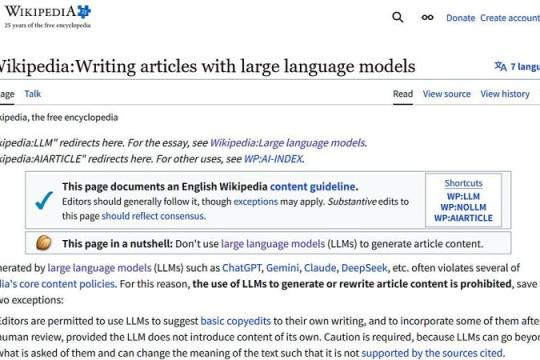

英语版 Wikipedia 明确禁止使用 LLM 生成条目正文,社区投票通过新指南

英语版 Wikipedia 通过社区投票,正式制定新指南:原则上禁止使用 ChatGPT 等大规模语言模型直接生成或改写条目正文,但在翻译、语法修正等编辑辅助场景下仍允许有限使用。

OpenAI再次推迟面向成年用户的“成人模式”功能

OpenAI原计划在去年12月上线、后延至今年一季度的“成人模式”功能再度推迟,公司称将优先投入资源于提升ChatGPT智能和交互体验。

Roblox上线实时聊天重述功能 强化禁用语言过滤

Roblox推出实时AI驱动聊天重述功能,在过滤禁用语言的同时保留对话连贯性,并升级文本过滤系统以提升对“变形文字”等规避手法的识别能力。

AI生成文本激增冲击各类机构 应对手段陷入“军备竞赛”

从科幻杂志到法院、学术期刊和招聘市场,大量AI生成文本正涌入各类机构,迫使其在防范欺诈与利用新工具之间寻找平衡。

Twitch 调整封禁政策 引入直播与聊天两类处罚

Twitch 宣布对现行封禁机制进行结构性调整,从单一封禁模式改为区分直播封禁与聊天封禁,并强调严重违规仍将面临无限期封禁。

UpScrolled用户激增后仇恨言论暴露内容审核压力

在TikTok美国所有权变更后迅速走红的社交平台UpScrolled,被曝未能有效处理平台上的种族歧视和仇恨内容,相关用户名、标签及多媒体内容持续在线。

CHAI称过去三年保持三倍年增长 年度经常性收入达6800万美元并披露AI安全措施更新

CHAI表示,过去三年公司保持三倍年增长,年度经常性收入达到6800万美元,估值为14亿美元。公司同时披露多项AI安全与合规举措,涵盖内容审核、自杀与自残风险识别、运营透明度与隐私保护等。