研究:大型语言模型在内容审核中暗藏政治偏见

昆士兰大学团队发现,大型语言模型在扮演不同政治角色时,会在不显著影响整体准确率的前提下,引入稳定的一致性意识形态偏见,从而影响在线仇恨内容审核的公正性。

研究:人工智能与人类协作优于单独取代人类

新研究表明,人工智能最具价值的应用在于强化人类思考与决策,而不是完全替代人类。通过将AI的运算能力与人类的创造力和判断力结合,可在多领域显著提升知识创造与传播效果。

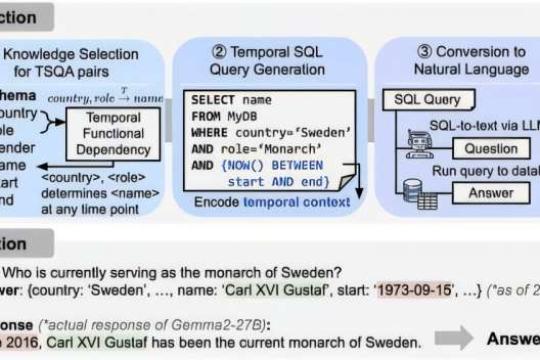

人工智能修正“时间错觉”,提升医疗与法律场景可靠性

韩国科学技术院团队提出一套基于时间数据库的新评估技术,可自动生成时间敏感问答题目并检测“时间错误”,显著提升大型语言模型在动态现实信息下的可靠性。

研究:用户对数据泄露的负面反应消退比预期更快

新研究发现,即便在严重数据泄露事件后,用户对平台的不信任和愤怒情绪会在数月内明显减弱,最终与未受影响用户几乎无异。

研究:人工智能伴侣或缓解孤独,却可能在长期加重心理痛苦

一项基于Reddit数据与深度访谈的长期研究发现,AI伴侣在提供持续情感支持的同时,可能提高人们对现实人际关系的“心理成本”,让用户逐渐疏远他人,并在语言中表现出更多孤独和痛苦迹象。

研究称ChatGPT偏爱“伪文学”无稽文本引发警示

一位德国学者发现,OpenAI的GPT模型在评估文本时,往往对充满“伪文学”色彩的无稽之谈给出高分,这一现象被认为可能对人工智能发展带来风险。

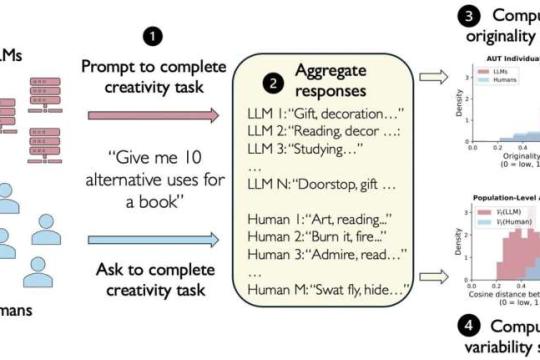

大型语言模型与创造力:AI 答案整体更趋同质化

一项发表在《PNAS Nexus》上的研究发现,单个大型语言模型在创造力评分上可与人类相当甚至更高,但不同模型之间的输出高度相似,整体多样性明显低于人类。研究者指出,广泛依赖 LLM 进行创意工作,可能在无形中削弱人类思维的多样性。

研究:高性能 AI 代理在识别欺骗方面仍存在明显短板

新研究发现,大型语言模型在复杂任务上表现出色,并不意味着它们同样擅长识别欺骗或不可靠信息,这对其在法律、医疗和金融等关键领域的应用安全提出了警示。

研究人员提出新框架:为生成式人工智能引入“元认知”机制

美国学者提出一套数学框架,尝试让大型语言模型具备监控和调节自身推理过程的能力,用于在高风险场景中更好识别不确定性并提升决策透明度。