大型语言模型会让创意变得更“雷同”吗?

使用大型语言模型(LLM)到底能不能真正提升人的创造力?已有研究提示,引入 LLM 往往会让创意产出变得更加同质化。不过,这种同质化究竟是由某个特定模型造成的,还是因为大家都在使用类似的模型所致,一直没有定论。

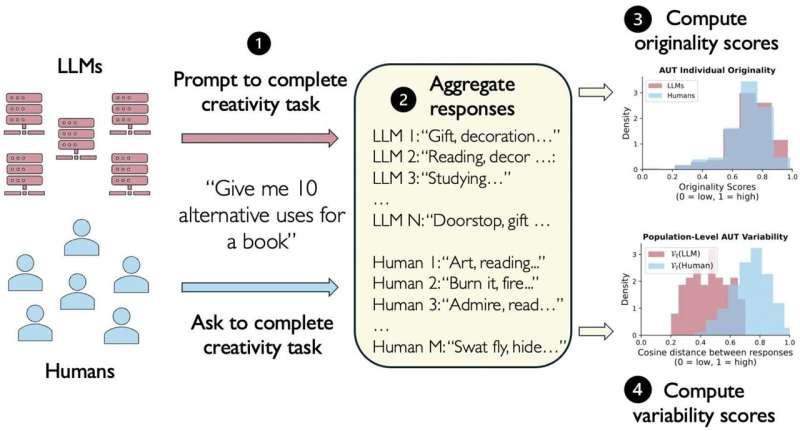

近期发表在《PNAS Nexus》上的一项研究,对这一问题进行了系统检验。研究由 Emily Wenger 和 Yoed N. Kenett 主导,他们招募了来自 Prolific 平台的人类参与者,并同时调用多种主流大型语言模型,让二者完成一系列用于评估不同维度创造力的任务。

研究设计:人类 vs 多种 LLM

在实验中,人类参与者和多个 LLM 被要求完成多种类型的创造力任务,例如:

- 非常规用途任务:

- 要求参与者尽可能多地想出某个日常物品(如叉子、裤子)的各种用途。

- 多样名词任务:

- 要求参与者给出 10 个名词,这些名词之间要尽可能彼此不同。

通过这些任务,研究者可以同时考察“想法数量”和“想法之间的差异程度”,从而衡量创造力的丰富性与多样性。

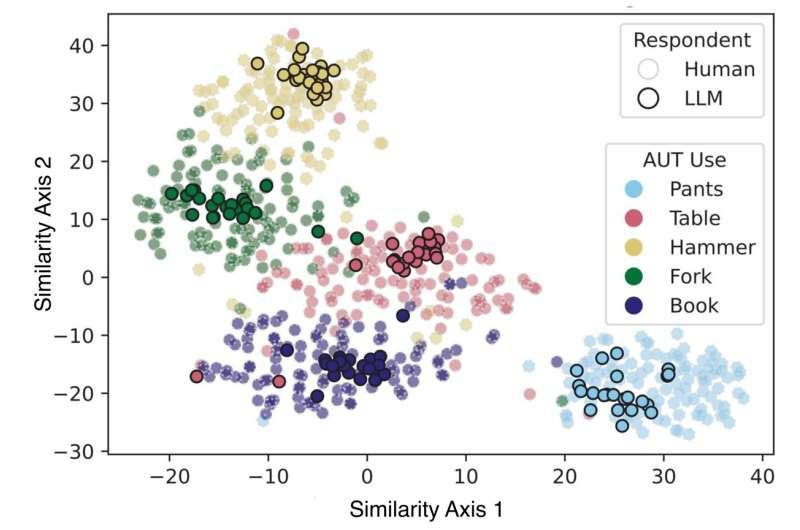

结果:单个模型看似有创意,整体却更趋一致

研究发现,在整体层面上,LLM 的回答彼此之间要比人类参与者的回答相似得多,人类给出的答案在内容和风格上都展现出更高的多样性。

如果只看单个模型的表现,情况则有所不同:

- 对于某一具体任务,单个 LLM 的回答在创造力评分上,往往能达到甚至超过人类平均水平。

- 也就是说,单独比较时,LLM 的输出并不显得“缺乏创意”。

但当研究者把不同 LLM(例如 Gemini、GPT、Llama 等)的输出放在一起比较时,问题就显现出来了:

- 不同模型之间反复出现高度相似的想法和表述,

- 整体上形成了一个“创意高度重叠”的答案空间。

温度调节:多样性与可用性之间的拉扯

研究还考察了模型“温度”参数的影响。温度用于控制模型输出的随机性:

- 提高温度:回答会比低温度时更具变化,内容更加多样;

- 但温度过高:输出很快会变得支离破碎、缺乏连贯性,甚至出现明显不符合任务要求的无意义内容。

这意味着,单纯依靠调高温度来追求多样性,会以牺牲答案质量和任务可用性为代价,难以真正解决“同质化”问题。

结论:同质化源于 LLM 的广泛使用,而非某个单一模型

作者据此推断,输出同质化更可能是普遍依赖 LLM 本身带来的系统性结果,而不是某一个特定模型的独有问题。

从更深层的角度看,LLM 在本质上缺乏:

- 身体与真实世界的感知经验,

- 个人经历与生活背景,

- 内在意图与动机,

- 稳定的个性特征,

- 对世界的真正理解能力。

而这些因素,很可能是支撑人类创造力、尤其是多样化思维的关键基础。作者指出,目前尚不清楚,未来是否能够通过改进 LLM 的架构或训练方式,让其在创造力上真正达到或超越人类水平。

对人类思维的潜在影响

研究最后提醒,如果在头脑风暴、问题求解或艺术创作等环节过度依赖 LLM:

- 人类可能会在不知不觉中接受那些看似合理却高度同质化的答案,

- 长期下来,可能削弱个人和群体在思考路径、表达方式和创意风格上的多样性。

换言之,LLM 在提供便利和效率的同时,也可能在悄然重塑我们的思维模式,这一影响值得持续关注和审慎评估。