1972 年,诺贝尔物理学奖得主菲利普·W·安德森提出了极具影响力的“多即不同”(More is Different)观点,直指还原论的局限。他指出,许多系统在更高层级上呈现出的“涌现性质”,无法直接从支配其基本粒子的底层定律中推导出来。

这一思想的推广意味着:科学世界具有层级结构。能够在小尺度上被解释的性质,并不必然能预测同类系统在更大尺度下会出现什么现象。安德森的视角跨越多个学科,不仅包括物理学,还延伸至化学、分子生物学、细胞生物学以及社会科学等领域。

当安德森提出这一哲学主张时,基于复杂架构和海量数据的机器学习应用尚未出现。机器学习和人工智能(AI)在日常生活中承担与人类智能相似的任务,实际上只是近二十年来才逐步普及的现象。

如今,“多即不同”与人工智能模型之间的关联,已经可以通过定量方式进行检验。巴伊兰大学物理系及 Gonda(金施密德)多学科脑研究中心的伊多·坎特(Ido Kanter)教授在近期发表在《Physica A: Statistical Mechanics and its Applications》上的论文中,对这一问题进行了系统研究。论文的核心结论是:从信息论的角度看,物理学更接近“多即相同”,而人工智能则体现出“多即不同”,这种差异源自学习过程以及节点架构之间的协同作用。

研究表明,随着人工智能模型不断学习,其内部单元——即所谓的“节点”——会逐渐走向功能专门化。不同节点不再执行完全相同的任务,而是各自承担不同的角色,例如识别特定模式、捕捉特定语言特征等。这种分工使整个系统的处理效率显著提升,说明人工智能的能力并非单纯依赖模型规模,而是依赖于这些专门化组件之间的协调互动。

“即便是语言模型中的单个节点,也可能携带关于模型整体任务的有意义信息。”坎特教授指出,“当多个节点协同工作时,它们的综合能力会超出各自贡献的简单相加,这正是涌现智能的具体体现——多即不同。”

研究同时强调了人工智能系统与许多物理系统之间的根本差异。在传统物理系统中,单个组成部分往往已经反映了与多个组成部分相同的系统信息,这种情况可以概括为“多即相同”。在这类系统中,简单增加组件数量,并不会线性地增加关于系统状态的总信息量。

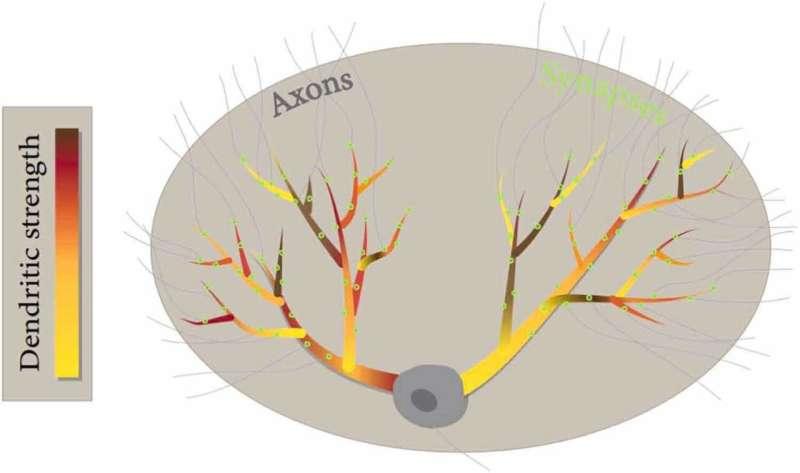

这些结果可能对神经科学产生重要启示。结合关于“树突学习”可作为突触可塑性替代机制的实验证据,坎特教授提出,大脑中单个神经元的功能或许比以往设想的更加专门化、信息含量也更高。

总体来看,该研究指向一个更广泛的结论:人工智能中的“智能”很可能并非主要来自规模扩张,而是来自个体组件的专门化程度、信息承载能力以及它们之间的协同工作方式。有时,理解人工智能的未来,需要从物理学中的一个基础性问题重新出发。