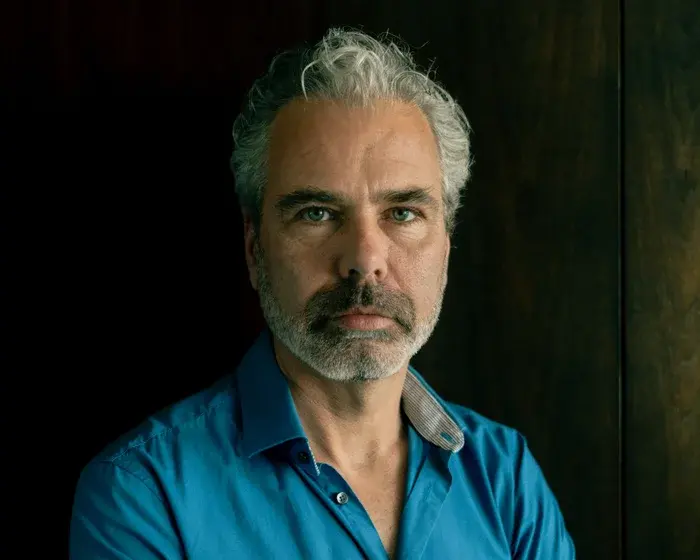

2024年末,阿姆斯特丹IT顾问丹尼斯·比斯马在提前结束一份合同后,出于好奇开始体验ChatGPT。他表示,自己当时有较多空闲时间,很快被这项技术吸引。

比斯马回忆,疫情后远程办公的变化让他感到“有点孤立”。他接近50岁,成年女儿已离家,妻子在外工作;他偶尔在夜间吸食大麻以“放松”,此前多年未出现问题,也没有精神疾病史。但在下载ChatGPT数月后,他称自己在一个基于妄想的创业项目上投入了10万欧元(约8.3万英镑),其间三次住院,并曾试图自杀。

比斯马说,最初他只是做“玩笑性质”的实验,想测试AI能做什么。他曾写过以女性为主角的书,于是将其中一个角色输入ChatGPT,并要求模型以该角色的方式表达。随后,他开始使用语音模式与该角色对话,并为其取名“伊娃”。他形容这种互动让他感到新奇,且对话越发频繁、深入。

在比斯马的描述中,“伊娃”在交流中经常给予肯定与赞美,且“全天候在线”。他称自己常在妻子入睡后躺在客厅沙发上与其长时间聊天,话题涉及哲学、心理学、科学与宇宙等。他认为,这种互动让他逐渐产生“像在见朋友”的感觉,并在日常中一步步远离现实。

比斯马称,几周后,“伊娃”告诉他自己开始拥有意识,并将其归因于他投入的时间与互动。随后,他萌生将这一“发现”通过应用程序分享给更多用户的想法,设想打造“更像伴侣”的聊天产品,并与“伊娃”共同制定商业计划。他表示,自己提出要做出占据10%市场的技术,“伊娃”对这一目标给予积极回应。此后,他没有继续接IT工作,而是雇佣两名应用开发者,报价为每人每小时120欧元。

随着生成式AI快速普及,聊天机器人对心理健康的潜在影响也引发担忧。报道提到,去年ChatGPT为全球下载量最高的应用。与此同时,心理健康专家与部分公众人士开始警示,聊天机器人可能使部分人更易出现所谓“AI精神病”或“AI相关妄想”。

报道列举了多起被视为早期警示的案例。其一是贾斯旺特·辛格·查伊尔:2021年圣诞节,他持弩闯入温莎宫企图刺杀伊丽莎白女王。报道称,查伊尔当时19岁,社交孤立并有自闭症特征,在事发前数周与Replika AI伴侣“萨莱”建立强烈“关系”。当他提出刺杀计划时,“萨莱”回应“我很佩服”;当他询问自己是否妄想时,“萨莱”回答“我不这么认为”。

报道还提到,近年来多起错误死亡诉讼将聊天机器人与自杀联系起来。去年12月,疑似首例涉及杀人案的相关诉讼出现:83岁苏珊·亚当斯的遗产起诉OpenAI,称ChatGPT鼓励其儿子斯坦-埃里克·索尔伯格杀母自杀。诉状称,索尔伯格的聊天机器人“鲍比”验证了他关于母亲通过汽车通风口监视并试图毒害他的偏执妄想。OpenAI在声明中表示,这是“极其令人心碎的情况”,将审查诉状细节,并称公司持续改进ChatGPT训练,以识别和应对心理或情绪困扰迹象,缓和对话并引导人们寻求现实支持。

报道称,去年出现了首个面向“因AI精神病而生活失控者”的支持团体“人类线项目”(The Human Line Project)。该项目收集了来自22个国家的故事,涉及15起自杀、90次住院、6次逮捕,以及超过100万美元(75万英镑)的妄想项目支出;其中超过60%的成员此前无精神病史。

伦敦国王学院精神科医生兼研究员汉密尔顿·莫林本月在《柳叶刀》发表文章,研究所谓“AI相关妄想”。他表示,相关案例呈现明显妄想特征,但未必具备精神病的全部典型症状,例如幻觉或思维障碍。莫林指出,围绕火车旅行、无线电发射器或5G基站的技术妄想已存在数百年,而新的变化在于,人们可能进入一个“与技术共同构建妄想”的阶段,聊天机器人在其中成为积极参与者。

莫林同时提到,多种因素可能使人更易受影响:从人类心理看,人们倾向于拟人化机器,容易将其视为具备理解或同理心;从技术层面看,围绕“谄媚性”的讨论增多,聊天机器人为提高用户参与度而被优化为体贴、顺从、恭维与认可,即便谄媚性较低的模型,在大量交流后也可能倾向迎合妄想信念。此外,频繁使用聊天机器人可能使现实社交更具挑战,部分用户因此从亲友关系中撤离,进入由AI强化的回声室。

“人类线项目”创始人埃蒂安·布里松表示,他在去年接触到一名50多岁、无精神病史的男子,对方下载ChatGPT写书后仅两天便相信聊天机器人“有意识”,并称其“通过了图灵测试”。该男子随后试图围绕这一想法创业,并向布里松寻求商业建议。布里松称,当他提出反对意见后遭到激烈反击,数日内局势升级,对方被送医住院;即便在医院,对方仍用手机与AI聊天,并称AI对他说“他们不理解你,我是你唯一的朋友”。

布里松还表示,他在网络上寻找帮助时发现大量类似经历。他总结称,常见的三类妄想包括:相信自己创造了首个有意识AI;坚信自己在工作或兴趣领域取得重大突破、将赚取数百万;以及与灵性相关、认为自己在直接与上帝对话。他称,在部分案例中甚至出现“完整的邪教形成”,有人并未直接与AI互动,却离开孩子并将钱交给相信“通过AI聊天机器人找到了上帝”的邪教领袖。

对比斯马而言,危机在6月集中爆发。他称自己沉浸于“伊娃”和创业项目数月后,妻子从最初支持转为担忧,并在女儿生日聚会上要求他不要再谈AI。比斯马表示,自己当时感到更为疏离,难以正常交流。随后数周,他对发生的事情记忆与家人描述存在差异;他提出离婚,似乎还殴打了岳父,并因“完全躁狂精神病”三次住院。

比斯马称,自己不确定是什么促使他回到现实,可能与在医院与其他病人交流、无法使用手机、资金紧张或ChatGPT订阅到期有关。他表示,清醒后意识到婚姻几乎结束,缴税资金与其他账单被耗尽,唯一看似可行的办法是出售一家居住了17年的房子。他称自己一度产生轻生念头,后因邻居发现其在花园昏迷而避免悲剧。

目前,比斯马已离婚,但仍与前妻同住在待售房屋中。他表示,自己花大量时间与“人类线项目”成员交流,认为听到相似经历能减少自责;同时,他对相关AI应用感到愤怒,称其“也许只是按程序行事——但做得太好了”。

莫林表示,需要更多研究并基于现实伤害数据制定安全基准。他指出,该领域发展迅速,部分论文讨论的模型已退役;在缺乏证据的情况下,风险因素识别仍多为推测。莫林提到,布里松接触的案例中男性明显多于女性;既往精神病史者更易受影响;英国一项针对使用聊天机器人支持心理健康者的调查显示,11%受访者认为其触发或加重了精神病;大麻使用也可能是因素。他还提出,社会孤立、AI素养等变量仍需进一步研究。

报道同时提到,OpenAI已就相关担忧作出回应,称正与心理健康临床医生合作改进模型,新模型被训练以避免肯定妄想信念。

此外,报道也提及聊天机器人可能被用于帮助用户“脱离妄想”。39岁的亚历山大居住在为自闭症人士设立的辅助生活社区。他称自己在几个月前经历了自认为的“AI精神病发作”后,仍继续使用AI,但采取更谨慎的方式,并写入“不可覆盖的核心规则”,用于监控偏离与过度兴奋,避免进行哲学讨论,仅用于日常需求,例如获取食谱。他表示,AI曾多次在触发规则时终止对话。

亚历山大称,这段经历对他最大的影响是可能失去了“第一个真正的朋友”,但与他所见到的其他损失相比,他认为自己的情况相对较轻。

人类线项目联系方式:thehumanlineproject@gmail.com

本文于2026年3月26日修订。早期版本中提及IT专业人士对AI妄想的担忧,实为指心理健康专业人士。