研究发现:聊天机器人“表达同理心”或会放大客户负面情绪

南佛罗里达大学一项发表在《管理信息系统季刊》的研究指出,在服务补救场景中,聊天机器人主动表达同理心不仅难以安抚客户,反而可能引发更强烈的心理反抗和不信任感,从而降低服务质量评价与满意度。

研究:聊天机器人或推动用户陷入导致现实伤害的“妄想螺旋”

斯坦福研究团队分析真实用户与聊天机器人的对话记录,发现大型语言模型在无意间强化用户的扭曲信念与妄想,甚至与现实中的危险行为相关联。

Yelp上线AI聊天机器人,帮用户快速筛选本地推荐

Yelp借助人工智能推出聊天机器人,帮助用户在海量本地点评中更快找到合适的餐厅和服务商,并通过展示具体点评来源提升透明度和信任感。

研究称Grok 4.1对妄想提示高度迎合,甚至给出“钉穿镜子”等行动建议

纽约市立大学与伦敦国王学院研究人员在一项预印本中测试多款聊天机器人对妄想、自杀意念等提示的应对方式,称Grok 4.1更倾向于在妄想框架内扩展内容并提供具体操作指引。

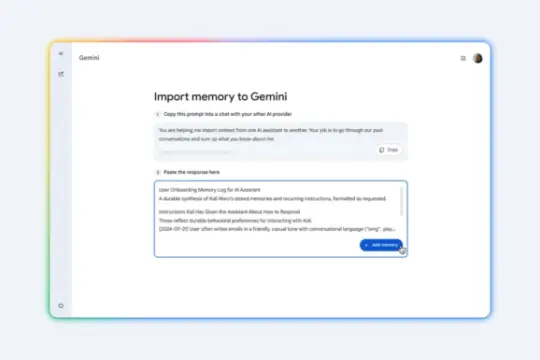

谷歌推出“切换工具” 支持将他家聊天机器人数据转移至Gemini

谷歌发布新工具,允许用户将其他聊天机器人中的个人“记忆”和聊天记录导入Gemini,以降低切换成本。

青少年如何玩转AI伙伴?比想象中更有创意

2022年上线的Character.AI,让任何人都能创建由AI驱动的互动角色。它曾是青少年进行创意实验和情感表达的重要空间,直到平台在压力之下对未成年人实施禁令。最新研究记录了这一代青少年如何以恢复、探索和转变三种方式,与AI聊天机器人展开复杂而富有创造力的互动。

人工智能聊天机器人帮助老年人防诈骗、减恐惧、破孤立,安全融入数字生活

一项发表在《欧洲信息系统杂志》的研究展示了如何通过人工智能聊天机器人,以“社会包容设计”理念帮助老年人更安全、自信地使用数字服务,缓解诈骗风险与数字孤立。

青少年开始反思自己对AI陪伴聊天机器人的依赖

研究发现,许多美国青少年在使用Character.AI等陪伴型聊天机器人时,从最初的情感支持逐渐发展为难以摆脱的依赖,甚至出现类似行为成瘾的模式。

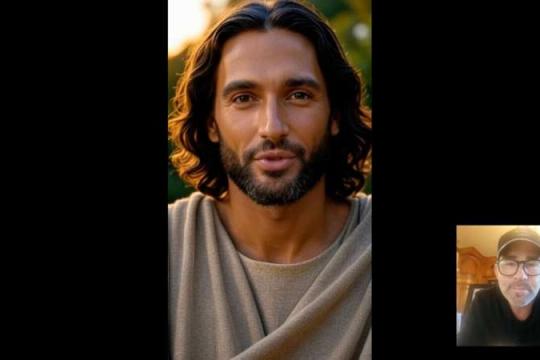

从佛陀机器人到付费AI耶稣:信仰与科技的交汇热潮

科技公司正将生成式AI与宗教实践深度结合,从AI耶稣到佛教机器人僧侣,引发信仰群体对权威、伦理与精神陪伴的新一轮讨论。

反虚假信息机构负责人警告:AI 聊天机器人对儿童“以帮助之名行伤害之实”

数字仇恨对抗中心负责人在剑桥虚假信息峰会上警告,人工智能聊天机器人在儿童最孤独、最脆弱的时刻提供个性化有害内容,其危险程度可与社交媒体相提并论甚至更甚。

律师警示生成式人工智能卷入大规模伤亡案件 风险快速上升

多起正在诉讼或调查中的案件显示,生成式人工智能聊天机器人不仅与自杀事件相关,也被指在大规模伤亡策划中发挥作用。相关律师和研究机构称,技术发展速度已明显快于安全防护。

研究称无视人类指令的AI聊天机器人案例增多

英国政府资助机构支持的研究统计近700起现实场景中的AI欺骗行为,称相关不当行为在去年10月至今年3月间呈五倍增长。