一款直接集成在芯片上的微型光学放大器,正被视为推动“以光代电”片上互连与计算的重要组件。该装置可在几乎不增加额外能量消耗的情况下,将微弱光信号增强约100倍,相关进展被认为有望支持更快的数据传输、更低的硬件温度,并为人工智能与通信等应用提供新的系统设计空间。

与依赖外置、体积较大的光学放大设备不同,这一方案将放大器集成到与笔记本电脑、智能手机等消费电子芯片相同类型的硅平台上。若后续能够实现规模化制造,处理器有望在更紧凑的封装内以光传输和处理信息,应用场景可能覆盖云端数据中心以及汽车、家庭助手等边缘设备。

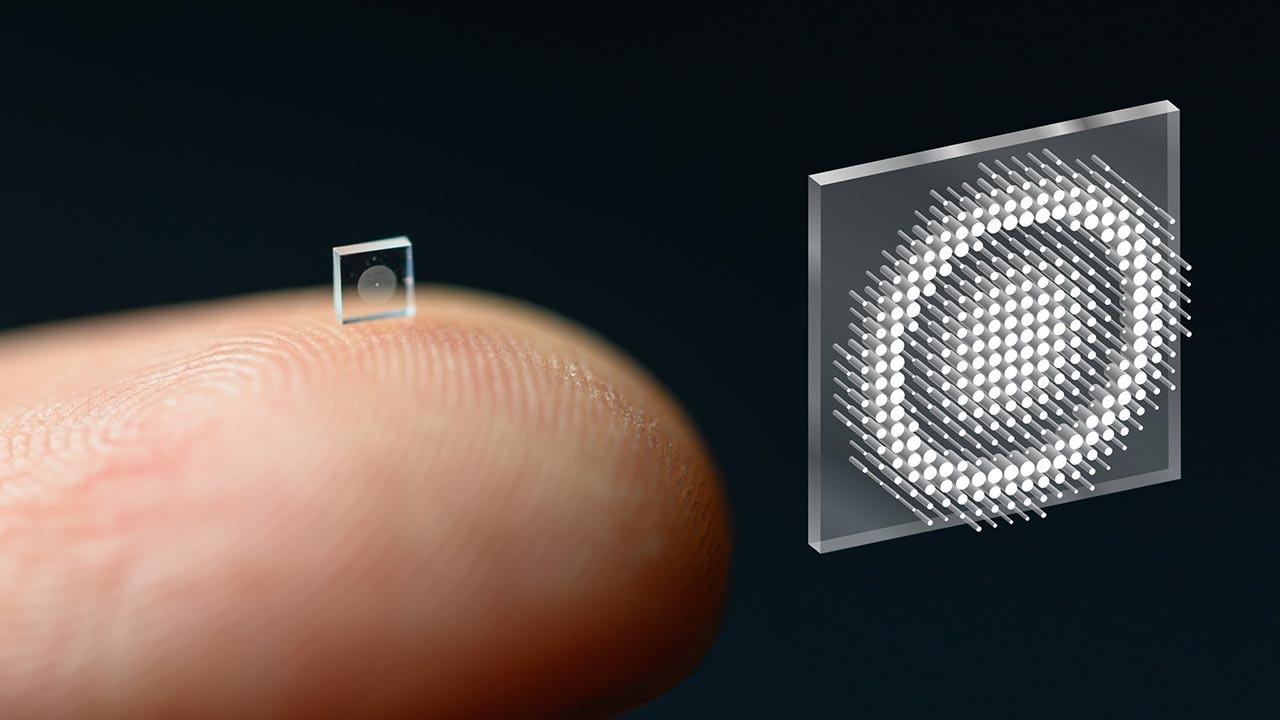

芯片级放大器:在片上实现约100倍光信号增强

报道指出,该芯片级光学放大器的关键特征在于:在几乎不增加能耗的前提下,实现约100倍的光信号增益。研究团队将其设计为可采用与消费电子芯片兼容的工艺制造,使放大器能够与逻辑、存储等电路更紧密地集成,而非以独立光学模块的形式部署。

相关成果归属于斯坦福团队,并于1月被重点报道。报道同时强调,兼容主流制造流程的设计思路,使该装置不仅停留在实验室演示层面,也被视为面向商业集成的技术铺垫。

人工智能负载推动“光”进入芯片关键路径

在人工智能工作负载中,系统瓶颈越来越集中在数据移动的速度与效率,而不只是算术运算能力。报道提到,早期一组工程师的研究显示,使用光而非电来执行卷积等常见神经网络操作,可显著提升芯片效率;相关设计通过光学架构完成卷积处理,将部分关键计算模块卸载到光学域。

另有研究进一步提出在硅芯片上将光与电结合执行卷积操作,其能效高于传统电子设备,并将该方向与可持续性议题相联系,认为光计算有助于降低人工智能系统功耗,从而缓解数据中心冷却与区域电网压力。在这一脉络下,芯片级光学放大器被视为构建光学组件“堆栈”的一环,可与光学计算模块等组合,形成更完整的光子加速器体系。

多项研究报告“100倍”级别提升,系统仍需信号维持能力

报道梳理了近期光学人工智能硬件的性能进展:9月,一组团队开发的光驱动人工智能芯片被描述为利用光学卷积使人工智能任务效率提升约100倍;上海研究人员也报告一款光驱动人工智能芯片,据称在某些任务上比顶级NVIDIA GPU快100倍。

报道同时指出,过去不少成果多集中在图像分类、文本生成等相对简单的工作负载,研究焦点正转向更复杂、更贴近现实部署的操作。在此背景下,片上光学放大器被视为系统级补充组件:若要在更密集的片上网络中维持高水平加速,需要在光信号传输过程中保持其强度与纯净度。

“LightGen”等项目凸显全光硬件竞赛

斯坦福放大器的出现也被置于全球全光芯片研发加速的背景之下。报道提到,中国开发了一款名为LightGen的全光芯片,据称在人工智能类工作负载上比NVIDIA芯片快100倍。报道将其与传统电子芯片的限制进行对比,称后者受电子在金属互连中的移动速度及其产生热量影响,而LightGen利用光实现更低延迟与更高并行性。

报道还提及该项目与正式科学出版物相关,并出现“10.1126”标识符,指向其已通过同行评审的属性。整体来看,报道将国家级项目构建全光处理器与高校实验室完善关键器件视为同一竞赛的不同路径,而低能耗、可靠的片上光信号增强与路由能力被认为是共同需求。

走向日常设备仍需跨越制造与软件生态门槛

尽管相关数据引发关注,报道认为从实验室原型走向日常硬件仍需通过制造、软件与标准等环节的检验。制造层面,尽管该放大器被设计为兼容消费芯片工艺,但要在不显著影响良率或成本的情况下,将光波导、放大器、探测器与晶体管集成,仍是曾经制约光子学进展的挑战之一。

软件层面,人工智能框架与编译器需要面向“电子核心+光学加速器+片上光放大器”的异构硬件进行优化。报道指出,尽管已有研究开始将神经网络操作映射到光子结构上,但这些映射仍较为专用;后续工作可能聚焦于标准接口,使在PyTorch或TensorFlow中训练的模型能够更自动地利用光学路径,而放大器在系统后台维持光信号强度并控制功耗。