只需轻点一下,匆忙拍下的照片就能被自动修复得清晰锐利,含糊不清的语音被转写成流畅的文字,聊天机器人可以代写措辞得体的邮件。借助人工智能(AI)的数字工具,许多日常操作看起来像是在“施魔法”。

然而,每一次看似轻松的交互背后,都有巨大的算力和能源支出。运行最前沿的 AI 模型需要庞大的计算基础设施。例如,训练一个类似 GPT‑3 的大型语言模型,成本高达一千多万美元,并消耗超过 70 万升水。此后,每一次查询和任务都要依赖高能耗的数据中心来完成检索、计算与响应。

问题的一部分源自底层硬件架构。当前大多数计算机仍沿用 75 年前确立的体系结构,核心器件是 1947 年问世的晶体管。

这种传统架构在通用计算领域表现出色,但在 AI 场景下却暴露出“数据交通堵塞”的弊端:计算单元与存储单元物理分离,数据必须在两者之间频繁来回搬运。这不仅拖慢整体处理速度,也带来巨大的能耗开销。

“AI 工作负载本质上是以存储为中心的,”新加坡国立大学设计与工程学院电气与计算机工程系洪嘉伟教授指出,“真正耗时耗电的不是算术运算本身,而是数据在存储和处理器之间的移动。”

随着 AI 逐渐进入大众日常生活,这一瓶颈愈发难以忽视。为应对这一挑战,“存算一体”(compute‑in‑memory,CIM)的概念应运而生:利用忆阻器在同一位置完成数据的存储与计算。

与依赖电子流动、断电即丢失信息的传统晶体管不同,忆阻器的工作方式更接近人脑。它通过离子迁移来传递信息,即使断电也能保持其电阻状态,从而在同一物理单元中同时承担存储和计算功能,大幅减少存储器与处理器之间的数据搬运需求。

不过,要让忆阻器在大规模系统中发挥作用,尤其是结合备受关注的先进二维(2D)材料,仍面临诸多工程难题,包括器件可控性、阵列中的信号干扰,以及与传统硅基电路集成的限制等。

一种新型存算一体计算机

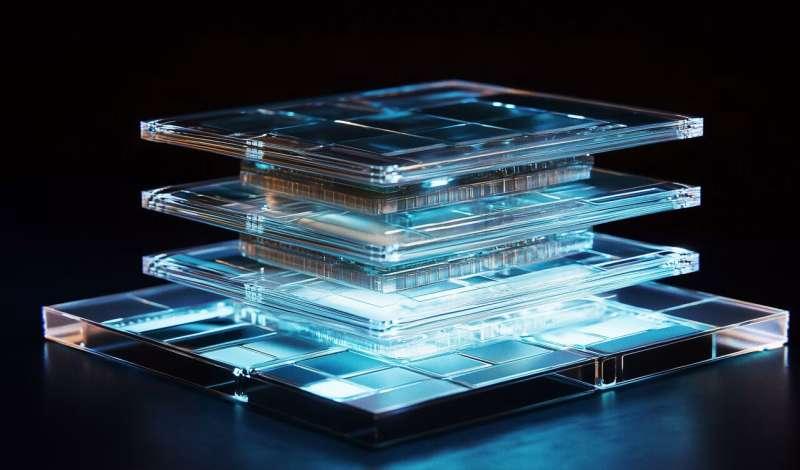

洪嘉伟教授团队近期开发出一个完全集成的 CIM 系统,在同一片芯片上实现数据的存储与处理。相关成果发表在《自然通讯》上。该系统的核心是一块由二硒化铪制成的 32×32 忆阻器阵列。这种超薄二维材料具有低能耗和快速开关的特性。设计中的关键,是在每个忆阻器下方集成一个基于硅的选择器器件。

“这些选择器就像交通指挥员,只让目标忆阻器被选通,其余单元保持关闭状态,”洪教授解释说,“这样可以抑制所谓的‘窃电流’,避免在大规模忆阻器阵列中出现电干扰和数据错误。”

通过为每个忆阻器配备一个选择器,形成一对一的配置,团队构建出一个紧凑且高度可控的网络结构。同时,他们采用的组装工艺可以在不损伤脆弱忆阻层的前提下,将其直接转移到硅基底上,使整个方案与现有半导体制造流程兼容。

在此基础上,研究人员进一步集成了外围电路,用于管理输入、输出和计算操作,构成一个完整可运行的系统。与传统体积大、功耗高的模数转换器不同,他们设计了基于时间域的感测电路,通过测量电压变化所需的时间来解析电信号。

这种时域读出方式不仅提升了数据读取速度,还将功耗压缩到传统方案的一半以下。

系统还利用这些电路本身的非线性特性,在硬件层面实现了激活函数——这是神经网络中模拟生物神经元“发放”行为的关键模块。将激活函数直接嵌入电路,有助于减少额外的处理步骤,进一步提高整体效率。

最终,团队构建出一个快速、紧凑且节能的存算一体平台。该忆阻器阵列的开关时间达到纳秒级,可承受超过 26,000 次编程循环而性能不显著退化。在采用简单卷积神经网络执行模式识别任务的测试中,系统识别准确率达到 97.5%,与传统数字实现相当,但能耗仅为后者的一小部分。

从实验室走向量产

通过在同一架构中合并存储与计算,这一方案显著降低了延迟和能耗,同时提升吞吐量,并保持设备尺寸紧凑。对于电力受限但对性能要求极高的场景——例如 AI 边缘计算和各类自主系统——这种技术有望带来颠覆性影响。

“由于我们的设计兼容现有硅工艺,不需要全新制造路线或依赖稀有材料,”洪教授补充说,“因此在面向现实世界的 AI 硬件应用时,具有很强的可行性。”

目前,团队正探索进一步放大忆阻器阵列规模、处理更复杂数据集的路径,目标是实现实时部署。值得注意的是,快速切换、良好耐久性以及低电压工作的综合特性,使这一系统特别适合用于类脑计算——即在硬件层面模仿大脑信息处理方式的计算架构。