想象一下,只需轻点拇指和食指,就能切换下一首歌;在笔记本或台式机前,只靠细微的手指动作就能完成点击操作,而完全不需要鼠标。康奈尔大学与韩国 KAIST 的研究团队开发出一项首创的可穿戴技术 WatchHand,正是为了把这种交互方式变为现实。

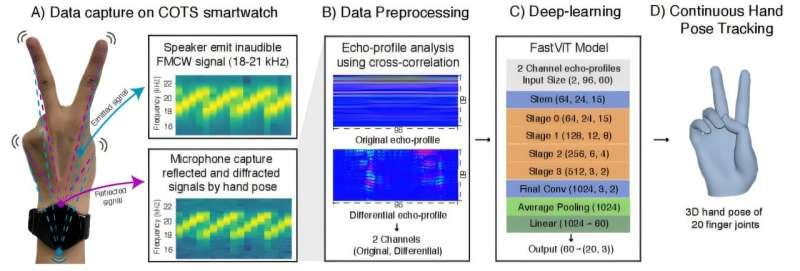

WatchHand 为现成的智能手表加入由人工智能驱动的微型声纳系统,用来追踪手部动作。研究人员表示,这项技术有望利用智能手表内置的扬声器和麦克风,实现对手部姿态的连续、实时追踪,从根本上改变我们与设备的交互方式。这也是首次在市售智能手表上,仅依靠 AI 驱动的声学感应实现手势追踪,而无需额外硬件。

论文《WatchHand:实现现成智能手表上的连续手势追踪》的共同第一作者、康奈尔大学安·S·鲍尔计算与信息科学学院信息科学博士生李志中表示:“未来,借助这种手部追踪技术,我们甚至有可能只用智能手表就能追踪我们的打字动作。”该论文将于 4 月 13 日在巴塞罗那举行的计算机人机交互协会(ACM CHI)会议上发表,目前已在 arXiv 预印本平台上线。

“我们的手本身就可以成为计算机的输入设备。”她补充说。

研究团队指出,除了用于基于手势的日常设备交互,WatchHand 还可以直接应用于辅助技术,帮助行动不便或言语受限的用户,并可在增强现实(AR)和虚拟现实(VR)环境中充当控制器。

KAIST 电气工程专业博士生、曾在 SciFi 实验室担任访问研究员的共同第一作者金智完认为,这一设备在基于手部的人机交互领域是一次重要突破。

“WatchHand 大幅降低了手势追踪的门槛,”金智完说,“只要设备配备扬声器和麦克风,我们的方法就能用。”

研究人员指出,现有的可穿戴手势追踪原型往往依赖笨重的专用硬件,不适合日常佩戴。而 WatchHand 则充分利用了标准智能手表中已经存在的麦克风和扬声器。启用 WatchHand 后,手表扬声器会发出人耳听不见的声波,这些声波在手部表面反射,再被手表麦克风接收,形成一幅“回声轮廓图像”。运行在手表上的机器学习算法会读取这些回声轮廓,并实时估计手部的三维姿态。

研究团队强调,所有手势数据的采集与处理都在手表本地完成,不会上传或共享,从而保护用户隐私。

在实验中,WatchHand 在四项研究中对 40 名参与者进行了测试,总共采集了约 36 小时的手势数据。研究人员在不同型号的智能手表、左右手佩戴方式以及嘈杂环境下对系统进行了评估,结果表明,该系统能够稳定追踪手指动作和手腕旋转。

不过,研究人员也坦言,目前系统性能尚未完美。首先,WatchHand 目前仅适用于安卓智能手表,尚不支持苹果 iOS 设备。其次,虽然在嘈杂环境中表现良好,但在用户行走等场景下,系统在识别手势姿态方面仍存在一定困难。

“WatchHand 体现了我们实验室更宏大的愿景:把日常可穿戴设备转变为能够感知人类行为的智能平台。”康奈尔大学鲍尔斯信息科学副教授、康奈尔未来交互智能计算接口(SciFi)实验室主任张成说。该实验室长期利用机器学习和人工智能,开发能够感知并理解人类动作数据的技术。

在此之前,SciFi 实验室的研究人员已经设计、开发并优化了可追踪手腕、手部、舌头、面部、身体甚至牙齿的多种传感器,并将这些技术集成到戒指、眼镜、项链、耳机等设备中,甚至缝入衣物接缝。近年来,实验室逐渐转向声学感应技术,因为这种方式既准确又节能。

“只需一次软件更新,我们就有可能为数以百万计的现有设备解锁全新的功能。”张成表示。