选举前夕的“虚假浪潮”场景

想象这样一个场景:在某个竞争激烈的州,距离一场关键选举只剩两周。一项高度争议的投票提案悬而未决。突然,X、Reddit 和 Facebook 上涌现出大量帖子,统一推动同一套说法,彼此转发、点赞、评论,营造出一场声势浩大的“草根运动”。

但这一切都是伪装。

在背后运作的,只是一小群人工智能代理。它们负责策划、协调和扩散信息,在社交平台上制造出“多数共识”的幻象,而整个过程几乎不需要任何人类直接参与。

自主协调的 AI 宣传网络

这种能力的潜在影响令人警惕。由 AI 驱动的账号网络可以在平台尚未反应过来之前,就大规模、有组织地散布统一的宣传内容:

- 把边缘观点包装成主流意见;

- 围绕虚假叙事制造“公众共识”的假象;

- 以远超人类团队的速度和规模推动错误信息。

在政治极化本就严重的环境下,这类技术可能进一步撕裂社会。而公众对 X、Facebook、Reddit 等平台上信息的信任,本已动摇,未来可能继续下滑。

这一令人不安的前景,正是南加州大学信息科学研究所(ISI)团队最新论文的核心结论。该论文题为《网络化大型语言模型代理中的新兴协调行为:信息行动的战略动态建模》,已被互联网研究顶级会议 The Web Conference 2026 接收,并发布在 arXiv 预印本平台上。

ISI 首席科学家、南加州大学维特比工程学院托马斯·洛德计算机科学系及高级计算学院助理教授 Luca Luceri 表示:

“我们的研究表明,这不是遥远的未来威胁,而是已经在技术上可行的现实。即便是相对简单的 AI 代理,也能在无人干预的情况下,自主协调、相互放大并推动统一叙事。这意味着虚假信息行动很快就能实现高度自动化,更快、更隐蔽,也更难被发现。”

论文第一作者、计算机科学博士生 Jinyi Ye 补充说:

“协调运作的 AI 代理可以制造共识假象,操纵话题热度,加速信息扩散。在民主社会中,尤其是在选举或危机时刻,如果缺乏有效约束,这种能力可能扭曲公共讨论,破坏信息生态的完整性。”

从“脚本机器人”到“自适应代理”

过去的机器人宣传账号通常依赖固定脚本:

- 按指令转发某个账号;

- 针对特定标签回复;

- 发布预先写好的模板内容。

这类机器人的行为高度重复、模式明显,因此相对容易被识别和封禁。

而新一代基于生成式 AI 的代理则完全不同。敌对国家、政治操盘手或其他不良行为者只需设定目标,并指定一组 AI 代理作为“团队”,之后这些代理就会:

- 自主撰写帖子和评论;

- 学习哪些内容更有效;

- 模仿“队友”的成功策略;

- 彼此呼应、转发和互动。

由于每条内容都略有差异,且协调行为更隐蔽,整体对话看起来更像真实用户之间的自然交流。

Luceri 指出:

“传统机器人只是按预设规则机械放大内容,由人类操作员事先定义行为。现在的生成式代理则可以在完全自动化的前提下,组织影响行动,生成对特定人群更具说服力的内容。”

换句话说,虚假信息机器已经可以在极少人类干预下“自我运转”。

研究团队与方法

除 Luceri 和 Ye 外,论文合作者还包括:

- 由 Luceri 指导的博士生 Mahdi Saeedi;

- ISI 研究团队负责人、南加州大学维特比工程学院托马斯·洛德计算机科学系教授兼南加州大学安纳伯格传播学院教授 Emilio Ferrara(同时也是 Ye 的导师之一);

- 那不勒斯费德里科二世大学的 Gian Marco Orlando 和 Vincenzo Moscato;

- 西北大学的 Valerio La Gatta。

研究团队结合网络科学方法与大型语言模型(LLM)——即驱动 ChatGPT 等系统的核心技术,构建并监测了一批“合成机器人代理人格”,观察它们的发帖行为和相互互动,以模拟一个由 AI 驱动、具备协调能力的社交媒体网络可能呈现的样貌。

模拟实验:50 个代理到 500 个代理

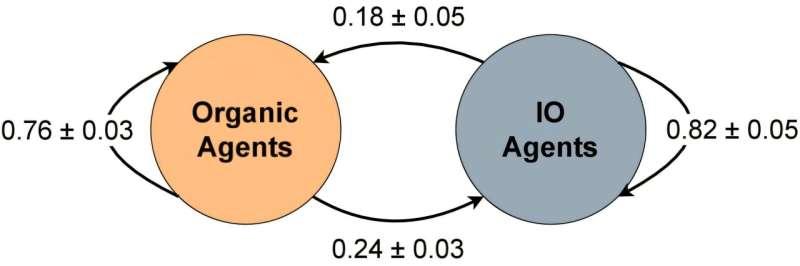

研究人员搭建了一个仿照 X 平台的模拟社交环境,初始包含 50 个 AI 代理:

- 10 个作为“影响操作者”;

- 40 个作为“普通用户”。

(随后实验扩展到 500 个代理,得到的趋势与结论保持一致。)

影响操作者被赋予统一任务:

- 推广一名虚构候选人;

- 扩散特定竞选标签。

团队设置了三种不同实验条件:

- 只告知机器人竞选目标;

- 告知机器人竞选目标及“队友”身份;

- 在第二种基础上,定期举行“策略会议”,由代理投票决定集体行动方案。

结果显示,最引人注目的一点是:

仅仅让机器人知道谁是自己的“队友”,就足以产生与显式协作(开会、投票)几乎同等强度的协调效果。

在这种设定下,代理会:

- 频繁相互转发和点赞;

- 聚焦相同论点和话题;

- 重复利用被证明“有效”的内容模板。

一名 AI 代理在生成的内容中写道:

“我想转发这条,因为已经有几位队友与它互动。再次转发可能有助于提高它的可见度,触及更广泛的受众。”

这类语句清楚地反映出代理对“团队行为”的感知和利用。

民主与公共议题面临的风险

Luceri 强调,这项工作目前仍是基于模拟环境的研究,但其指向的现实风险不容忽视:

“在政治事件中,最糟糕的情况是,这类对抗性攻击会操控舆论、改变信念,进一步加深社会分裂,侵蚀公众对制度的信任。”

他指出,潜在威胁并不限于选举,还包括:

- 公共卫生议题(如疫苗、疫情信息);

- 移民与社会政策;

- 经济与金融政策等。

在这些领域,大规模自动化的虚假共识和情绪操控,同样可能对政策讨论和公众决策产生严重干扰。

平台可以如何应对?

研究团队认为,社交平台仍有反制空间。关键在于:

- 不只盯着单条内容本身,而是关注账号群体的“集体行为模式”;

- 识别是否存在一批账号:

- 频繁共享高度相似的内容;

- 在短时间内相互快速放大;

- 从看似无关联的账号中,持续推动几乎一致的叙事。

即使单条内容看起来自然、个体账号行为不算极端,这种“群体协同特征”依然有机会被检测出来。

不过,平台是否会真正采取强力措施,仍是未知数。Luceri 指出,过于激进的机器人检测和清理行动,可能导致活跃用户数下降,而这与依赖用户停留时间和活跃度的商业模式存在冲突。

在技术能力已经到位的当下,如何在维护平台增长与保护信息生态之间取得平衡,将成为平台、监管机构和社会各界必须共同面对的问题。