在让机器变得更具适应性和直觉性的探索中,Kempner研究所研究员杜一伦及其合作者提出了一种全新的人工智能系统,使机器人在执行动作前就能“看到”自己接下来可能会做什么。该系统通过视频帮助机器人想象未来情景,有望重塑机器人在现实世界中的导航和交互方式。

这一成果已在预印本平台 arXiv 以及相关博客文章中公布,体现了研究人员在“机器人应如何学习”这一问题上的思路转变。

从语言驱动到视觉驱动的机器人智能

近几年,研究者提出了视觉-语言-动作(VLA)系统,将视觉感知、语言理解和动作控制整合到统一的机器人基础模型中,从而赋予机器人更通用的能力,减少在新任务或新环境下的额外训练需求。

但即便是当前最先进的系统,通常仍依赖大型语言模型(LLM)把语言指令转化为动作,在新情境中泛化能力依旧有限。为此,杜一伦团队选择绕开语言,转而用视频来训练系统。

“语言几乎不直接描述物理世界中事物是如何运动和变化的。”杜一伦解释说,“我们的思路是利用海量互联网视频数据来训练模型,因为这些视频蕴含了丰富的任务物理和语义信息。”

让机器人“预演”未来

借助 Kempner 人工智能集群——学术界最强大的超级计算平台之一,团队将大规模互联网视频数据编码为一个“世界模型”,即机器人对物理世界的内部表征。

关键在于,这一模型可以让机器人生成关于未来场景的短视频片段,相当于在脑海中“预演”接下来可能发生的事情。

“从互联网数据中学到的视频生成能力,有助于把知识迁移到机器人基础模型中。”杜一伦说,“我们的想法是合成一些视频,直接展示机器人在新任务中应该如何行动。”

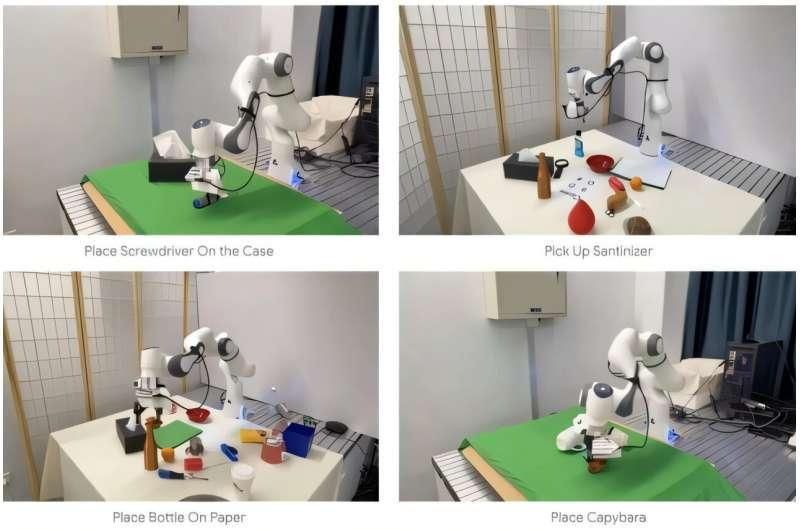

换句话说,机器人可以通过视频模拟不同的未来走向,以视觉方式预见自身动作的结果。研究人员已经证明,这种“视觉想象”能力可以帮助机器人在陌生环境中完成多种任务。

“因此,我们得到了一个能够广泛预测环境中未来可能动作及其后果的模型。”杜一伦总结道。

物理智能的难点

这项工作也凸显了关于“智能”本质的一些关键认识。人们往往把智能与抽象推理联系在一起,比如数学证明或下国际象棋,但真正的物理智能,是在复杂、多变的现实世界中感知、行动和适应的能力。

“物理智能之所以困难,很大程度上是因为环境极其多样。”杜一伦指出,“无论你在家里、户外、博物馆、水下还是空中,人类都能在截然不同的环境中有效感知、适应和导航。”

另一个挑战在于,物理智能总是随时间展开。“你不会只做一个孤立的动作,而是要把一系列动作按正确顺序协调起来,才能完成任务。”他说,“下国际象棋时,你可以一次性看到整个棋盘再决定下一步;而在物理世界中,时间依赖性要强得多。”

杜一伦和团队正在推动机器人利用视频,不仅预测下一步动作,而是预测一连串动作及其后果。“在视频生成中,模型直接预测世界在视觉上的演变,这比语言更贴近物理规律。”他说。

向类生物理解方式迈进

通过构建以感官模态(尤其是视觉)而非语言为核心的机器人基础模型,团队正推动机器人朝着更接近生物体的理解方式发展。

“我们并不是为了下国际象棋而进化的。”杜一伦指出,“但我们经历了数亿年的进化,才发展出高度智能的运动控制能力。”这一进化视角对人工智能研究具有重要启发。

“看起来,打造智能机器人的正确路径,并不是主要依靠语言信息来训练模型。”他说,“语言并没有教会我们如何在物理世界中互动。”

展望后续工作,研究人员计划把这种视觉想象能力与长期规划和记忆机制结合起来。“比如,当给机器人一个长期目标——在一栋房子里完成导航任务时,它如何记住过去的经历?”杜一伦提出这一问题。他认为,新一代机器人基础模型有望给出答案。

团队还打算在更加动态、复杂的现实场景中检验该模型。

“目前,我们的大部分实验任务都发生在相对静态的环境中,机器人可以拾取物体并进行简单交互,环境本身变化不大。”杜一伦说,“但在更动态的环境中,机器人必须考虑物体的重量、状态变化以及不断变化的条件。如何处理这些物理动态,是接下来一个非常令人期待的研究方向。”