华盛顿与人工智能公司Anthropic近期关系紧张,被视为暴露出当前人工智能领域缺乏统一、连贯监管框架的现实。在此背景下,一批跨党派思想家和公共人物联合发布《亲人类宣言》,试图提出一套关于“负责任的人工智能开发”应如何推进的原则性框架。

这份宣言在上周五五角大楼与Anthropic发生公开对峙前已最终定稿,但两者在时间上的交叠被多方注意到。

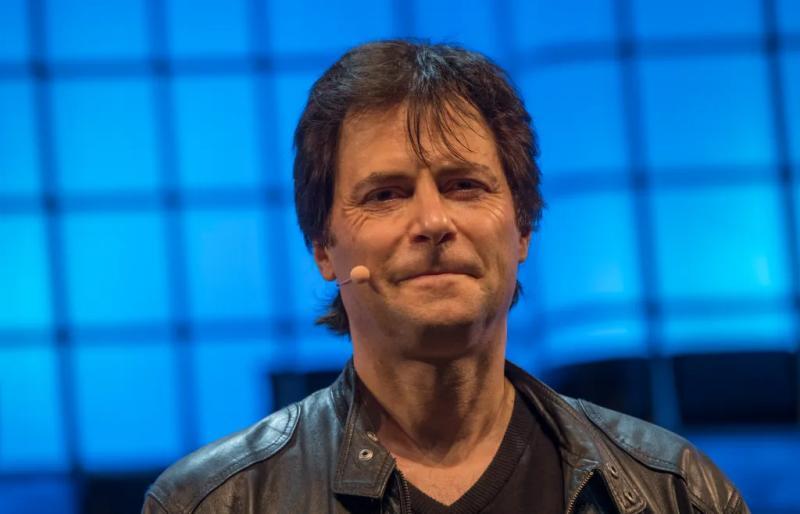

宣言的组织者之一、麻省理工学院物理学家兼人工智能研究员马克斯·泰格马克在接受采访时表示,过去数月美国公众态度出现明显变化。他称,最近民调显示,“95%的美国人反对不受监管的超级智能竞赛”。

宣言由数百名专家、前政府官员及公众人物签署,开篇指出,人类正处在一个关键十字路口。文件描述了两条不同的发展路径:一条是所谓“替代竞赛”,即人类先在劳动力市场上被机器取代,随后在决策权上被取代,权力进一步集中到少数不受约束的机构及其系统手中;另一条则是通过人工智能显著扩展人类能力和潜能。

宣言提出,后者路径的实现依赖五项核心支柱:保持人类对系统的最终掌控、避免权力过度集中、保护人类体验、维护个人自由,以及让人工智能企业承担相应法律责任。

在具体主张上,宣言列出多项较为严格的要求,包括:在科学界就安全性达成共识并获得“真正民主认可”之前,全面禁止超级智能的开发;对强大人工智能系统强制设置可行的“关闭开关”;禁止开发具备自我复制、自主自我改进或抗关闭能力的系统架构等。

宣言发布之时,围绕美国国防部与人工智能企业关系的争议正在升温。2月最后一个星期五,国防部长皮特·赫格塞斯将Anthropic列为“供应链风险”,理由是该公司拒绝向五角大楼提供对其技术的无限制访问权限。此类标签通常用于与中国存在关联的企业。同日数小时后,OpenAI与国防部达成合作协议,部分法律专家认为该协议在执行层面“难以操作”。相关事件被视为凸显国会在人工智能监管立法方面长期不作为所带来的后果。

美国创新基金会高级研究员迪恩·鲍尔随后在接受《纽约时报》采访时表示,这一争议“并不仅仅是合同纠纷”,而是“美国首次就谁来控制人工智能系统展开的全国性讨论”。

泰格马克在谈及监管逻辑时,将其与制药行业作类比。他指出,公众无需担心某家制药公司在尚未弄清安全使用方式前就推出可能造成巨大伤害的新药,“因为FDA不会允许他们发布任何不够安全的产品”。

在他看来,华盛顿围绕权力与管辖权的博弈,往往难以转化为推动立法的公众压力,而“儿童安全”可能成为打破僵局的关键切入点。宣言因此呼吁,对人工智能产品——尤其是面向未成年人的聊天机器人和陪伴类应用——实施强制性的部署前测试,重点评估其是否会增加自杀意念、恶化精神健康状况或对用户进行情感操控等风险。

泰格马克举例称,如果一名成年人假扮年轻女孩,向一名11岁男孩发送短信并试图劝说其自杀,“这在现有法律下是犯罪行为,会被判刑”。他提出质疑称,既然已有相关法律,“那么当机器做出同样行为时,为什么应被区别对待?”

他认为,一旦在儿童相关产品上确立发布前测试的原则,其适用范围很可能会被逐步扩大。“人们会说——让我们再增加一些其他要求。也许我们还应该测试它不能帮助恐怖分子制造生物武器。也许我们应该测试超级智能是否有能力推翻美国政府。”

宣言的签署者阵容显示出跨党派特征。前特朗普总统顾问史蒂夫·班农与前奥巴马总统国家安全顾问苏珊·赖斯共同签署了该文件,前参谋长联席会议主席迈克·穆伦以及部分进步派宗教领袖也在签署名单之列。

泰格马克表示,这些立场迥异的签署者“达成共识的一点是,他们都是人类”。他称,如果未来必须在“人类的未来”和“机器的未来”之间作出选择,他相信这些人“会站在同一边”。