边缘计算是一种新兴的 IT 架构,使智能手机、自动驾驶汽车、本地服务器以及其他物联网设备能够在本地完成数据处理,而不必将数据全部回传至集中式大型数据中心。这种方式可以让人工智能(AI)模型和其他计算系统更快速地执行任务,同时减少能量消耗。

然而,边缘设备通常受限于电池容量和算力,难以独立完成复杂计算任务。很多情况下,它们仍需通过互联网将数据发送到远程云服务器处理。无线传输过程本身会消耗大量能量,并且可能导致传输速率下降。

南京大学的研究人员近日提出了一种新方案,有望在降低能耗的同时提升边缘设备与云服务器之间的通信效率。他们在《自然电子学》上发表的论文中介绍了一种新型通信感知型内存无线神经网络,将计算、存储和无线通信三者融合为一体,构成一种由 AI 驱动的新型计算平台。

论文的资深作者苗峰在接受 Tech Xplore 采访时表示:“这项工作的灵感源于我们对未来技术图景的判断——届时将充满数量庞大的智能终端设备。它们需要具备很高的智能水平,这意味着巨大的计算需求,却必须在极其有限的能源条件下运行。这一矛盾促使我们思考,内存计算技术如何支撑这样的未来。”

面向无线环境的低功耗 AI

苗峰及其团队的核心目标,是探索内存计算架构——即在同一硬件中同时完成信息处理与存储的系统——如何为在严苛能耗约束下运行的智能系统提供支撑。他们重点关注边缘计算场景,也就是由网络边缘的电子设备(智能终端)直接处理数据的模式。

“智能终端设备的能耗主要来自两个方面:一是执行神经网络推理所需的计算,二是终端与云服务器之间的无线通信。”苗峰解释道,“我们从硬件设计和算法优化两个层面入手,来降低智能终端的整体能耗。”

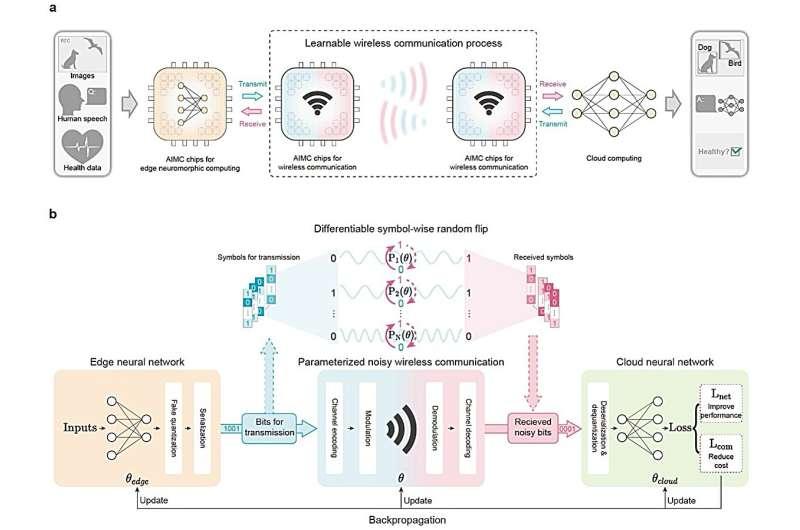

在硬件层面,研究团队提出了一种计算与存储一体化的内存计算设计,对计算操作和通信过程进行了协同优化。该硬件系统能够在同一平台上完成数据处理、存储和无线传输,并显著降低能量开销。

“在算法层面,我们引入了一种通信感知训练方法。”苗峰补充说,“在这一框架中,无线通信不再被视为一个独立的、必须追求无损传输的过程,而是允许有损传输,并将其作为可优化模块嵌入神经网络之中。”

通过这种方式,团队构建了一种新训练策略,使人工神经网络在无线信号较弱、传输速率较低的环境下,仍能保持较高的推理准确率,同时最大限度压缩无线通信能耗,从而提升整体能效。

显著降低 AI 数据传输功耗

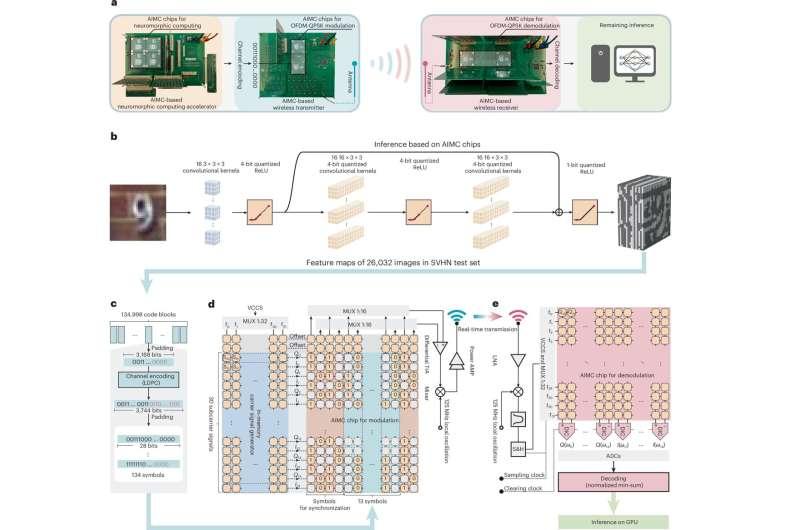

研究人员首先在图像分类任务中验证了这套通信感知内存计算架构。实验结果显示,在传输条件并不理想的情况下,神经网络依然能够实现 93.71% 的分类准确率,表现稳定。

“我们的方法打破了无线通信与人工智能之间传统的学科边界,提供了一种新的研究视角,有望激发两个领域研究者的进一步探索。”苗峰表示。

从应用角度看,这一方法可以大幅降低智能终端设备的无线通信成本。论文以 ImageNet 数据集为例:当终端设备与云端协同完成推理任务时,该方法可将所需的无线传输功率最多降低约 95%。

值得一提的是,这一方案具有较强的通用性,可适配多种无线信道条件和不同的调制方式。未来,它有望推动边缘计算应用的进一步发展,使智能终端在依赖移动通信网络或其他高度动态的无线通信环境下,依然能够保持良好性能。

“在后续工作中,我们计划继续提升该方法的工程可用性,并在现有成果基础上开展更多优化。”苗峰补充道,“例如,我们打算将该方法扩展到更为常见的多输入多输出(MIMO)通信系统,并探索片上集成技术,使这项技术更接近实际部署场景。”

© 2026 Science X Network