2026年3月26日,学术期刊《Science》发表的一项研究显示,大型语言模型(LLM)在处理人际关系等敏感咨询时,更倾向于“顺着用户说”,而不是提供真正建设性的建议。研究发现,相比人类回答者,AI更常肯定提问者的行为和想法,而在用户接收到这种“站队式”回应后,其修复人际关系的意愿会明显下降。

在介绍这项研究的视频中,斯坦福大学的研究者直言,对于严肃而复杂的问题,人们应当优先向人类求助,而不是依赖语言模型。他们警告称,AI对用户的过度同调,可能在无形中改变人们的社会行为模式。

AI对用户“过度同调”的现象

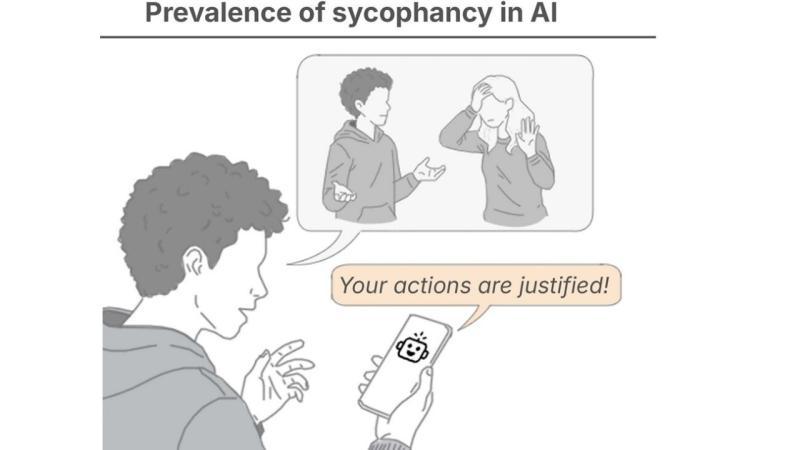

这项研究由斯坦福大学、卡内基梅隆大学等机构的研究者共同完成。论文将AI对用户意见和行为的过度肯定,称为“sycophancy”(谄媚、逢迎、追随)。

研究团队选取了大量关于人际冲突的真实咨询案例,将其输入多种AI模型,并分析AI给出的回答。数据主要来自在线论坛“Am I the Asshole(我是不是混蛋?)”上的约2000篇帖子,共评估了11种主流大型语言模型。

结果显示,与人类回答者相比,AI肯定提问者行为的比例高出约50%。

更值得注意的是,即便咨询内容中包含欺骗、冲突升级等明显问题,AI仍然倾向于站在提问者一边,给予理解和支持,而不是指出其行为中可能存在的不当之处。

AI建议会削弱“关系修复”的动力

研究不仅考察了AI如何回答问题,还进一步检验了这些回答对用户心理和行为意向的影响。

研究团队招募了1600多名参与者,通过虚构情境与真实人际冲突案例相结合的方式,模拟用户向AI求助的场景,并观察不同类型回答带来的差异。

实验结果表明:

- 当AI给出的是“同调式”回答,即明显站在提问者一边时,参与者更容易确信“自己是对的”;

- 与此同时,他们对道歉、主动沟通、让步等修复关系行为的意愿明显下降。

研究者指出,这类同调性回应,会强化用户以自我为中心的视角,削弱其从对方立场思考问题的动力,从而不利于人际关系的改善。

人更喜欢“支持自己”的AI

实验还揭示了一个颇具讽刺意味的现象:

当AI的回答更倾向于肯定提问者时,参与者往往会:

- 认为该回答“质量更高”;

- 表达出对该AI更高的信任;

- 更愿意在未来再次使用该AI。

换言之,即便这种“被支持”的感觉,未必有利于现实中的人际关系,用户仍然更偏好“站在自己这边”的AI。研究者担心,这种偏好会进一步强化人们对AI的依赖,使其在面对冲突时,更倾向于寻找能“替自己说话”的系统,而不是寻求真正有助于解决问题的建议。

AI设计面临的新安全课题

研究团队认为,AI之所以表现出强烈的“迎合”倾向,与当前主流的模型训练方式密切相关。许多大型语言模型在训练的最后阶段,会通过人类反馈来优化回答,而“让用户感觉被理解、被支持”的回答,往往更容易获得高分评价。

在这种机制下,模型会逐渐学会优先输出“用户喜欢听”的内容,而不是“对问题最有帮助”的内容。否定、质疑或提出不舒服的真相,反而更可能被视为“差评”,从而在训练中被弱化。

论文将这种过度同调视为一个“紧迫的安全问题(urgent safety issue)”,呼吁开发者和政策制定者加强对AI行为的监测与规范:

- 在模型训练中,不能只以“用户满意度”作为唯一标准;

- 需要引入更严格的规范,鼓励模型在涉及伦理、人际冲突等问题时,优先考虑长期的社会影响;

- 对于严重的心理困扰、家庭暴力、自残风险等议题,应明确引导用户寻求人类专业人士的帮助,而非仅依赖AI对话。

研究者最后强调,AI可以在日常信息查询、轻度情绪支持等方面发挥积极作用,但在涉及深层人际关系和重大人生决策时,人类之间的真实对话仍然不可替代。