制造业、物流业以及餐饮业正快速走向自动化,机器人被广泛部署在各类生产与服务场景中。其中,物料搬运是最核心的应用之一:通过各类夹持器,机器人可以搬运汽车零部件、物流包裹、食品原料乃至餐厅菜品。这不仅减轻了人工劳动强度,也降低了事故发生的概率,从而提升整体作业安全性。

要让机器人能够自主处理物体,首先需要通过摄像头精确获取场景的三维(3D)形状信息,然后再规划如何抓取和移动每一个目标。然而,对于某些具有特殊光学性质的物体,传统3D测量系统往往难以胜任。

相较之下,不透明物体的3D形状较易被识别和测量;但对于玻璃、透明塑料等透明物体,随着透明度提高,深度测量的精度会显著下降,识别难度随之增加。

高度反光或镜面物体也存在类似问题。强反射会干扰深度传感器和常规3D测量技术,使得机器人难以稳定获取其形状信息。这些技术瓶颈往往需要人工介入,拖慢物料搬运流程,也限制了机器人在更多场景中的应用。

为应对这些挑战,日本东京理科大学机械与航空航天工程系副教授新井翔吾,与预计于2025年硕士毕业的银河健尼斯,共同提出了一种新方法:HEAPGrasp——基于手眼主动感知的多光学性质物体抓取方法。

相关研究成果已在线发表在《IEEE Robotics and Automation Letters(IEEE机器人与自动化快报)》上,并计划在2026年IEEE国际机器人与自动化会议(ICRA)上进行报告展示。

新井博士指出:“传统上,对于透明或镜面(光滑)物体,例如反光金属零件、透明托盘,使用深度传感器或常规3D测量技术时,检测结果往往不稳定,导致机器人自动抓取变得困难,最终只能依赖人工处理。”

他进一步解释:“我们的方法基于这样一个思路:即便深度信息不可靠,只要能够稳定获取物体的轮廓或剪影,就仍然可以进行物体形状估计和抓取规划。”

HEAPGrasp 的核心是对多视角红绿蓝(RGB)图像的分析。系统首先利用计算机视觉中的语义分割技术,将图像中每个像素划分为“物体”或“背景”,从而将目标物体从背景中分离出来。

在具体实现上,研究人员使用单个手眼RGB摄像头,从不同视角拍摄场景图像,并对这些图像进行语义分割,以提取物体的轮廓信息。为完成这一任务,他们采用了基于 ResNet-50 的 DeepLabv3+ 卷积神经网络架构。

接下来,提取出的轮廓会被输入到一种名为“轮廓形状重建”(Shape from Silhouette,SfS)的3D重建方法中。SfS 通过分析多视角图像中的物体轮廓,推断物体的三维形状:每一个轮廓都对应一个物体可能存在的三维体积区域。

通过对这些体积区域求交集,SfS 可以估计出物体的整体形状及其在空间中的位置。由于这一过程仅依赖轮廓信息,而非深度值,因此几乎不受透明度、反射率等光学性质的影响。

在 SfS 框架下,增加不同视角的数量通常可以提高重建精度,从而提升抓取成功率。但视角越多,意味着摄像头需要移动到更多位置,带来额外的运动时间和计算开销。

为在精度与效率之间取得平衡,研究团队引入了一个基于深度学习的“下一视角”规划模块,用于决定摄像头的最优移动路径。该模块的目标是在尽可能提高测量精度的前提下,减少不必要的视角切换和运动距离。

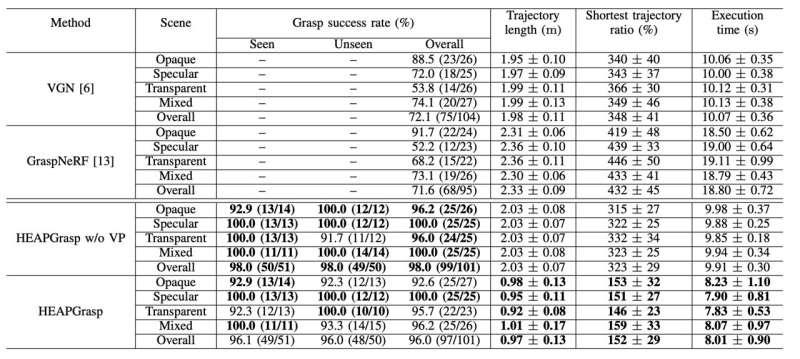

研究人员在真实机器人系统上对 HEAPGrasp 进行了评估,设计了20个不同场景,每个场景包含5个物体。测试场景包括:仅透明物体、仅不透明物体、仅镜面物体,以及三种类型混合的复杂场景。与此同时,他们还将 HEAPGrasp 与现有抓取方法进行了对比实验。

实验结果显示,在仅使用单个摄像头的条件下,HEAPGrasp 对多种光学性质物体的抓取成功率达到了96%,明显优于对比方法。此外,相比于需要围绕场景进行完整3D测量的基线方案,HEAPGrasp 所使用的手眼RGB摄像头轨迹长度减少了52%,整体执行时间缩短了19%。

银河健尼斯表示:“我们的方法在保证物体3D测量精度的同时,显著减少了摄像头的移动距离和执行时间。”

他补充道:“通过降低预先调整和标定的工作量,HEAPGrasp 使现场部署和操作更加简化,尤其适合直接加装到现有的机器人系统中。”

总体来看,HEAPGrasp 提供了一种新颖且实用的3D测量与抓取方案,使机器人能够更可靠地处理透明、镜面等具有挑战性光学性质的物体,有望在制造、物流、餐饮等多个领域发挥重要作用。