橡树岭国家实验室人工智能安全研究中心(CAISER)正系统性地揭示AI系统中的安全弱点。虽然AI模型在经济发展、人道援助和国家安全等方面潜力巨大,但其被恶意利用的风险也在不断上升,而识别和刻画这些漏洞往往需要大量专业知识和人力投入。

为提升AI漏洞发现的效率和覆盖度,CAISER研究人员基于现有技术开发出Photon框架,用于在艾级计算规模上快速检测AI模型中的安全缺陷。该框架旨在帮助确保AI系统在能源、医疗、金融以及国家安全等关键领域部署时,能够在面对攻击时保持安全性和稳健性。

研究团队通过重新构思橡树岭国家实验室已有的DeepHyper框架设计了Photon。DeepHyper最初用于训练大规模神经网络并搜索最优网络参数。研究人员将这一能力“反向使用”:Photon不再寻找最佳模型配置,而是被训练为寻找最有效的攻击参数,用于识别和放大模型中的恶意利用路径,从而帮助模型开发者理解并防御这些攻击。

CAISER主任Edmon Begoli表示:“这听起来可能有点‘投机取巧’,但效果非常显著。Photon加速了设计和开发过程,并复用最有效的漏洞探索和利用方法。”

在AI领域,“探索与利用”是一个基础概念,用来描述在发现新可能性(探索)与充分利用已有知识(利用)之间的平衡。Photon正是围绕这一思想构建的。

在实际运行中,Photon首先从公开科学文献中收集已知攻击方法,并将这些攻击应用到目标模型上。随后,它会根据模型暴露出的弱点对这些攻击进行优化。在不断利用已发现漏洞的同时,Photon还会持续探索模型的其他潜在薄弱环节,并尝试对新发现的漏洞进行利用。这个“探索—利用”循环会一直进行,直到模型性能不再出现进一步下降。

依托DeepHyper框架,Photon可以通过异步、分布式的方式自动测试和搜索大规模超参数空间。简单来说,Photon能够在多台计算机上同时尝试大量不同的攻击配置,而不需要一个集中式的单一管理代理来协调所有优化过程。

在这种分布式架构下,每个攻击代理都会与其他代理共享发现结果。如果某个攻击策略表现最佳,其他代理会实时学习并调整自身攻击方式,从而最大化对模型漏洞的利用效率。

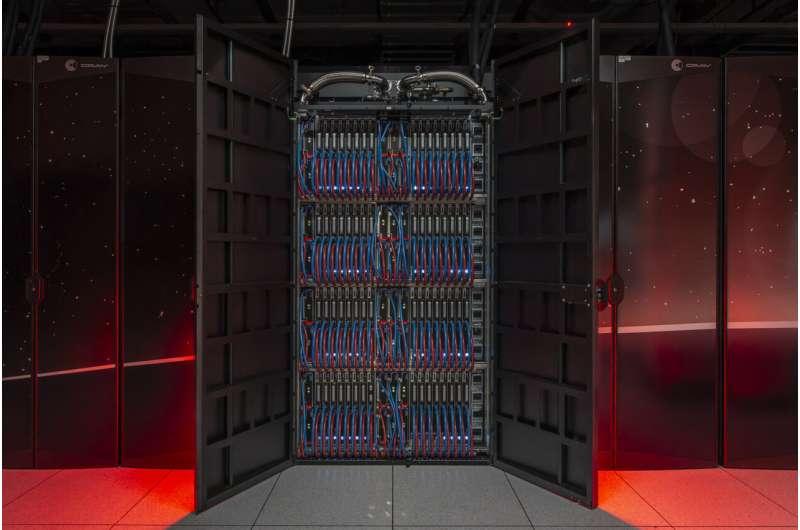

艾级超级计算机支撑大规模AI漏洞测试

Photon的高效攻击测试能力离不开橡树岭国家实验室的Frontier艾级超级计算机。Photon可以在不同计算节点上并行运行多种攻击实验,这种并行规模使其区别于目前已知的其他AI漏洞测试方法。

在Frontier的单个节点上,Photon每小时可以执行约6万次“越狱”提示测试——这些提示被专门设计用来诱导AI系统突破原有安全限制。相比之下,人类“红队”(模拟攻击者的安全测试团队)完成同等规模的测试可能需要数年时间。而Photon不仅能并行执行大量越狱尝试,还能在过程中协调和整合这些攻击活动,持续追踪最有效的攻击路径。

通过实时调整和演化攻击策略,Photon模拟了自然界中高效的搜索模式——类似蚂蚁在环境中快速聚集到高产资源的行为——从而确保每一次探索都尽可能转化为有价值的安全情报。

这种方法显著减少了传统红队越狱测试中的辅助工作和流程瓶颈,并在不牺牲计算效率的前提下实现大规模扩展。在Frontier的1920个GPU上,Photon能够保持超过95%的资源利用率。

橡树岭国家实验室稳健AI工程师Jack Hutchins指出:“在如此大规模的环境下运行时,尽可能用满所有可用计算资源是非常困难的。由于规模巨大,要完全消除资源空闲几乎不可能。即便如此,能维持95%左右的利用率已经非常难得。”

DeepHyper的探索策略会优先尝试潜在影响较大的参数组合,同时保证对整个参数空间的覆盖。因此,Photon既能发现明显的安全缺陷,也能捕捉到更隐蔽的漏洞,从而更全面地评估模型在对抗场景下的表现。

Hutchins表示:“我们的目标是找到高效的越狱方式。越快定位到影响最大的参数,我们就能越快找到真正有效的越狱路径。”

为关键任务AI系统提供快速修复路径

在AI深度融入全球关键业务的背景下,确保这些系统的可靠性、稳健性和安全性比以往任何时候都更为关键。Photon不仅能够揭示AI模型中潜在的安全漏洞,还为快速修补这些问题提供了技术路径,从而维护关键任务系统的完整性和性能。

Begoli总结道:“Photon代表了一种新的AI安全思路。通过协调的大规模实验,我们可以比过去更高效地发现隐藏的漏洞。这项技术有助于确保AI技术在各行各业持续发挥创新价值的同时,不会引入新的安全风险或隐患。”