受人类视觉发育启发的新流程或将改进计算机视觉模型训练

研究团队提出一种名为“发展视觉饮食”(DVD)的新训练流程,通过模拟人类视觉发育过程,让计算机视觉模型更依赖形状而非纹理,从而在鲁棒性和泛化能力上取得提升。

乒乓球机器人首次在实战中压制顶尖选手,对机器人技术意义重大

索尼AI研发的乒乓球机器人 Ace 在与高水平人类选手的正式对抗中取得优势,被视为人工智能从虚拟环境走向高速、强不确定性现实场景的重要里程碑。

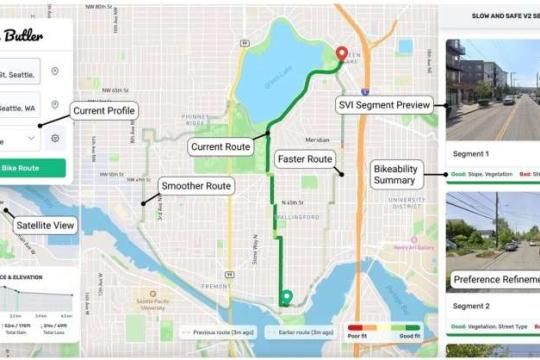

BikeButler 地图:依据限速与路况偏好为骑行者定制个性化路线

华盛顿大学团队开发了 BikeButler 演示应用,利用街景与 AI 分析路况、绿化和限速等信息,为西雅图骑行者生成符合个人偏好的通勤与休闲路线。

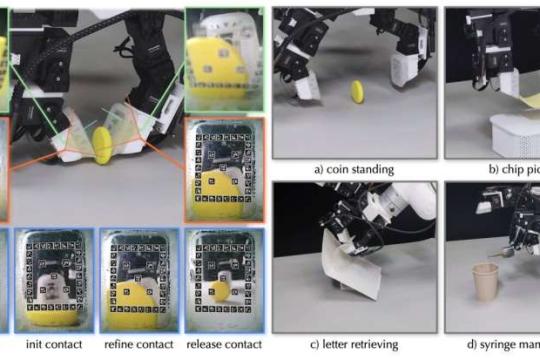

FingerEye桥接触觉与视觉,增强机器人接触前后操作能力

FingerEye是一种集成双目视觉与柔性触觉结构的新型传感器,可在接触前、接触中和接触后持续提供感知信息,从而显著提升机器人在复杂灵巧操作任务中的表现。

新研究:人工智能难以客观量化“美”

弗吉尼亚大学数据科学学院的分析发现,用人工智能给人类外貌打分,更容易放大数据中的偏见,而非揭示所谓普遍的美学标准。

丰田发布自研「Woven City AI Vision Engine」:将城市影像转化为语言理解,在实证都市与交通安全中应用

丰田在实证都市 Woven City 推出全新 AI 视觉引擎,可将街景视频转化为可理解的语言信息,用于城市运营与交通安全支援,并与多种城市级 AI 系统联动。

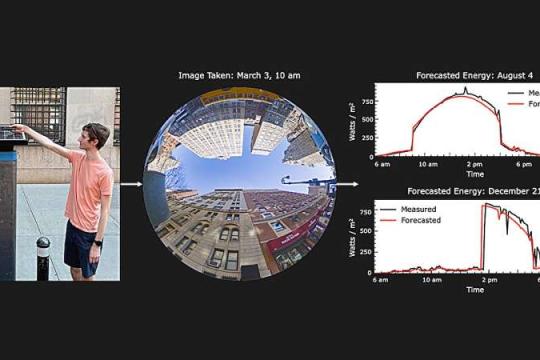

一张照片就能判断:这块城市太阳能板朝向对不对?

研究团队用一台360度相机和一套计算机视觉算法,在纽约街头实测发现:许多城市太阳能板并未处于最佳朝向,仅通过重新调整角度,年发电量就可能提升多达30%。

耳塞内置微型摄像头:与AI对话获取实时场景信息

华盛顿大学团队在普通无线耳塞中集成微型摄像头,用户可直接与AI对话获取眼前场景信息,并在本地完成处理以增强隐私保护。

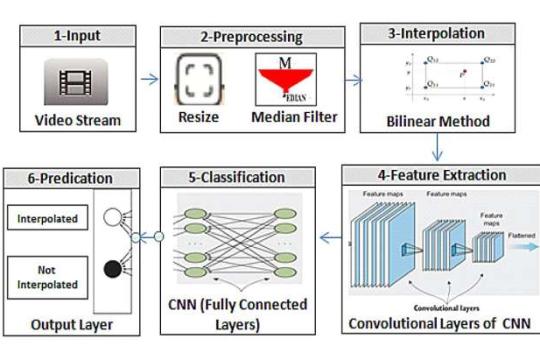

新AI系统以95%准确率识别视频篡改帧

一项发表在《工程研究杂志》上的研究提出了一种结合传统图像处理与深度学习的三阶段方法,可在UCF101数据集上以约95%的准确率自动检测并定位视频中的插帧篡改。

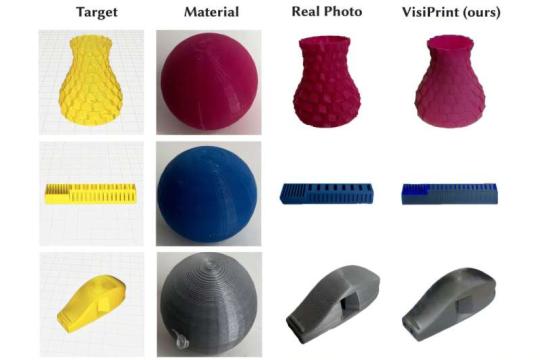

VisiPrint系统:用两张图片生成逼真3D打印外观预览

麻省理工学院等机构研发的VisiPrint系统,只需一张切片软件截图和一张材料照片,就能生成逼真的3D打印外观预览,帮助减少反复试错和材料浪费。

HEAPGrasp:更高效的机器人复杂物体抓取新方法

HEAPGrasp 利用手眼主动感知与多视角轮廓重建,让机器人在单摄像头条件下也能高效抓取透明、镜面等复杂光学性质物体,并显著缩短测量路径与执行时间。

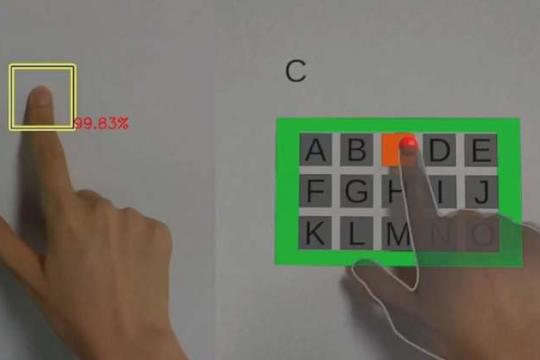

新方法让墙壁与桌面秒变触控面板

东北大学团队提出一项新技术,仅依靠AR/MR头显自带摄像头与AI模型,就能把墙壁、桌面等日常表面变成可触控的输入区域,无需额外硬件或传感器。