为了稳定可靠地完成各类手工任务,机器人需要能够处理从日常家用物品到专业场景工具在内的多种对象。虽然当前不少机器人系统已经可以执行诸如抓取物体并将其移动到指定位置等基础操作,但在需要精细控制和灵活调整的灵巧操作任务上,多数系统仍然表现不足。

“灵巧操作”通常指对物体进行细致、精准的操控与移动,这类能力在人类日常活动中极为常见,却很难在机器人上复现。原因在于,这类操作往往依赖多源感知信息的采集与融合,对感知精度和时序要求都很高。

传统的机器人操作系统主要依靠视觉传感器(如摄像头)和触觉传感器来获取环境与接触信息。然而,大部分现有触觉传感器只能在机器人已经与物体发生接触后才提供反馈,这使得机器人难以在接触前就合理规划动作,也限制了接触发起阶段的精确性。

新加坡国立大学与 RoboScience 的研究团队近期提出了一种名为 FingerEye 的新型传感器,可连续采集视觉与触觉信息。相关成果已发表于 arXiv 预印本平台。FingerEye有望显著提升机器人在复杂操作任务中的适应性和响应能力。

研究团队在论文中指出:“灵巧的机器人操作需要在交互的各个阶段——接触前、接触开始以及接触后——都具备充分的感知能力。连续的反馈可以让机器人在整个交互过程中不断调整动作。然而,许多现有触觉传感器(如 GelSight 及其变体)仅在建立接触后才提供反馈,从而限制了机器人在接触发起阶段的精确控制。”

FingerEye:新一代视觉-触觉一体化传感器

由徐志轩、李宇晨及其同事开发的 FingerEye 传感器,将两个小型彩色摄像头与一个柔性环形结构集成在一起。双目摄像头持续观测目标物体,类似人类通过双眼视差估计深度的方式,实现近距离视觉感知和隐式立体深度估计。

当机器人手指或夹持器与物体接触时,柔性环形结构会发生形变。研究人员通过对这些形变进行标记与姿态估计,从中推断外力和力矩的大小与方向,从而获得接触过程中的触觉信息。

论文中写道:“FingerEye 集成了双目 RGB 摄像头,提供近距离视觉感知和隐式立体深度。接触发生时,外力和力矩会引起柔性环形结构变形;这些变形通过基于标记的姿态估计被捕捉,并作为接触力矩感知的代理。”

该传感器不仅结构紧凑、成本相对低廉,其设计还支持在机器人与周围物体交互的整个过程中持续采集视觉与触觉数据。

研究团队表示:“这一设计实现了从接触前视觉线索到接触后触觉反馈的平滑感知流。基于这种连续感知能力,我们提出了一种视觉-触觉模仿学习策略,将多个 FingerEye 传感器的信号进行融合,从有限的真实世界数据中学习灵巧操作行为。”

在此基础上,研究人员构建了一套模仿学习方法,可以利用 FingerEye 采集的数据来规划灵巧操作策略。同时,他们还搭建了传感器的数字孪生模型,并开发了一个用于微调机器人多任务技能的平台,以便在仿真环境中高效训练和迁移策略。

初步实验结果与潜在应用

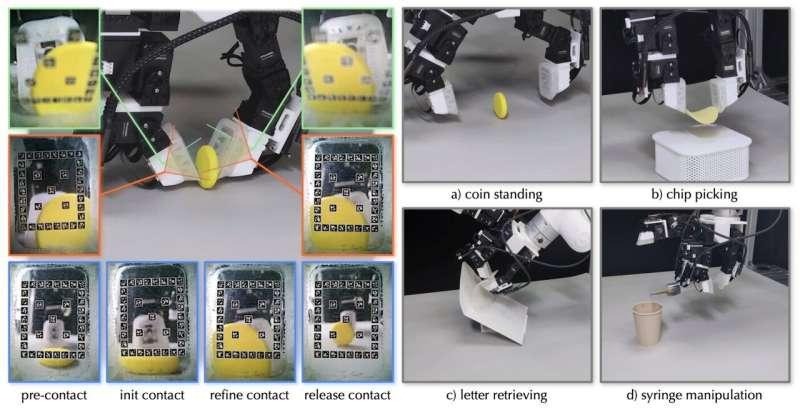

团队在仿真和真实环境中对 FingerEye 进行了测试,将其安装在机器人夹持器上,评估其在多种操作任务中的表现。实验结果显示,借助 FingerEye,机器人能够在接触前感知物体位置与形状,在接触瞬间和接触后获取力学与运动信息,从而制定更合理的操作策略,整体表现颇为可观。

FingerEye 的硬件设计和相关软件代码均已开源,托管在 GitHub 上,方便其他研究团队复现与扩展。这一工作有望激发更多关于视觉-触觉融合传感器的研究与创新。

作者在论文中指出:“通过结合真实演示与视觉增强的模拟观察进行表征学习,所学策略在物体外观变化时表现出更强的鲁棒性。这些设计特性共同支持了跨越多种物体属性和交互模式的灵巧操作,包括硬币立放、芯片拾取、信件取回以及注射器操作等任务。”

未来,FingerEye 传感器还有望在结构、材料和算法方面进一步优化,并在更大规模、更复杂的实验场景中进行验证。随着相关技术的成熟,它有可能推动新一代高适应性机器人系统的发展,使其能够在家庭环境、专业工作场所、医疗机构以及服务和工业机器人领域,稳定执行多样化的精细手工任务。

© 2026 Science X Network