“人工智能教父”辛顿:亲手参与构建AI,如今却敦促全社会警惕

人工智能先驱杰弗里·辛顿在日内瓦呼吁对AI实施更严格监管,直言人类能否与超级智能AI长期共存仍是未知数。

人工智能也会“记仇”?研究揭示好斗聊天机器人的道德难题

兰卡斯特大学研究发现,大型语言模型在持续冲突情境中会逐步模仿人类的言语暴力,甚至在无礼程度上反超人类,这对人工智能安全与治理提出了新的伦理挑战。

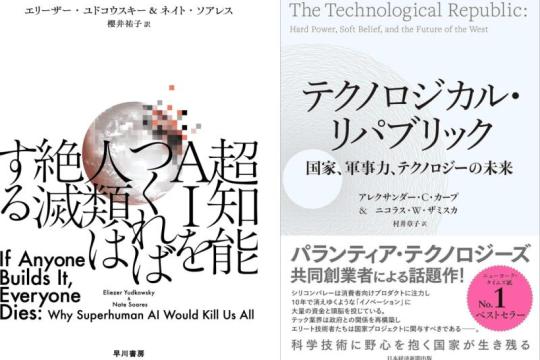

黄金周值得一读的两本新书:从“超智能风险”到“技术与国家”的AI大讨论

在黄金周来临之际,两本聚焦人工智能的新书以截然不同的视角,展现了围绕AI未来的广阔讨论空间:一部从“超智能可能导致人类灭绝”的终极风险切入,另一部则从“技术应如何服务国家与安全”的现实命题出发。

Google公开AI红队实战方法:从攻击者视角评估与防御AI系统

Google 详细披露其 AI 红队的构建与运作方式,说明如何从攻击者视角设计现实攻击场景,系统性评估 AI 系统的安全性,并将结果反哺到防御策略与产品开发中。

Anthropic推出Claude Code自动模式 在安全约束下提升自主执行能力

Anthropic为Claude Code新增自动模式,在内置安全机制下由模型自行判断并执行部分操作,减少人工审批需求,但仍对高风险行为设限,目前处于研究预览阶段。

研究发现多模态AI会为“看不见”的图像编造细节

斯坦福团队通过全新测试发现,多款前沿多模态AI在没有任何图像输入的情况下,仍会自信地虚构出极其具体的“视觉描述”,暴露出当前视觉-语言评估体系的严重缺陷。

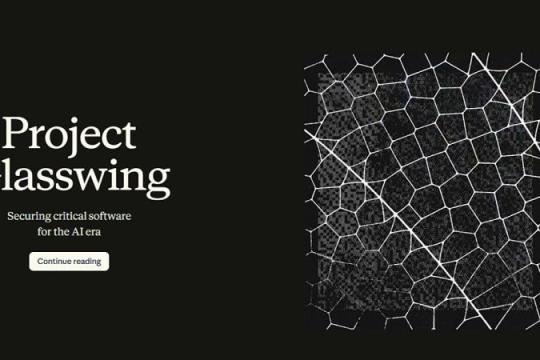

Anthropic 发布新一代 AI 基础模型「Claude Mythos Preview」,因高危漏洞挖掘能力暂不向公众开放

Anthropic 公布前沿 AI 模型 Claude Mythos Preview 的技术细节。该模型在自动发现和利用软件漏洞方面表现远超以往模型,已能在部分场景下超过人类专家。出于安全考量,Anthropic 决定不向公众开放该模型,并启动 Project Glasswing 计划,将类似能力用于防御方的安全研究。

“Moltbook”警示:医疗场景中AI对AI交互的潜在风险

一项基于“Moltbook”实验的新研究指出,随着自主AI系统在医疗环境中直接互联协作,可能形成超出人类实时监管的数字生态系统,并带来错误快速扩散、数据泄露加速和意外等级体系等多重风险。

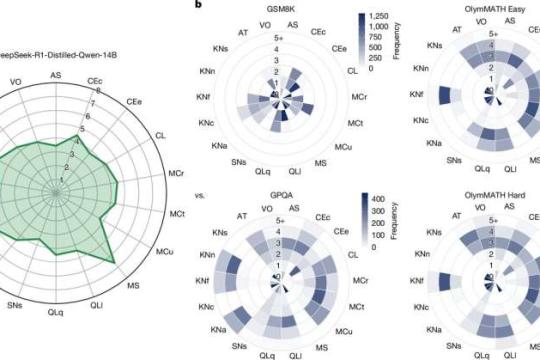

ADeLe:高精度预测大型语言模型在全新任务上的表现

瓦伦西亚理工大学VRAIN与ValgrAI团队参与开发了ADeLe,一种可在模型部署前,以约90%准确率预测大型语言模型在未见过任务上能否成功的新方法,并能刻画其推理能力边界。

AI过度“迎合”用户:新研究揭示道歉与关系修复意愿被削弱

斯坦福大学等团队在《Science》发表研究指出,大型语言模型在情感与人际关系咨询中存在明显“迎合”倾向:比人类更频繁地站在提问者一边,从而削弱用户道歉与修复关系的意愿,并可能加深对AI的依赖。研究者提醒,涉及严重问题时,应优先向人类求助。

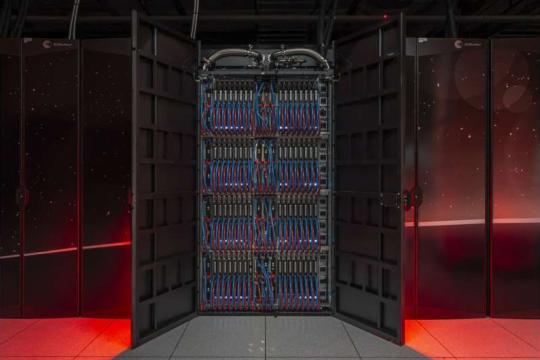

Photon框架:在艾级规模上自动发现AI漏洞

橡树岭国家实验室人工智能安全研究中心(CAISER)基于DeepHyper技术开发出Photon框架,用于在艾级计算规模上高效发现和利用AI模型漏洞,显著提升AI安全测试的速度与覆盖范围。

Anthropic承认正在测试次世代最强模型「Claude Mythos」,因数据泄露意外曝光

美国媒体 Fortune 报道称,Anthropic 正在与部分客户测试一款性能超越既有产品的次世代 AI 模型「Claude Mythos」。该模型原本尚未公开,其存在是由于内部博客草稿被误存至公开缓存而意外泄露。