在大科技公司里,工程师若想让推荐系统(例如社交媒体信息流、在线购物排序等)变得更“公平”,第一步并不是写代码,而是先搞清楚:“公平”究竟指什么?

应用程序是否应该只展示系统预测用户最可能喜欢的内容?还是要在此基础上,有意识地提升新兴创作者、小型企业,或长期处于代表性不足的群体?在线商店的商品排序,是不是只该依赖历史点击和销量,还是也要为独立卖家留出与大品牌竞争的空间?

推荐系统中的“强者愈强”效应

康奈尔科技(Cornell Tech)信息科学助理教授 Allison Koenecke 指出,推荐系统尤其容易产生“强者愈强”的动态:

排名靠前的内容更容易获得点击和曝光,这会进一步抬高它们的指标,使其持续占据搜索结果或信息流顶部位置——从而可能不公平地压制那些排名略低但质量更高的内容。

这种反馈循环会让早期获得优势的项目不断积累优势,而其他内容则更难被用户看到。

大科技如何理解与实践“公平”

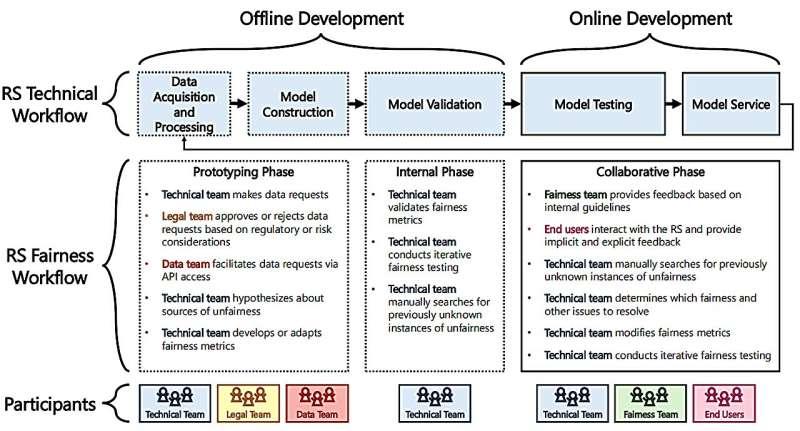

Koenecke 与共同第一作者——康奈尔科技信息科学博士生 Emma Harvey、2024 年博士毕业生 Jing Nathan Yan——合作撰写了论文《工作流程中的公平:大科技公司机器学习从业者如何看待推荐系统中的公平》(Fairness in the Workflow: How Big Tech ML Practitioners View Fairness in Recommender Systems)。

该研究将在 2026 年计算机协会 CHI 人机交互大会上发表,合著者还包括 2024 年博士毕业生 Junxiong Wang 和马里兰洛约拉大学助理教授 Jeffrey Rzeszotarski。

研究发现,要在大科技内部真正推动推荐系统的公平性,仅仅提出技术方案远远不够,还至少涉及以下几个方面:

- 先给“公平”下定义:不同团队、不同产品对公平的理解并不一致。

- 建立激励机制:让公平工作不再只是“额外负担”,而是被纳入正式考核和目标。

- 形成共享语言:让工程、法律、政策和公平团队能在同一套概念框架下沟通。

- 在开发早期介入:在数据收集、建模初期就考虑公平,而不是等系统上线后再“补救”。

Harvey 强调,学界已经提出了大量提升算法公平性的技术方法,但如果这些方法无法在工业界落地,就难以产生实际影响:

要推动这些方案被真正采用,我们必须理解从业者在把公平纳入日常工作流程时遇到的具体障碍,然后针对性地去解决。

人为选择与公司结构的影响

研究指出,公平问题本质上离不开人为决策:

- 公司选择奖励哪些指标;

- 优先考虑哪些群体的利益;

- 愿意在性能、收益与公平之间做出怎样的权衡。

这些都不是单纯的技术问题,而是与组织结构和决策流程紧密相关。

研究团队访谈了 11 位在大型科技公司负责推荐系统的机器学习从业者,发现他们的公平相关决策往往受到以下因素影响:

- 历史经验是否有系统沉淀:过去做过的公平项目有没有被记录下来,能否被新团队复用。

- 法律/公平团队介入的时间点:是从产品设计初期就参与,还是只在系统上线后做合规或风险审查。

另一个关键障碍是激励不匹配。多数受访从业者表示,他们花在公平相关工作的时间通常不到 10%。日常工作重点更多在:

- 提升系统性能指标;

- 保证系统稳定性和可靠性;

- 确保产品持续顺畅运行。

Harvey 指出,即便技术人员真心在意公平,如果绩效考核只看性能和运行时间,他们也不得不优先优化这些指标:

在这样的评价体系下,公平工作很难被排到优先级的前列。

文档缺失与缺乏“公平通用语”

研究还发现,公平实践往往依赖于以往项目的经验教训,但这些经验并不总是被系统化记录:

- 许多关键决策只存在于个人记忆或零散文档中;

- 不同团队之间难以共享已有的公平实践和教训。

Harvey表示,她对大科技公司内部文档缺失在多大程度上阻碍了“机构层面的公平知识”积累感到意外。

此外,团队之间缺乏统一的专业语言,也会让公平工作推进受阻:

- 工程师、法律团队、政策专家和公平专家可能在目标上是一致的;

- 但他们使用不同的概念和框架来描述问题,导致沟通成本极高。

Harvey形容自己“强烈感受到需要一种‘公平通用语’”:

即便在同一家公司,技术从业者也很难与公平从业者顺畅对话,因为他们来自不同学科背景,习惯的术语和思维方式差异很大。

时间点与组织结构为何关键

研究团队发现,公平团队介入的时间点对结果影响巨大。在不少公司,公平或合规团队往往是在:

- 产品或模型已经上线后才被拉进来;

- 此时任何改动都更慢、更难,成本也更高。

这与推荐系统的动态特性有关。系统一旦上线,就会持续根据用户行为进行调整,形成复杂的反馈循环:

- 早期的偏差可能被不断放大;

- 随着时间推移,还可能出现新的不平等现象。

例如,一个本就偏向热门创作者的推荐系统,会让这些创作者获得更多曝光和粉丝,从而进一步巩固其主导地位。

Koenecke 指出,如果公司想在技术流程中真正优先考虑算法公平,就必须同步审视自身的组织结构:

比如,应确保内部公平团队在开发早期就能直接参与推荐系统的产品工作——从数据收集、特征设计到离线原型阶段——而不是等模型发布后,才以“事后公平检查”的方式介入。

研究整体表明,要让大科技的推荐算法变得更公平,不仅需要技术方案,更需要在定义、激励、文档、语言和组织流程上进行系统性调整。