机器人能“看路”的四足控制技术

KAIST研究团队开发出一项全新的四足机器人控制技术:机器人不仅能在没有视觉信息的情况下通过估计地形实现稳定行走,还能借助摄像头和激光雷达传感器感知周围环境,在运动过程中自主做出行走决策,类似动物通过视觉观察地形并调整步伐。这一技术未来还计划扩展到轮足机器人、人形机器人等多种平台。

该研究由KAIST电气工程学院Hyun Myung教授团队主导,并与其实验室孵化的初创公司EuRoboTics有限公司合作完成。他们提出的“DreamWaQ++”是一种基于视觉信息识别地形、并能实时调整运动策略的四足机器人控制方法。

相关成果已发表在《IEEE Robotics and Automation Letters(IEEE机器人学汇刊)》上。

从“盲走”到“看着走”

在此之前,团队曾开发过名为DreamWaQ的“盲行”控制技术。该技术仅依赖关节编码器和惯性测量单元等本体传感器来估计地形,即使在完全缺乏视觉信息的情况下,机器人也能保持稳定移动。这使其能够在视觉受限的环境中行走,例如灾难现场。但其局限在于:机器人只有在腿部实际碰到障碍物后,才能根据反馈调整动作。

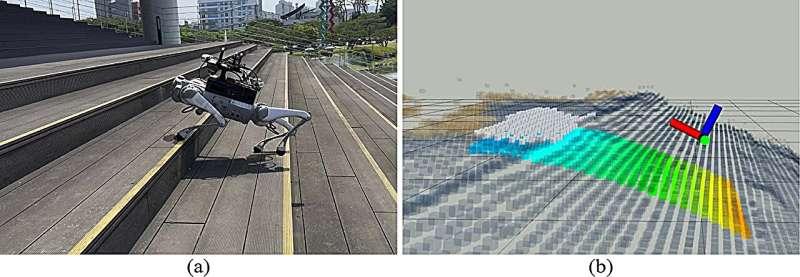

新一代的DreamWaQ++通过融合摄像头和激光雷达的外部感知能力,突破了这一限制。其核心是“基于感知的运动控制”:机器人可以提前识别前方障碍,主动改变行走策略,不再只是被动反应,而是对环境有一定“理解”,并据此进行自主决策。

为实现这一点,研究团队设计了多模态强化学习架构,并在轻量级计算平台上实现了实时控制。当某一类传感器出现误差或失效时,系统可以自动切换到其他感知模式继续控制运动,从而提高整体稳定性,并具备在不同机器人平台上迁移应用的可扩展性。

复杂地形上的实测表现

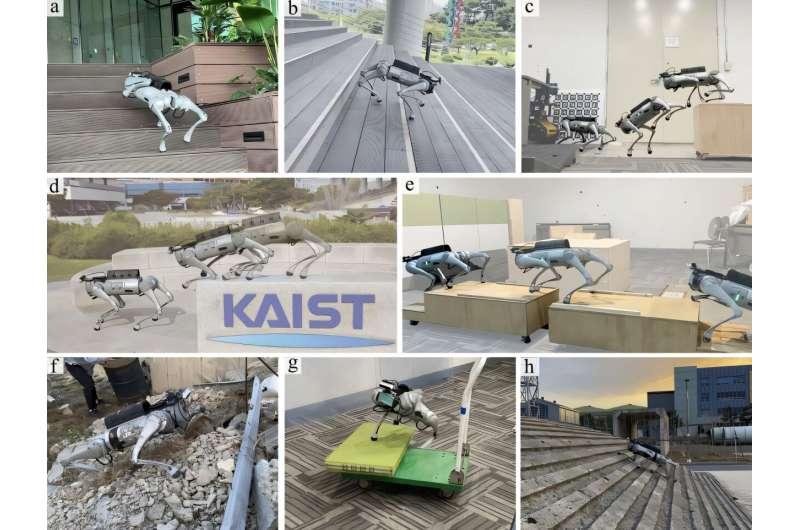

研究团队通过多种实地实验验证了DreamWaQ++的性能,结果显示,搭载该控制技术的四足机器人在复杂环境中的表现优于现有方法。

在楼梯行走实验中,机器人在仅用约35秒的时间内完成了包含50级台阶的路线(水平距离30.03米,垂直高度7.38米),成绩优于盲行控制器和商业化视觉感知控制器。

在陡坡测试中,机器人成功稳定攀爬了35°的斜坡,这一坡度是训练条件(10°)的3.5倍。行走过程中,机器人会主动调整姿态,使后腿电机的扭矩需求相比现有方法降低约1.5倍。

在多种障碍场景下,机器人展现出基于学习的环境感知能力:

- 能在无额外路径规划模块的情况下,自主选择更高效的通行路线;

- 在存在跌落风险的不确定地形上,会表现出探索行为,例如主动停下、检查地面后再继续前进。

在负载测试中,机器人在背负2.5公斤负载时仍保持高度灵活,成功跨越了41厘米高的障碍物,这一高度已超过机器人本体高度。仿真结果显示:

- 搭载DreamWaQ++的ETH苏黎世四足机器人ANYmal-C可应对最高1.0米障碍;

- KAIST朴海元教授团队开发的KAIST HOUND则可跨越最高1.5米障碍。

值得注意的是,尽管训练阶段仅包含最高27厘米的低矮障碍,机器人在42厘米高的楼梯测试中依然取得了约80%的成功率。这表明其能力并非仅限于“记住训练场景”,而是具备一定程度的环境泛化与自适应能力。

面向灾害响应与工业巡检的应用前景

研究团队认为,这项技术有望应用于传统轮式机器人难以进入的场景,例如灾害救援、工业设施巡检、林业和农业等复杂环境。

Hyun Myung教授表示,这项研究显示机器人已经从“只会移动”迈向“理解环境并自主决策”的阶段。团队接下来将继续拓展这一技术,使智能移动机器人能够在更多真实场景中发挥作用。