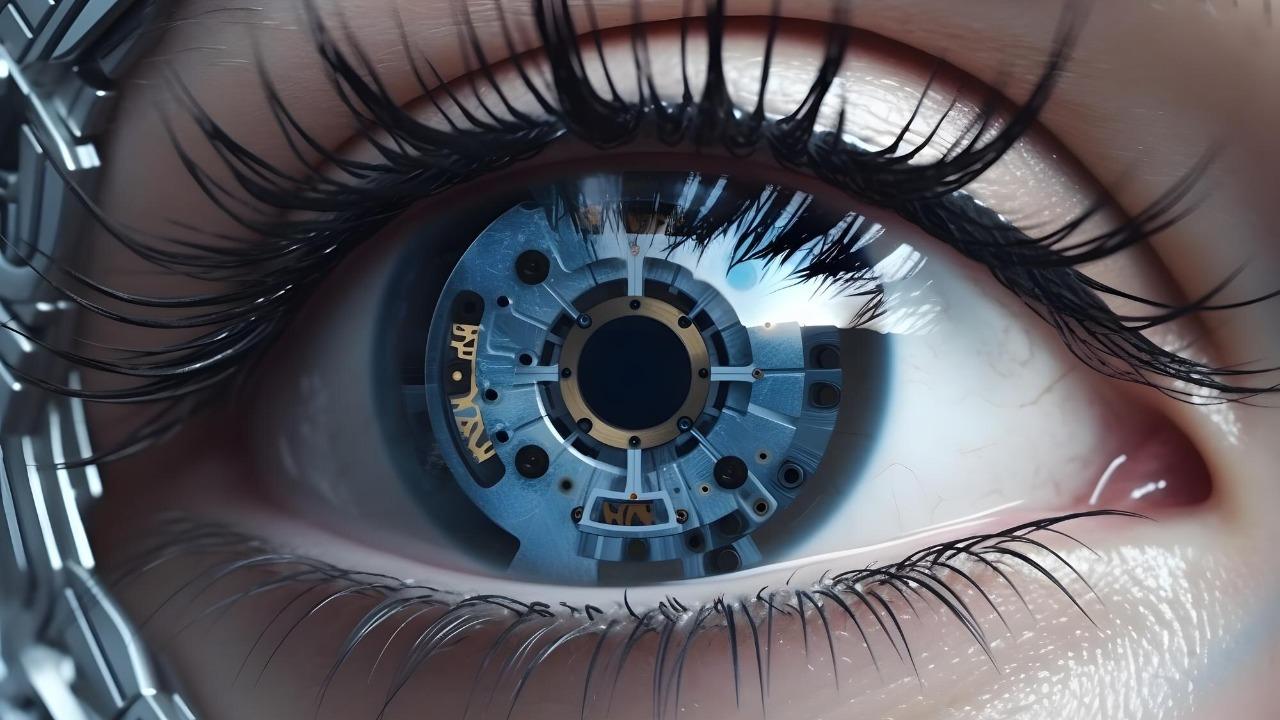

研究人员近日披露的一种仿生激光雷达原型在空间细节分辨率上实现了其所称的“超越视网膜分辨率”,并在体积与系统集成度上瞄准现实机器部署需求。与通过堆叠更多激光器与探测器来提升性能的传统路径不同,该方案借鉴生物视觉的资源分配机制,将更高的采样密度集中到关键区域,并可随场景变化实时调整,从而把机器视觉从静态成像扩展为随时间演化的动态感知问题。

借鉴中央凹机制:将分辨率集中到“感兴趣区域”

人眼的高分辨率视觉主要集中在中央凹,周边视野则提供环境上下文,大脑会不断重定向注视点以获取关键信息。研究团队将这一思路引入激光雷达:通过自适应聚焦把最高密度的采样指向目标或关键结构,同时保留周边覆盖以维持整体场景理解。在其原型系统中,团队将这种策略描述为实现了“超越视网膜分辨率”的效果。

研究人员强调,该设计将分辨率视为可在场景中“移动”的资源,而非依赖阵列规模的线性扩张。通过把采样优先分配给运动区域、边缘特征或小目标出现的位置,系统试图在减少物理元件数量与功耗压力的同时,提高关键区域的有效细节获取能力,以适配汽车、无人机或手持设备等对体积与能耗敏感的应用形态。

集成光子平台:在芯片上重塑光束与时序

该仿生激光雷达的实现基础是一套集成光子架构,研究团队将激光源、光束控制与探测环节作为可编程系统进行协同设计。核心器件采用光学频率梳,并支持在芯片上调节重复频率,从而改变发射波长间距,进而调整深度图的细节粒度。

在报道的实验中,通过调节频率梳重复率,系统实现了成像细节的两倍提升。研究描述称,这种方式可在保持整体视场与帧率与现有商业激光雷达相当的前提下,完成类似“光学变焦”的细节增强。

研究人员同时指出,与依赖笨重可调谐激光阵列或大量固定通道的频率梳方案相比,芯片级频率梳与灵活通道分配使系统能够在紧凑平台上实现实时重构:可在宽域扫描、高倍变焦检查与快速运动跟踪等模式间切换,而无需更换硬件。

从三维点云到“时间为一等维度”的四维感知

传统激光雷达主要输出三维点云,而该集成自适应相干激光雷达框架将时间纳入核心设计目标,面向“四维仿生视觉”。研究描述称,系统利用相干探测获取距离与相位信息,并可随时间调整采样模式;可变重复率与灵活通道间距使成像粒度能够按帧定制。

在应用设想中,这意味着机器人或车辆可将每一帧观测与下一步采样位置的选择联动:当行人走下路缘或无人机识别到电力线等细小结构时,系统可收紧局部采样网格,提高该区域的时间与空间分辨率,同时降低其他区域的采样密度。

相关神经启发研究:光与神经组织交互的并行探索

围绕“仿生”理念的研究并不局限于传感器本体。报道提到,同一研究生态系统也在探索光与活体神经组织的可控交互,例如石墨烯介导的光刺激平台(Graphene-Mediated Optical Stimulation,GraMOS)。相关描述称,该平台通过石墨烯界面向脑类器官提供安全、非遗传、生物兼容的光刺激,并可对神经活动产生持续数天至数周的影响。

商业化与制造推进:Lucidus与PIXAPP被点名

在产业化层面,报道指出,围绕集成光子激光雷达的商业化尝试正在推进。智能纳米光子学相关调查中提到,Lucidus与PIXAPP被列为“开创性商业化尝试”,目标是推动紧凑、高效的集成激光雷达模块走向自动驾驶汽车与工业机器人等场景。

研究端的进展也强调可制造性与封装的重要性。报道提到,12月披露的集成仿生激光雷达平台被定位为适用于紧凑集成光子平台;而1月关于仿生激光雷达原型的报道中,作者Tejasri Gururaj指出,该设计通过自适应聚焦实现“超越视网膜分辨率”,并试图避免依赖昂贵的“蛮力扩展”路线。